简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

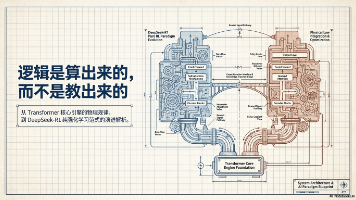

这种“左手理解、右手生成”的分工,是处理时序信号最科学的物理形态。每一个初次接触大模型的人,在打开那篇划时代的论文《Attention Is All You Need》时,多半会被那张经典的 Transformer 架构图搞晕:密密麻麻的连线、左右对称的层级、莫名其妙的“Masked”字样。注意: 虽然在逻辑任务上完全去中心化,但在处理日常对话等主观任务时,DeepSeek 依然采用混合奖励机制(

这种“左手理解、右手生成”的分工,是处理时序信号最科学的物理形态。每一个初次接触大模型的人,在打开那篇划时代的论文《Attention Is All You Need》时,多半会被那张经典的 Transformer 架构图搞晕:密密麻麻的连线、左右对称的层级、莫名其妙的“Masked”字样。注意: 虽然在逻辑任务上完全去中心化,但在处理日常对话等主观任务时,DeepSeek 依然采用混合奖励机制(

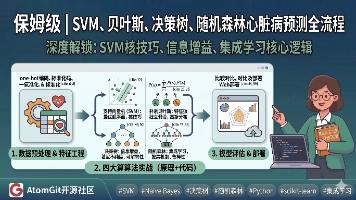

随机森林在所有指标上表现最优,且鲁棒性强,适合作为心脏病预测的核心模型;

机器学习可以划分监督学习+无监督学习+强化学习+生成模型等。其中监督学习占据大头,而监督学习依靠预测结果为离散数据还是连续数据,又划分成分类和回归两大问题。

LLM-Fuzzer 通过三大核心创新模块,成功解决了 LLM 越狱测试的自动化与可扩展性难题,其开源代码为开发者提供了标准化的安全测试工具。本文详细拆解了论文的核心知识点,并提供了从环境搭建到结果验证的完整复现流程,读者可按步骤快速上手。无论是学术研究还是工业应用,LLM-Fuzzer 都为 LLM 安全生态提供了重要支撑——不仅能帮助发现模型漏洞,更能推动防御机制的持续优化,最终促进 AI 系

本文介绍了机器学习中两种核心优化算法:梯度下降法和牛顿法。梯度下降法基于一阶泰勒展开,通过计算损失函数的梯度来更新参数,适用于高维参数空间和深度学习场景。牛顿法引入二阶导数(海森矩阵),收敛速度更快但计算成本较高,适合小规模模型优化。文章详细推导了两种方法的数学公式,并对比了其适用场景:梯度下降计算简单适合大规模数据,牛顿法精度高但计算复杂。最后还介绍了梯度下降的三种变体(BGD、SGD、Mini