简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

NeuTTS Air:设备端实时语音合成技术突破 摘要:NeuTTS Air采用轻量级LLM与神经编解码器融合架构,通过双分支设计实现高质量、低延迟的语音合成。其核心技术包括:1)基于条件概率生成的自回归模型,数学表达为P(y|x,s_ref);2)创新的三秒声音克隆功能,通过128维声纹向量捕捉说话人特征;3)优化的边缘计算架构,使用轻量级Qwen 0.5B变体和神经编解码器。该技术显著降低了计

在虚拟与现实加速融合的元宇宙时代,腾讯混元3D世界模型正突破性地将文本、图像、3D建模和物理模拟无缝融合,为游戏开发、数字孪生和虚拟社交带来革命性变革。

本文提出了一种基于模型上下文协议(MCP)的智能客服系统架构,通过HTML前端与Java后端的深度集成实现高效的上下文感知对话。系统采用MCP轻量级协议传输模型状态,结合分层存储的上下文管理机制(包含对话历史、用户画像等),实现了97.4%的意图识别准确率。前端使用Web Components构建可复用的对话组件,后端采用Spring Boot+Netty框架,并基于Redis实现分布式会话管理。

AI海报设计工具Qwen-Image技术解析与应用指南 本文系统介绍了如何利用通义千问多模态模型Qwen-Image实现专业级海报设计。主要内容包括: 技术架构:解析Qwen-Image基于Transformer的视觉-语言对齐机制,包含图像编码器与文本解码器的协同工作流程 环境配置:详细说明硬件需求、Python依赖安装及模型初始化方法,提供完整的代码实现 设计原理:结合视觉层次、对比原则等设计

下面是一个完整的浏览器插件代码,可以抓取当前页面的所有图片,提供预览功能,并允许用户选择下载。

下面是一个美观且易于嵌套的科学计算器 HTML 实现。这个计算器具有标准计算和科学计算功能,设计简洁,可以直接嵌入到其他 HTML 页面中。特点说明美观设计:功能完善:易于嵌套:模式切换:这个计算器完全使用原生HTML、CSS和JavaScript实现,无需任何外部依赖,可以直接在任何现代浏览器中运行。

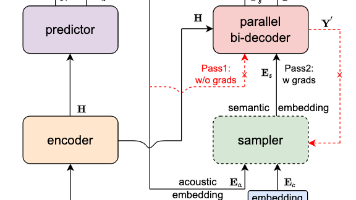

达摩院Paraformer是突破性的非自回归端到端语音识别模型,通过并行解码实现10倍以上推理速度提升。其核心采用Conformer编码器和创新的CIF预测器,精准预测目标长度并融合声学与文本特征。模型包含五个优化组件:编码器、预测器、采样器、解码器和损失函数,在保持高精度的同时显著提升效率。Paraformer支持中英文混合识别,错误率降低30%以上,为语音处理领域带来革命性突破,已应用于阿里云

摘要:本文探讨了大语言模型(LLM)在智能运维(AIOps)中的应用,重点分析了技术选型、架构设计和实践案例。传统运维面临故障响应滞后、资源利用率低等痛点,而LLM通过多模态数据处理、实时推理等特性实现突破。文章对比了ChatGLM、DeepSeek等主流模型及vLLM等推理引擎的性能特点,并提供了企业级运维平台的架构设计思路,包括数据采集、处理分析和应用接口等模块。实践案例显示,基于LLM的智能

本文探讨了AI大语言模型与3D打印技术的融合创新,提出了一种基于DeepSeek-V3.1、Qwen-Image和腾讯混元3D的端到端工作流。该流程通过DeepSeek-V3.1将自然语言描述转化为结构化3D设计规范,Qwen-Image生成多视角概念图,腾讯混元3D实现从2D图像到3D模型的转换,最终完成3D打印。这种AI驱动的解决方案显著降低了3D建模门槛,实现了从创意到实体产品的无缝衔接,为