简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

我们已经学习了如何实现深度Q网络 (Deep Q-Network, DQN) 模型,证明了非线性近似器完全可用于强化学习,这一概念验证极大地推动了深度Q学习乃至整个深度强化学习领域的研究热潮。在本节中,我们将重点探讨如何定义强化学习高级组件,使用更高级的模块构建代码,并聚焦于所实现方法的核心细节,避免反复实现相同的逻辑,避免重复造轮子的低效劳动。

在 PyTorch 深度学习模型部署一节,我们学习了如何使用 Flask 库创建可远程部署、通过网络提供预测服务的模型服务器。在本节中,我们将继续讨论使用 TorchServe 将一个已经训练并测试过的 PyTorch 深度学习模型对象部署到一个独立的环境中,使其能够对新输入数据进行预测或推理。这也称为模型的生产化,即将模型部署到生产系统中。

在 PyTorch 深度学习模型部署一节,我们学习了如何使用 Flask 库创建可远程部署、通过网络提供预测服务的模型服务器。在本节中,我们将继续讨论使用 TorchServe 将一个已经训练并测试过的 PyTorch 深度学习模型对象部署到一个独立的环境中,使其能够对新输入数据进行预测或推理。这也称为模型的生产化,即将模型部署到生产系统中。

在本节中,我们探讨了如何将训练好的 PyTorch 深度学习模型部署到生产环境中,成功构建了一个独立运行的模型服务器,能够对手写数字图像进行预测。这套方法可以轻松扩展至其他机器学习模型,这为使用 PyTorch 和 Flask 开发机器学习应用开辟了无限可能。

在本节中,我们探讨了如何将训练好的 PyTorch 深度学习模型部署到生产环境中,成功构建了一个独立运行的模型服务器,能够对手写数字图像进行预测。这套方法可以轻松扩展至其他机器学习模型,这为使用 PyTorch 和 Flask 开发机器学习应用开辟了无限可能。

在本节中,我们将学习如何借助 torch.amp.autocast 和 torch.amp.GradScaler 等 API 实现混合精度训练,在加快深度学习模型训练速度的同时降低内存占用,使用 PyTorch 的自动混合精度 (Automatic Mixed Precision, AMP) 工具,加速训练并减少内存消耗。

从资源角度来看,用强化学习 (Reinforcement Learning, RL) 处理 Atari 游戏颇具挑战性。为提升效率,需要对 Atari 游戏交互应用多种变换。其中部分变换仅影响性能,另一些则针对 Atari 平台特性——这些特性会导致学习过程漫长且不稳定。这些变换可以通过 Gymnasium 库的各类包装器实现,其中 stable-baselines3 (SB3) 代码库是最常用的

在本节中,我们将探讨如何通过跨机器和机器内多进程的分布式训练来加速模型训练过程。我们将系统学习 PyTorch 提供的三大分布式训练 API——torch.distributed、torch.multiprocessing 以及 torch.utils.data.distributed.DistributedSampler,使用这些 API 能够极大的简化分布式训练,介绍如何使用 PyTorch

在本节中,我们深入讨论了如何利用神经网络近似Q值,以及这种近似方法带来的额外复杂性。在深度Q网络 (Deep Q Network, DQN) 部分,还介绍了几种提高 DQN 训练稳定性和收敛性的技术,包括经验回放缓冲池、目标网络和帧堆叠机制。最终,我们将这些扩展技术整合为一个完整的 DQN 实现方案,成功解决了 Atari 游戏系列中的 Pong 环境。

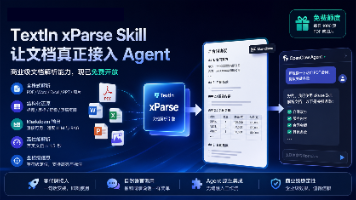

TextIn xParse Skill 是一个面向 Agent 生态的免费文档解析工具,旨在解决 Agent 无法有效读取PDF、图片、Office 文件等非结构化数据的核心痛点。该工具将商业级文档解析能力以免费 Skill 形式开放,核心能力包括:支持十余种格式的全格式兼容、完整保留文档结构、百页文档约 1.5 秒的极速解析、输出适合 LLM 理解的 Markdown 格式,以及提供精确的坐标信