简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

当你还在为构建复杂 AI 智能体系统而头疼时,谷歌已经悄悄开源了一款能让开发者 "如虎添翼" 的工具包。

本报告聚焦 2025 年全球领先企业的智能体实践应用,重点呈现不同技术类型和行业领域的标杆案例,展示智能体技术的商业化价值与落地路径。

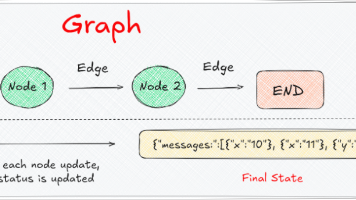

不少朋友留言说有些基础概念不太清楚,比如State到底是什么、节点之间怎么传递数据、为什么要用TypedDict等等。今天咱们就把这些知识点彻底讲透,保证你看完就能上手写代码。

这里给大家一款国产的大模型部署框架:LMDeploy,它是由上海人工智能实验室牵头开发的。

以人工智能为核心,能提供高效便捷的日常服务。应用集成语音交互、智能家居联动、日程规划等多项功能,帮我们从容处理各项事务,体验更智能、更轻松的生活方式。界面简洁易用,覆盖多样场景,全面满足我们个性化需求。

Agent2Agent (A2A) 协议是一个开放标准,专门解决AI智能体生态系统中的核心挑战:如何让不同团队、使用不同技术、属于不同组织的AI智能体有效沟通和协作?

计算机与人工智能学院赵宇教授领衔,与电子科技大学任福继院士联合主编的研究生人工智能精品教材《自然语言处理:大模型理论与实践》(预览版),目前线上发布。该教材获我校2024年度研究生“中央高校教育教学改革专项”立项资助,并由中国人工智能学会原理事长钟义信院士作序。

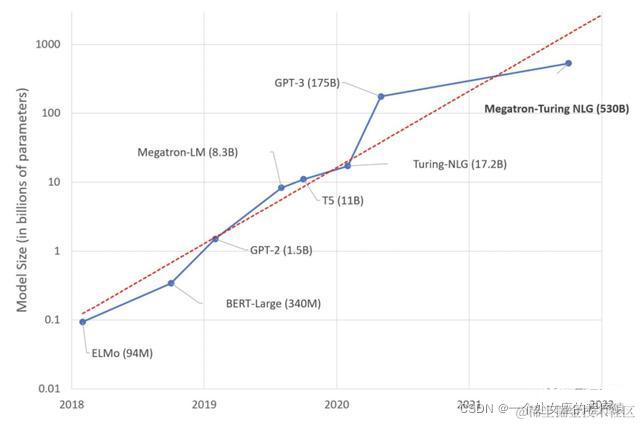

目前来看,通过大规模数据训练超大参数量的巨量模型,被认为是非常有希望实现通用人工智能的一个重要方向。”随着巨量模型的兴起,巨量化已成为未来人工智能发展非常重要的一个趋势。而巨量化的一个核心特征就是模型参数多、训练数据量大。

构件LLM的应用时,Anthropic建议从简单的解决方案开始,必要时才增加复杂性。智能系统可以分为基于固定工作流的工作流和自主决策的智能体,使用场景视需求而定,选择框架以辅助为目的而非增加复杂性

在当前的人工智能和自然语言处理领域中,多个大模型正在不断推动技术的前沿发展。这些大模型的智能水平可以通过一系列的标准化基准测试来评估,如MMLU、GPQA、MATH、MGSM、DROP和HumanEval。