简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

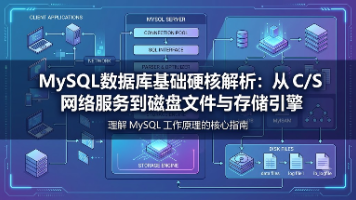

本文阐述了数据库的本质与MySQL的核心架构。数据库不仅是数据存储工具,更是一套结构化数据管理解决方案,提供查询、事务、并发控制等高级功能。MySQL采用C/S架构,客户端接收SQL指令,服务端负责解析执行并管理底层数据文件。文章揭示了数据库在逻辑层(库/表/行)和物理层(Linux文件)的对应关系,介绍了SQL分类(DDL/DML/DQL/DCL)及主流数据库特点,重点解析了MySQL插件式存储

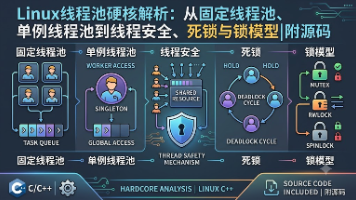

本文两万字深入解析了一个基于C++的线程池实现,从工程设计到内核机制全面拆解。主要内容包括: 线程池核心设计 采用固定线程数模式,提前创建工作线程 任务队列使用std::queue+互斥锁保护 条件变量实现线程休眠/唤醒机制 遵循"锁内取任务、锁外执行"原则避免死锁 关键技术点 线程同步:互斥锁、条件变量 任务封装:std::function<void()> 线程安

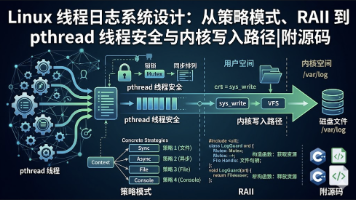

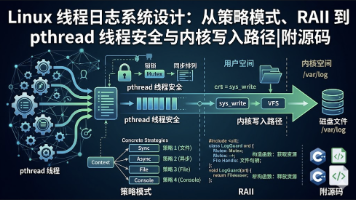

本文介绍了一个基于C++17的多线程日志系统实现,采用策略模式设计,支持控制台和文件两种日志输出方式。系统核心特点包括:1. 结构化日志格式,包含时间戳、日志等级、进程PID、文件名和行号等关键信息;2. 策略模式实现输出目标解耦,便于扩展新的输出方式;3. RAII机制自动管理日志刷新,通过临时LogMessage对象实现流式输出;4. 线程安全设计,使用Mutex和LockGuard保护共享资

本文介绍了一个基于C++17的多线程日志系统实现,采用策略模式设计,支持控制台和文件两种日志输出方式。系统核心特点包括:1. 结构化日志格式,包含时间戳、日志等级、进程PID、文件名和行号等关键信息;2. 策略模式实现输出目标解耦,便于扩展新的输出方式;3. RAII机制自动管理日志刷新,通过临时LogMessage对象实现流式输出;4. 线程安全设计,使用Mutex和LockGuard保护共享资

本文深入探讨了Linux多线程编程中的线程同步问题,重点分析了生产者-消费者模型的实现原理与工程实践。文章从互斥与同步的基本概念入手,详细解析了条件变量、阻塞队列、信号量和环形队列等同步机制,并揭示了其底层依赖的futex内核机制。主要内容包括:1. 生产者-消费者模型的三种关系(竞争与同步)和两种角色;2. 条件变量的正确使用方法及防止"丢失唤醒"的关键机制;3. 阻塞队列与

本文面向开发者群体,以通俗化视角系统科普大语言模型(LLM)核心知识,助力技术人员掌握AI时代核心底层逻辑。文章区分了传统模型与大模型的本质差异,阐释LLM基于Transformer神经网络、自监督学习的训练原理,点明其**下一词预测**的核心本质,并讲解RLHF对齐技术对模型输出的优化作用。同时梳理了大模型参数量大、通用性强、涌现能力突出等核心特征,汇总当前主流开源与商用LLM生态。文章全面拆解

本文深入探讨了多线程并发中的安全隐患及解决方案。通过抢票Demo展示了共享资源访问导致的数据安全问题,分析了tickets--操作在汇编层面的非原子性本质。重点介绍了互斥锁(Mutex)的实现原理和使用方法,包括硬件关中断方案和软件原子交换指令方案。文章还提出了RAII风格的锁守卫封装方案,确保临界区安全访问的同时避免死锁。最后指出互斥锁可能导致的线程饥饿问题,为后续讨论线程同步和生产者-消费者模

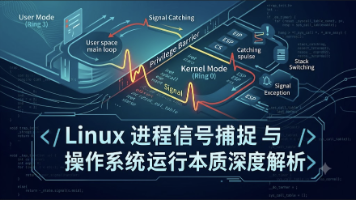

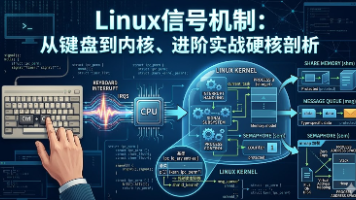

本文深入剖析了Linux信号机制与内核态/用户态的底层原理。信号作为软件中断,实现了进程间异步通信和异常处理。文章从硬件中断出发,详细讲解了用户态(Ring3)与内核态(Ring0)的权限隔离、内存管理机制,以及信号处理的"双8字"流程:内核修改返回地址跳转用户态执行信号处理函数,再通过sigreturn系统调用恢复现场。同时探讨了可重入函数的安全隐患和volatile关键字的

本文深入解析了Linux进程信号的原理与处理机制。信号是操作系统与进程通信的重要方式,属于软中断,具有异步性和延迟处理的特点。文章详细介绍了信号的分类(普通信号和实时信号)、保存方式(通过PCB中的位图实现)以及三种处理动作(默认、忽略和自定义捕捉)。通过代码示例演示了signal函数的使用方法,并指出9号和19号信号无法被忽略或自定义捕捉。同时分析了信号的多种产生方式,包括终端按键、系统调用、软

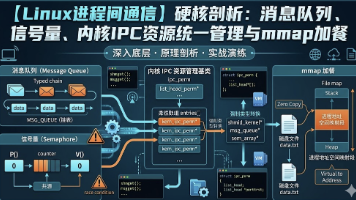

本文深入剖析了SystemV IPC机制,重点探讨了消息队列和信号量的实现原理。消息队列通过类型标签实现选择性读取,内核使用双向链表管理消息;信号量则通过PV原语保护临界资源,采用计数器+等待队列机制。文章揭示了Linux内核如何利用C语言实现多态:所有IPC资源都包含kern_ipc_perm基类,通过全局ipc_ids数组统一管理。最后介绍了mmap文件映射机制,并演示了如何用mmap模拟ma