简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

文章摘要: AI大模型(LLM)是基于Transformer架构的海量参数神经网络,通过预训练和微调学习文本统计规律,实现对话、写作等复杂能力。其核心是自注意力机制,能并行处理序列信息。2022年ChatGPT的爆发让LLM进入大众视野。大模型的三大支柱为Transformer架构、预训练(知识获取)和RLHF对齐(人性化输出)。本质上,LLM是预测下一个token的概率模型,其推理流程为持续生成

文章摘要: AI大模型(LLM)是基于Transformer架构的海量参数神经网络,通过预训练和微调学习文本统计规律,实现对话、写作等复杂能力。其核心是自注意力机制,能并行处理序列信息。2022年ChatGPT的爆发让LLM进入大众视野。大模型的三大支柱为Transformer架构、预训练(知识获取)和RLHF对齐(人性化输出)。本质上,LLM是预测下一个token的概率模型,其推理流程为持续生成

文章摘要: AI大模型(LLM)是基于Transformer架构的海量参数神经网络,通过预训练和微调学习文本统计规律,实现对话、写作等复杂能力。其核心是自注意力机制,能并行处理序列信息。2022年ChatGPT的爆发让LLM进入大众视野。大模型的三大支柱为Transformer架构、预训练(知识获取)和RLHF对齐(人性化输出)。本质上,LLM是预测下一个token的概率模型,其推理流程为持续生成

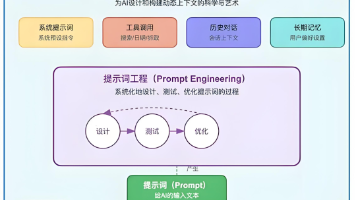

摘要: 随着大语言模型(LLM)能力的提升,**上下文工程(Context Engineering)**成为AI智能体开发的核心技术,由前特斯拉AI总监Andrej Karpathy提出并推动。上下文是LLM的“心智世界”,包含指令、知识、工具反馈和历史轨迹,决定模型的行为与认知边界。由于上下文窗口资源有限,需通过四大策略优化管理:写上下文(便签、记忆)、选上下文(动态检索关键信息)、压缩上下文(

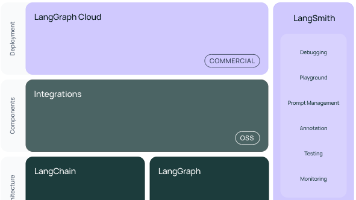

摘要:AI智能体开发工具分类及LangChain生态解析 本文系统分析了AI智能体开发工具的三大类别: 框架型(如LangChain)提供抽象层和标准构建方式,简化开发但可能限制灵活性; 运行时(如LangGraph)专注生产环境需求,支持持久化执行、流式处理等基础设施能力; 工具集(如DeepAgents)提供开箱即用的预设功能,减少定制化开发。 作者指出三类工具界限存在模糊,但此分类有助于理解

本文提供了一份系统的AI大模型学习路线图,分为5个阶段:L1基础认知(Transformer架构、提示工程等);L2 RAG实战(检索增强生成、LangChain应用);L3 Agent开发(智能体架构设计、多Agent系统);L4模型优化(微调、量化、多模态);L5专题进阶(Llamalndex、GraphRAG等)。路线图包含理论解析和项目实战,适合各层次学习者,并强调持续跟踪行业动态。文末提

Resume Worded 是一个由顶级招聘人员设计的人工智能平台,旨在帮助求职者改善自己的简历和领英个人资料(LinkedIn,一个全球职场社交平台,主要用于招聘和求职)。Resume Worded 的“简历得分(Our Score My Resume)”功能可以即时反映用户的简历水平,而它的简历样本(Resume Samples)和简历定向工具(Resume Targeting tools)可

该模型有着非常高的人气热度,LibLib下载量将近2W。经典的好莱坞魅力,穿着惊艳晚礼服的女孩,耀眼的配饰,(迷人的眼睛,红唇,完美的皮肤),奢华的背景,天鹅绒窗帘,戏剧性的姿势,有趣的构图,聚光灯照明,丰富的阴影,浅景深,闪闪发光的散焦,精致的细节,高分辨率,35毫米胶片,永恒的优雅。风景,荒诞,超现实主义的生活,像纹理一样的虚拟照明,人工智能,获奖照片,尼康RAW照片,8k,富士胶片XT3,杰

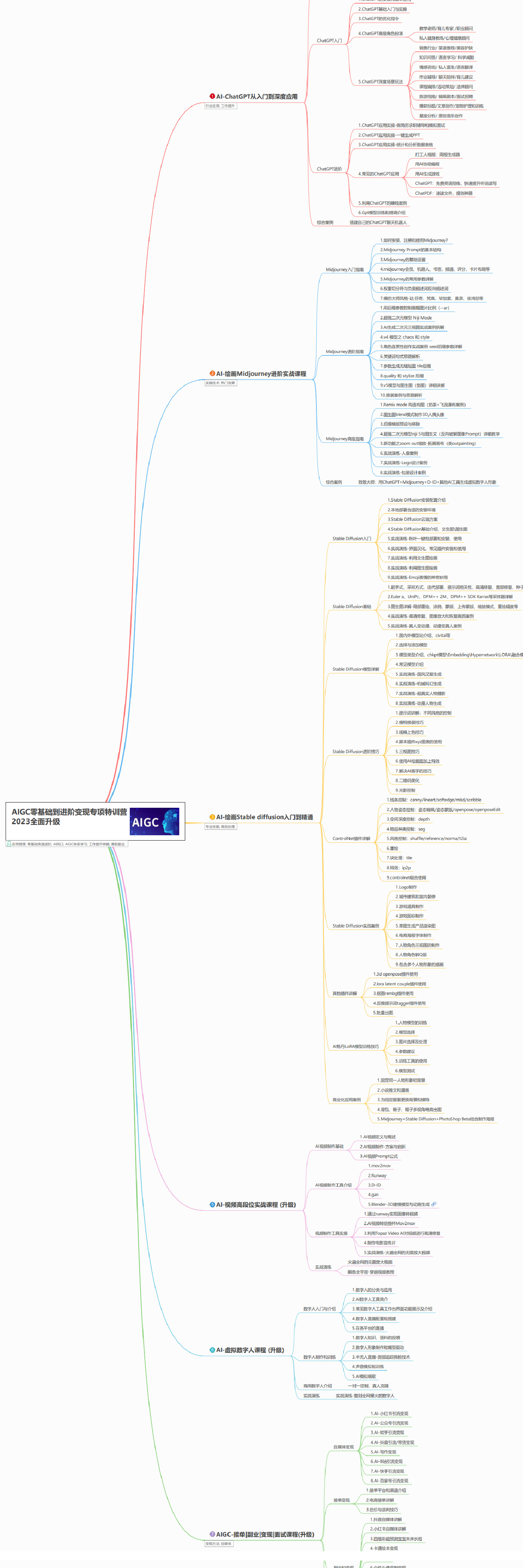

感兴趣的小伙伴,赠送全套AIGC学习资料,包含AI绘画、AI人工智能等前沿科技教程和软件工具,具体看这里。AIGC技术的未来发展前景广阔,随着人工智能技术的不断发展,AIGC技术也将不断提高。未来,AIGC技术将在游戏和计算领域得到更广泛的应用,使游戏和计算系统具有更高效、更智能、更灵活的特性。同时,AIGC技术也将与人工智能技术紧密结合,在更多的领域得到广泛应用,对程序员来说影响至关重要。未来,

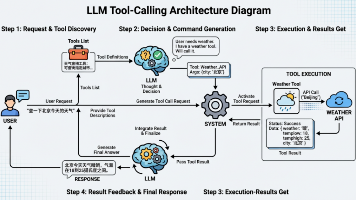

本文深入解析了AI Agent领域的三大核心技术:Function Calling、MCP和Skills。Function Calling作为基础桥梁,连接大模型与外部工具;MCP通过标准化协议解决接口适配问题;Skills则用文档化方式定义业务流程。文章指出,虽然Skills灵活性高,但存在结构化不足和UI适配问题,强调Function Calling仍是核心解决方案。最后介绍了Func-Age