简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

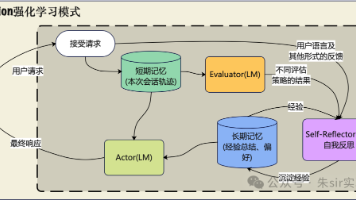

AI Agent设计中的反思模式解析 2025年,AI Agent通过大语言模型(LLM)技术实现企业级应用,其中反思模式(Reflection)成为提升智能体性能的核心机制之一。该模式通过自我评估与迭代优化(如代码生成准确率从48.1%提升至95.1%),显著改善任务执行效果。其实现包括Basic Reflection(生成器与评估器协作)和Reflexion强化学习框架(Actor-Evalu

机器学习入门精品文章机器学习是人工智能的一个分支,它使计算机系统能够从数据中学习并做出决策或预测,而无需明确编程。它涉及使用算法和统计模型来分析和解释数据,从而发现模式和关系。这些模式随后可以用于预测新数据的结果或分类数据。机器学习的关键技术包括监督学习、无监督学习、半监督学习和强化学习。监督学习通过标记的训练数据来训练模型,使其能够预测或分类新的输入数据。无监督学习则在没有标签的数据上工作,试图

大模型LLM(Large Language Models) 通常采用基于Transformer的架构。Transformer模型由多个编码器或解码器层组成,每个层包含多头自注意力机制和前馈神经网络。这些层可以并行处理输入序列中的所有位置,捕获长距离依赖关系。大模型通常具有数十亿甚至数千亿个参数,可以处理大量的文本数据,并在各种NLP任务中表现出色。

AI Agent可以定义为匹配各种任务的自主计算实体。与传统的基于提示的人工智能交互不同,自主Agent能更高效地处理任务,进而引领一个从半自主到全自主系统的转变周期。

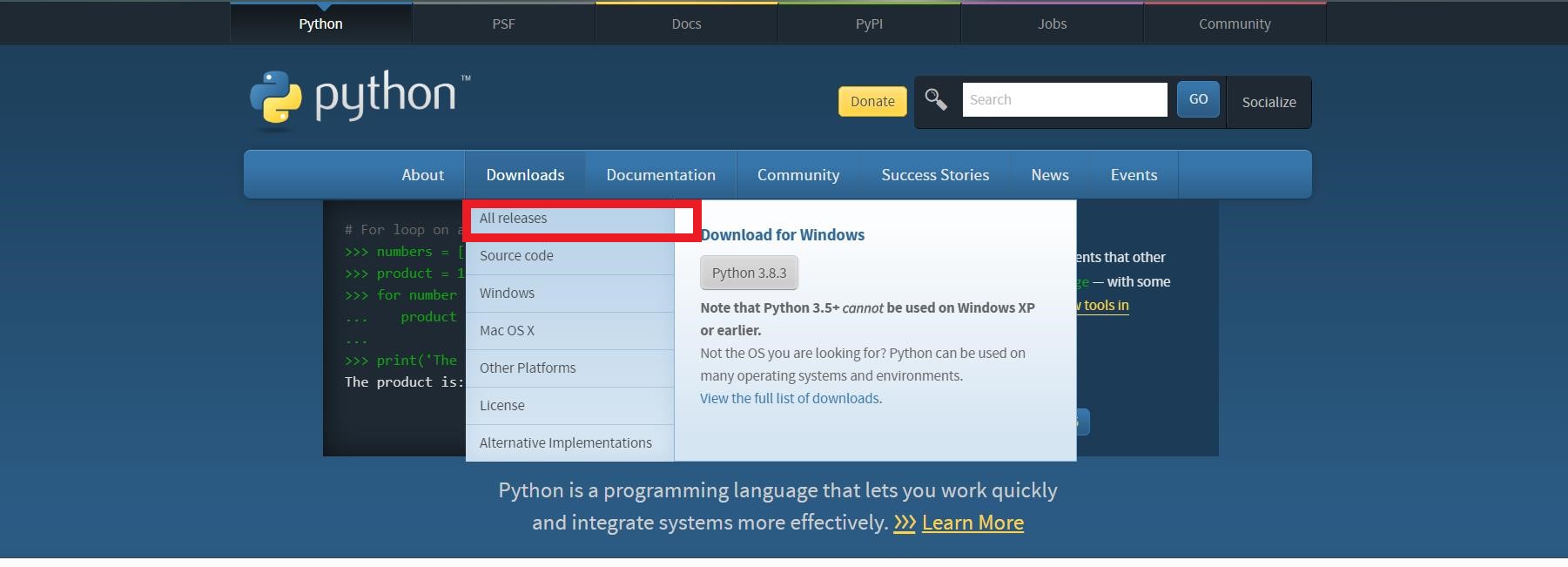

这套教程是完整的开发环境框架搭建,搭建完就能直接能上手敲代码不需要别的知识准备流程,在windows上搭建运行,安装过程按照下面的来,基本上不会出现像安装其他IDE那样可能出现各种路径配置等问题,对于急需提升自己的小白来说可以说得算是非常友好了。Jupyter notebook相对于pycharm来说,jupter更多用于数据探索和算法设计阶段,需要即是获得一段代码结果。pycharm更加适合于工

与其在AI抢占就业机会的危机中患得患失,不如快点接受这个新技术,将AI引入自己的工作中,通过AI来提升自己的生产力和创造力。AI大模型通过学习大量的图像数据和构建更深更复杂的神经网络,使计算机能够对图像进行更加准确的识别和分析。总的来说,“大模型”应该是基于具有超级大规模的、甚至可以称之为“超参数”的模型,需要大量的计算资源、更强的计算能力以及更优秀的算法优化方法进行训练和优化。大数据时代,越来越

在深度学习中,学习率(Learning Rate)是一个非常重要的参数,它决定了每次模型参数更新的步伐大小。学习率可以理解为模型“学习”的速度。如果学习率设置得太大,模型可能会在训练过程中跳过最优解,无法正确收敛;而如果学习率太小,模型的学习过程会非常缓慢,甚至可能陷入局部最优解,难以得到最佳效果。在深度学习的训练过程中,我们通常使用大量的数据来让模型从中学习。为了高效地处理这些数据,PyTorc

大型语言模型(LLM)是一种通过大量文本材料训练的人工智能系统,能够像人类一样理解和生成语言。通过使用机器学习技术识别训练数据中的模式和关联,这些模型能够提供逻辑上和上下文上适当的语言输出。

我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。那以下这些PDF籍就是非常不错的学习资源。学习大型人工智能模型,如GPT-3、BERT或任何其他先进的神经网络模型,需要系统的方法和持续的努力。既然要系统的学习大模型,那么学习路线是必不可少的,下面的这份路线能帮助你快速梳理知识,形成自己的体系。作为普通人,入局大模型时代

随着科技的飞速发展,人工智能(AI)已经不再是科幻电影中的遥远概念,而是成为了推动社会进步的重要引擎。在AI的众多技术分支中,大模型以其卓越的性能和广泛的应用前景,成为了科技领域的明星技术。作为程序员,你是否已经准备好迎接这一科技浪潮,深入学习并驾驭AI大模型这一强大工具?