简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Mac本地部署DeepSeek蒸馏模型指南:Ollama极简手册_mac 配置 和 deepseek 模型推荐

ollama和LLM(大型语言模型)的关系,类似于docker和镜像,可以在ollama服务中管理和运行各种LLM,下面是ollama命令的参数,与docker管理镜像很类似,可以下载、删除、运行各种LLM

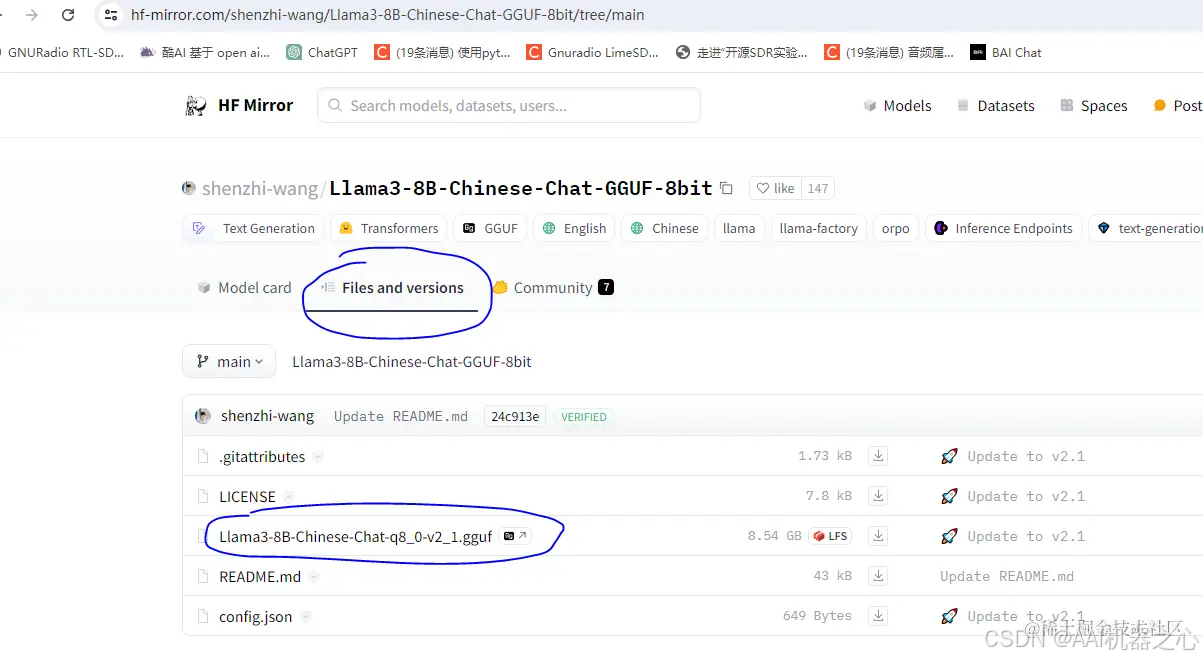

上次在Macbook Pro上安装了Stable Diffusion,体验了本地所心所欲地生成各种心仪的图片,完全没有任何限制的惬意。今天想使用Macbook Pro安装一个本地大语言模型体验一下,刚好在2024年4月18日,Meta在官网上宣布公布了旗下最新大模型Llama 3,并开放了80亿(8b)和700亿(70b)两个小参数版本,据说能力显著提升。遂开干。

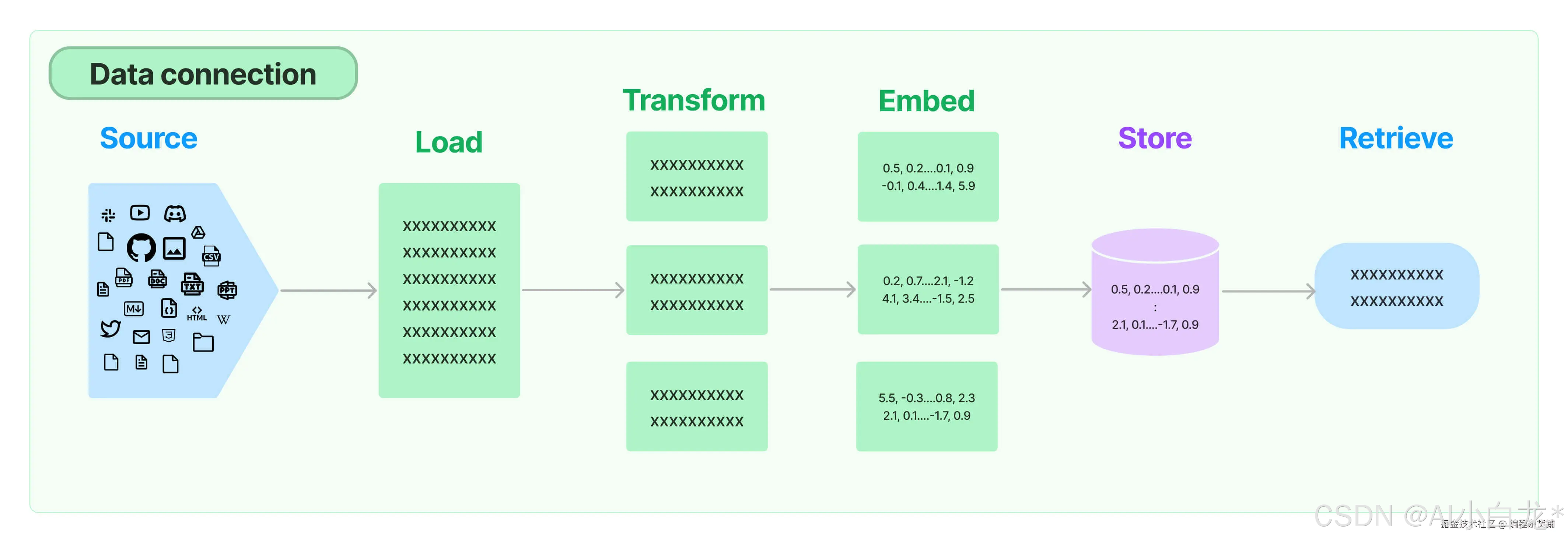

在我们看完 Langchain 基础之后,RAG 就是第二个难点。本文探索 langchain 中的 RAG 以及部分 langgraph RAG。

ollama主要针对主流的LLaMA架构的开源大模型设计,并且已被LangChain、Taskweaver等在内的多个热门项目高度集成。同时ollama提供了openAI兼容的api,可以最大限度的减少理解和开发成本。

现在大模型可谓是满天飞, 只要你稍微关注时下的AI资讯, 几乎每天都有新的AI大模型出现. 这之中当然有诸如GhatGPT, Gemini这样的私有化大模型, 更吸引人关注的可能是开源的可私有化部署的一些大模型.

某些场景下可能希望构建一个完全本地离线可用的大模型,方法很多,模型也很多,比如 qwen、qwen2、llama3等,最简单快捷的首推使用 ollama 部署,模型选用 qwen 或 qwen2,针对中文任务效果更好。

Langchain入门一:python+langchain+通义千问,白嫖千问大模型实现聊天机器人

LLaMA 模型因其高效的性能和较小的模型尺寸而受到关注,这使得它们能够在资源有限的环境中运行,例如个人计算机或移动设备。

langchain 不仅支持 Python 生态,也支持 TypeScript/JavaScript 生态,意味着开发者可以使用 JS 生态开发 AI 应用。