简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

使用了论文中提出的新型算子(如 Swin Transformer 中的窗口注意力)需要融合多个操作以减少内存拷贝(如 LayerNorm + GeLU 融合)原有算子不支持特定数据布局或精度(如 BF16 输入)此时,仅依赖内置算子将无法满足模型部署需求。CANN 提供的自定义算子机制允许开发者编写符合 NPU 硬件特性的高性能算子,并无缝集成到推理流程中。而项目正是官方提供的最佳实践模板库,帮助

是 CANN 生态中的一个关键子项目,专注于提供针对 Transformer 架构的大模型专用高性能算子。该项目旨在实现神经网络在 NPU 硬件上的加速计算,尤其适用于自然语言处理(NLP)、语音识别、多模态等任务中广泛使用的 Transformer 模型。以下是一个简化版的代码示例,展示如何基于实现一个轻量级的 Transformer 解码器层,并在 NPU 上执行推理。CANN 的开源项目为开

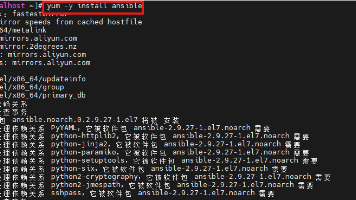

cpolar是一款安全高效的内网穿透工具,无需公网IP或复杂配置,只需一条命令,即可将本地服务器、Web服务或任意端口映射到公网,让你随时随地远程访问内网应用,特别适合开发调试、远程运维和应急部署等场景。cpolar 为 Ansible 打通了内网到公网的通道,让自动化运维工具的价值最大化,无论是日常定时清理日志,还是应急远程运维,都能高效完成,切实提升了运维工作的灵活性和效率。

性能调优不是玄学,而是基于数据的科学工程。为 CANN 开发者提供了“显微镜”和“雷达”,让每一个性能瓶颈无处遁形。无论是算法工程师、系统工程师还是运维人员,掌握这套工具链都将极大提升 AI 系统交付效率。最佳实践建议在模型部署初期就集成 profiling将性能指标纳入 CI/CD 流程定期使用msadvisor扫描新版本 CANN 的优化建议至此,我们已系统性地解读了 CANN 开源生态中的四

不仅仅是一个示例仓库,它是一套经过工业验证的AI 模型部署方法论。快速验证模型在 NPU 上的可行性避免重复造轮子,复用最佳实践构建可维护、可扩展的推理服务对于希望将 AI 模型从实验室推向生产环境的团队来说,深入研究是迈向高效部署的关键一步。建议行动:选择你当前项目中最核心的模型,在中找到最接近的示例,进行 1:1 迁移实验。如需继续探索其他 CANN 项目(如等),或希望了解特定模型(如 St

的存在,让开发者无需重复造轮子。无论是学术研究、产品原型还是工业部署,都能在这里找到高质量、即插即用的模型起点。它不仅是资源库,更是工程最佳实践的载体——每一个模型背后,都凝聚了格式转换、精度对齐、性能优化的大量工作。在 AI 进入“工业化”时代的今天,这样的基础设施,正是加速创新的关键。序号项目定位1高性能算子库2大模型推理引擎3数据预处理加速4模型压缩工具5性能剖析套件6分布式训练框架7NLP

不仅是一个工具,更是一种模型高效化范式的体现。它让开发者从繁琐的手动调优中解放出来,聚焦于业务逻辑本身。在“大模型时代”,压缩不再是可选项,而是必经之路。结合前文介绍的(高性能算子)与(统一部署接口),完成了 CANN 生态中“压缩 → 加速 → 部署” 的闭环,真正实现了端到端的 AI 高效计算流水线。下一期预告:我们将探索 CANN 中的分布式训练框架,看它如何支撑千亿参数模型的高效训练。欢迎

如果说是 CANN 生态中的“性能引擎”,那么就是它的“通用接口”——前者深挖算力极限,后者打通部署壁垒。两者相辅相成,共同构建起一个高效、灵活、开放的 AI 计算底座。随着国产 AI 芯片生态的成熟,像这样的抽象层将变得愈发重要。它不仅降低了开发者门槛,也为软硬协同创新提供了坚实基础。下一期,我们将继续探索 CANN 中的模型压缩工具链或分布式训练框架,敬请期待!注:本文所有内容均基于 CANN

不仅是 CANN 生态中的一项关键技术成果,更是国产 AI 算力自主创新的重要体现。它通过对核心算子的精细化优化,实现了从“能跑”到“跑得快”的跨越,为大模型落地提供了坚实支撑。如果你正在从事 AI 模型开发或部署工作,不妨尝试接入,体验真正的高性能计算魅力。同时,也欢迎加入 CANN 开源社区,一起共建更强大的 AI 未来!项目地址官方文档本文基于 CANN 开源项目内容撰写,所有信息均来自公开

pipeline:streams:# ... 其他流配置类似modules:decoder:dvpp_h264:sink:✅ 所有硬件加速(DVPP 解码、NPU 推理)自动启用,无需编码。mindx-sdk不仅是一个推理 SDK,更是一种AI 应用开发范式的革新。它将复杂的系统工程抽象为声明式配置与插件逻辑,极大提升开发效率与系统可靠性。无论是智慧城市、工业质检还是智慧零售,只要涉及视频/图像智