简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

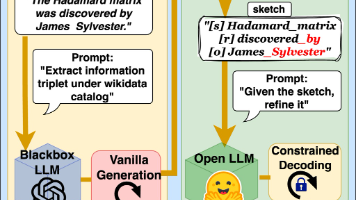

摘要 大语言模型(LLMs)传统上以自由文本输出为主,但其缺乏结构化限制了机器解析和系统集成的能力。本文探讨了LLMs生成结构化输出的技术演进,从提示词引导、验证修复框架到约束解码等六大方法,旨在提升输出的机器可读性、一致性与可靠性。结构化输出通过预定义格式(如JSON、XML)显著降低了模型幻觉风险,成为连接AI模型与软件系统的关键接口。报告详细分析了各项技术的原理、实践与局限,为构建可扩展的A

在实现文本分类、信息抽取、文本匹配等任务时,可以采用两种主要的方法。首先,可以对一些基础模型进行微调训练,以适应特定任务的需求。这种方法通常需要标注数据,通过调整模型参数来提高其在特定任务上的表现。其次,基于大模型(如预训练的语言模型)进行任务实现也是一种有效的方法。大模型通常在大规模数据上训练,具备较强的泛化能力和理解能力,可以通过少量的示例进行少量学习(few-shot learning)或零

大语言模型(LLM):从实用技巧到核心原理的深度解析,一文看懂!

酒店客服电话,以下场景大家是否似曾相识?我在前台办入住,耐着性子站了十几分钟,期间前台小姐姐接了5个电话,打出3个电话,在终于办好入住后,她居然还对我营销起会员卡,等待的不耐之火,一下子顶到脑门上。我们客服中心一直跟我申请加人,说高峰期实在接不过来电话,总被投诉打电话没人接,服务不及时,但是目前的情况,加人的成本和管理成本实在太高了。

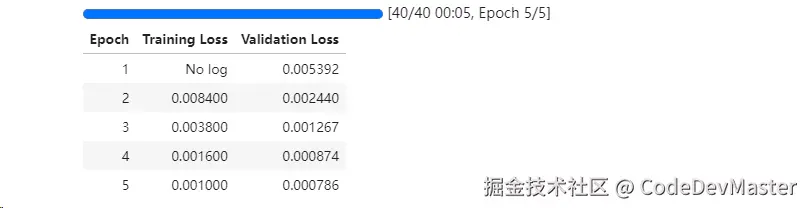

要训练一个与您写作风格相近的DeepSeek模型,需结合数据准备、模型微调(Fine-tuning)和风格控制技术。以下是具体步骤和注意事项:### **一、数据准备(关键步骤)**1. **收集个人文本数据**来源:博客、邮件、日记、社交媒体帖子、创作文稿等(建议至少10万字,覆盖不同主题和文体)。格式:纯文本(`.txt`)、Markdown或结构化数据(如JSON)。质量:删除无关内容(如他

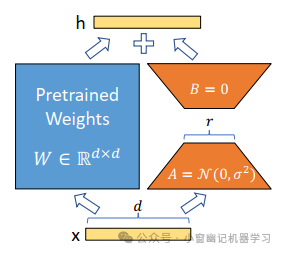

Lora方法,即在大型语言模型上对指定参数增加额外的低秩矩阵,并在模型训练过程中,仅训练而外增加的参数。当“秩值”远小于原始参数维度时,新增的低秩矩阵参数量很小,达到仅训练很小的参数,就能获取较好的结果。Lora论文:https://arxiv.org/abs/2106.09685官方代码:https://github.com/microsoft/LoRAHuggingFace封装的peft库:h

更适配中文的来了——来自中国电信人工智能研究院,AI领域Fellow大满贯科学家李学龙带队,发布首个能听懂30多种多方言混说的大模型。号称最难方言、“魔鬼的语言”的温州话,也不在话下。还有超自然的语音生成能力。在2024智算云生态大会上,被官宣发布并开源。要知道,当前语音模型开源开放本来就少,而针对方言更是特定方言特定模型。开源且支持30种方言,有且只有星辰这么一个。作为首个完成大语言模型的研发且

本文从数据角度对比了 AI Agent 工程师与传统后端开发的薪资和岗位数量,指出 AI Agent 工程师是当前及未来的真风口。文章详细介绍了 AI Agent 工程师的核心技能树,包括大模型 API 调用、MCP 部署、Skills 开发、Agent 框架和工程化能力。此外,还提供了 3 个月的快速入行路线图,并开源了 AI Agent 面试题库,帮助读者从零开始掌握 AI Agent 开发。

本文分享了企业团队开发基于大语言模型的智能客服系统时遇到的五大常见错误:过度设计多Agent架构、不必要地将工具交给Agent、使用JSON而非Tool获取参数、让大模型输出前端组件,以及对开发细节考虑不足。这些问题的根源在于对Agent和LLM理解不足,作者建议非必要不用多Agent,确定性功能应在代码中直接调用,需要决策的功能才用Tool,并提供了开发原则和学习资源。文章还探讨了AI时代下大模

AI Agent开发不是一条捷径,而是一条更难更卷但也是未来的趋势和风口的路。正如一位业内人士所言:“搞AI听起来很高大上,其实做AI应用,讲1-2小时,自己摸索一天就入门了,脑子灵活一个月就能玩熟这一套了。所以,如果你对AI感兴趣,不要犹豫,从现在开始学习,但要记住:AI Agent开发不是放弃后端,而是后端基础上的升级。当你掌握了扎实的后端基础,再学习AI Agent开发,你将成为AI时代的"