简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

参考资料:部署DeepSeek-V3、R1模型浮点权重至少需要4台Atlas 800I A2(8x64G)服务器,W8A8量化权重至少需要2台Atlas 800I A2(8x64G服务器)上述方法可将deepseek量化为W8A8或者W8A16模型。

YOLOYOLO是与SSD齐名的one_stage目标检测算法代表。SSD系列有比较多的变体,大部分都不是SSD作者做的工作。而YOLO目前已经进化到V3,据我所知都是yolo作者自己做的工作。网络结构由于yolo属于one_stage的目标检测算法,所以网络结构比较简单。固定输入448x448大小的图片,最后输出7x7x30大小的特征图。作者的主干网络受GoogLeNet的启发,共有...

前言最近有一篇综述目标检测的论文《Deep Learning for Generic Object Detection: A Survey》,来自首尔国立大学的 Lee hoseong 在近期开源了「deep learning object detection」GitHub 项目,正是参考该论文开发的。该项目集合了从 2013 年 11 月提出的 R-CNN 至在近期发表的 M2Det 等几十篇.

概述本文主要内容来自参考资料《mage Alignment (Feature Based) using OpenCV (C++/Python)》本文讲述使用opencv中基于特征的的图像对齐方法。这里将会把手机拍摄的表单和与表单的模板对齐。这里用到的技术被称为基于特征的图像对齐,因为在这种技术中,要在一个图像中检测到一组特征点,并与另一张图像中的特征点相匹配。然后根据这些匹配的特征...

在编译openpose过程中,有一步会去下载官方预先训练的caffe模型文件到‘源码/model’目录下。但是在大陆下载还是很慢的,经常中断,实在不能忍。我下载后备份到百度云盘上供大家下载使用:链接:https://pan.baidu.com/s/1qNB-AZFRL0JeTAmAL_xPSA 密码:t9uu里面的文件包括:pose_iter_584000.caffemodel...

可以使用llm.generate()或者llm.chat()进行推理。使用后者的时候必须传入chat_template参数。》介绍使用vllm将大模型服务化。实际上vllm也支持离线推理。我写了一个离线推理的例子,并且可以让用户多次输入。我之前写过一个博客《

"content": "你是我的小助理"},"content": "告诉我你是谁"],}'

假设"deepseek-ai/DeepSeek-R1-Distill-Qwen-32B"被下载到了/mnt/llm_deploy/目录下,则模型的绝对路径是/mnt/llm_deploy/DeepSeek-R1-Distill-Qwen-32B,后面部署会用到这个目录。上面映射了目录/mnt/llm_deploy/到容器内部的/home/llm_deploy,则容器内看到的模型目录是/home/l

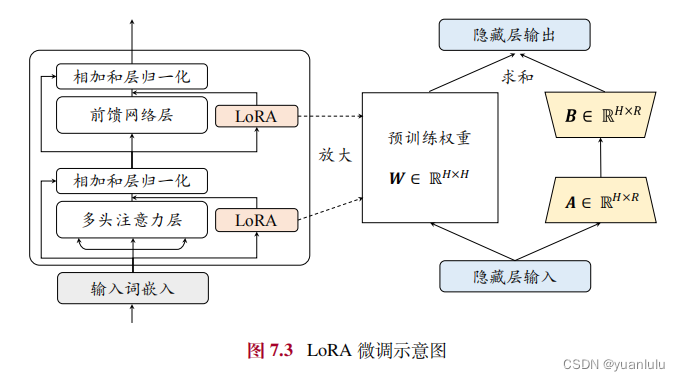

LoRA 提出在预训练模型的参数矩阵上添加低秩分解矩阵来近似每层的参数更新,从而减少适配下游任务所需要训练的参数。

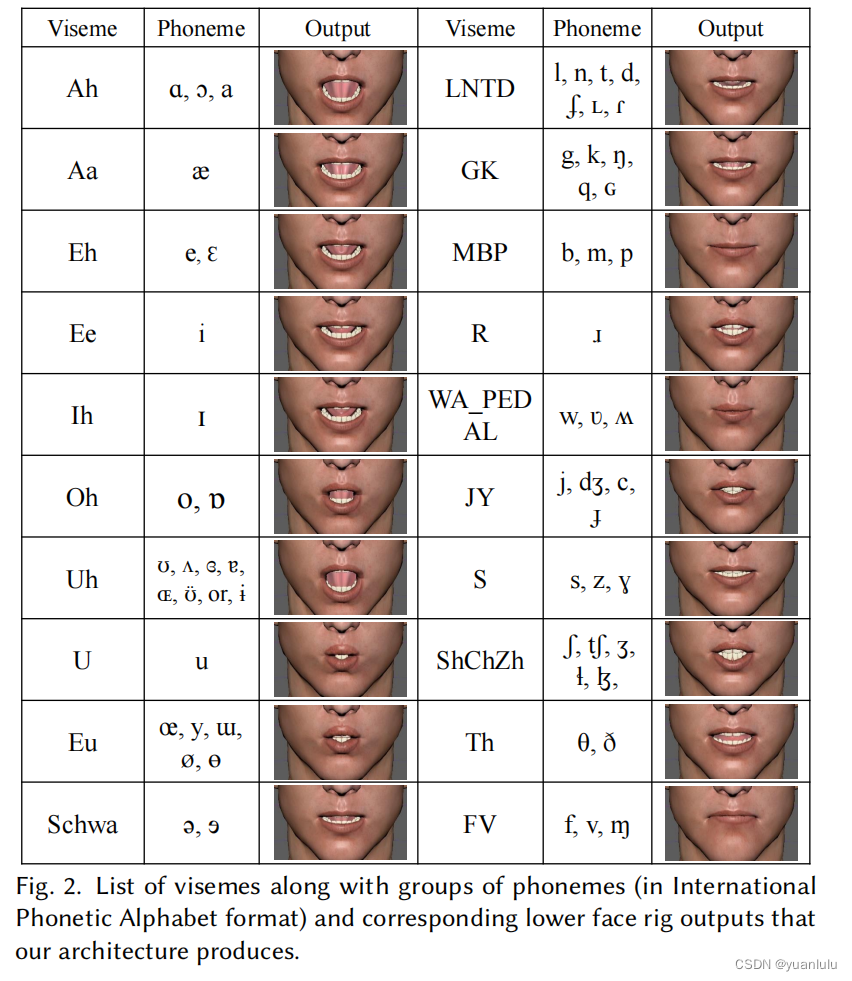

看官网资料,他们主要是做口型动画的,他们的主要方法和概念在论文《》里有介绍。他们通过观察发现,人们发音时的动作有两个重要维度,一是下巴骨骼的运动,二是嘴部肌肉的运动。而不同的说话"风格",可以通过调整这两个维度从而捕捉到更有表达力的口型。比如同一个人用不同的情绪来发同一个音素,其口型差距巨大。不同的发音方法对应的嘴唇宽度和下巴位移量都不一样。在JALI的坐标轴中,五种风格的发音分布如下。其横坐标是