简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

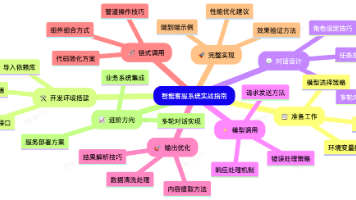

本文介绍如何利用LangChain框架和通义千问大模型快速搭建AI客服系统。首先需要获取通义千问API Key作为访问凭证,然后通过导入必要工具包搭建基础框架。文章详细说明了创建大模型客户端的步骤、设计对话角色、调用大模型以及优化输出结果的方法,并提供了完整的代码示例。通过链式调用方式简化代码流程,最终实现一个简单的AI翻译助手功能。文章还指出了后续学习方向,包括添加多轮对话、接入业务系统等功能扩

腾讯最新研究提出无需训练的强化学习方法Training-Free GRPO,通过上下文优化而非参数微调提升大模型性能。该方法让冻结的大模型并行采样多条轨迹,用奖励模型打分后生成自然语言总结和优劣解释,将"数值优势"转化为"语义优势"存入外部经验库。推理时将这些经验作为提示词拼接,即可引导输出向高奖励方向偏移。实验显示,仅用100条样本、约18美元成本就在AI

摘要:本文介绍了如何使用MCP(大模型控制协议)访问MySQL数据库,实现自然语言查询数据库信息的功能。通过MCP配置,大模型能够自动理解数据库结构和执行查询,无需用户提供技术细节。实验展示了查询用户登录记录和表分区情况的应用示例,证明MCP可有效降低数据分析的技术门槛,使业务人员能直接与数据交互,显著提升工作效率。文章最后指出AI大模型是当前技术趋势,并提供了相关学习资源。

摘要:本文介绍了如何通过MCP协议实现自然语言访问PostgreSQL数据库。详细说明了在不同环境(Windsurf、cursor等)下配置PostgreMCP服务的方法,并通过查询用户登录记录的实例演示了AI如何自动调用MCP执行数据库操作。文章指出MCP协议提供了一种安全的只读数据访问方式,特别适合非技术人员使用,并强调在当前IT行业转型期,掌握AI大模型技术的重要性。最后附上了适合新手学习大

这篇综述系统性梳理了强化学习(RL)在大型推理模型(LRM)领域的最新进展。研究表明,相比监督微调(SFT),RLVR(可验证奖励的强化学习)通过提供客观、可验证的奖励信号,能更有效提升模型的泛化推理能力。综述指出RLVR的三大关键要素:可验证奖励机制、无Critic优化算法和动态采样策略,并探讨了当前关于RL是否创造新知识的核心争议。最后提出了包括持续强化学习、基于模型的RL等九大未来研究方向,

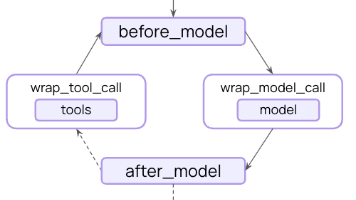

LangChain 1.0 和 LangGraph 1.0 正式发布,标志着 AI 智能体开发进入新阶段。LangChain 1.0 着重简化 Agent 开发流程,提供一行代码创建 Agent、中间件控制和标准化输出等功能。LangGraph 1.0 则专注于生产级需求,提供状态持久化、内置存储和人工审核等企业级特性。两者互补性强,LangChain 适合快速原型开发,LangGraph 适用于

这篇综述系统性探讨了具身智能中的世界模型及其安全挑战。世界模型作为智能体的"脑内模拟器",通过预测未来状态来指导决策,在机器人、自动驾驶等领域应用广泛。文章提出三维分类框架(功能、时间、空间)对现有方法进行坐标化归类,并对比了不同领域代表性模型的性能表现。同时重点分析了世界模型在场景生成和控制任务中的安全隐患,包括视觉质量、时序一致性、交通规则遵守等方面的典型故障案例。研究为具

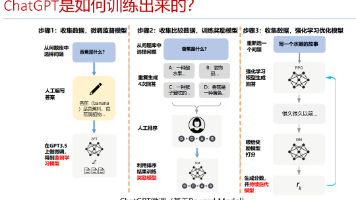

AI的核心目标是,例如语言理解、图像识别、复杂问题解决等。• 早期阶段:以规则为基础的专家系统,依赖预设的逻辑和规则。——规则库• 机器学习时代:通过数据训练模型,使机器能够从数据中学习规律。——几十、几百个参数• 深度学习时代:利用神经网络模拟人脑的复杂结构,处理更复杂的任务。——几百万个参数• 大模型时代:以大规模数据和算力为基础,构建通用性强、性能卓越的AI模型。

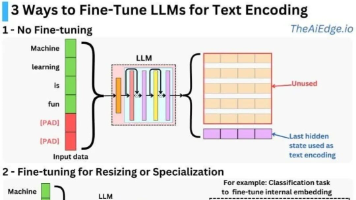

大语言模型Embedding技术演进:检索、分类与RAG的三步曲 摘要:本文探讨了大语言模型(LLM)文本编码(embedding)的核心技术路线演进。从最基础的预训练模型直接使用,到针对特定任务微调编码头,再到专门为RAG问答场景优化的bi-encoder架构,三种方式各具优势:原生LLM embedding适合快速验证;对比学习微调能显著提升分类和语义相似度任务效果;而RAG专用编码则实现了知

这篇综述系统性梳理了强化学习(RL)在大型推理模型(LRM)领域的最新进展。研究表明,相比监督微调(SFT),RLVR(可验证奖励的强化学习)通过提供客观、可验证的奖励信号,能更有效提升模型的泛化推理能力。综述指出RLVR的三大关键要素:可验证奖励机制、无Critic优化算法和动态采样策略,并探讨了当前关于RL是否创造新知识的核心争议。最后提出了包括持续强化学习、基于模型的RL等九大未来研究方向,