简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

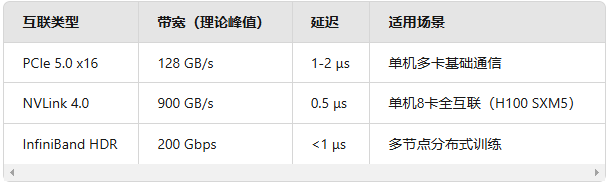

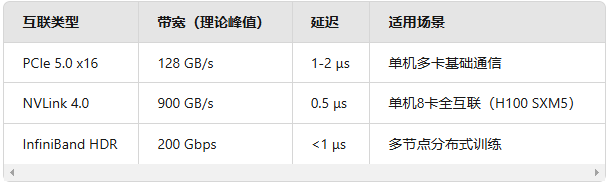

越来越多的企业想要私有部署DeepSeek,不同参数版本的模型,需要的硬件配置是不一样的,其中GPU型号对整体硬件成本影响很大。以下供大家参考。显卡:NVIDIA RTX 3060(12GB)或RTX 4060(8GB)内存:16GB DDR4存储:512GB SSD优化策略:FP16量化 + CPU/GPU混合推理单卡方案:约4,000-6,000元(消费级显卡)适用场景:个人开发者调试、轻量级

多模态大模型的应用场景有哪些?

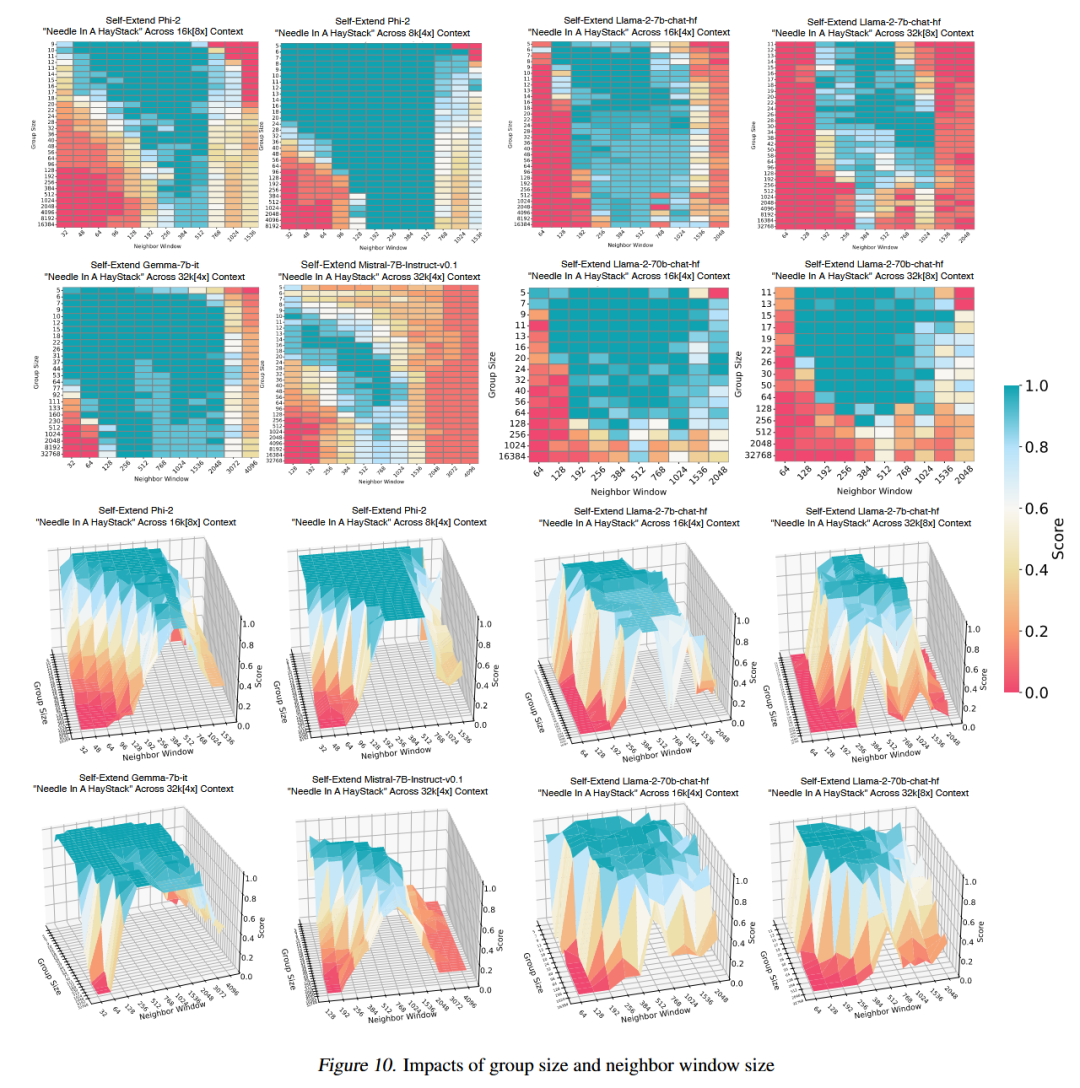

YaRN和SelfExtend分别在微调和推理阶段提供了有效的上下文窗口扩展方案,前者通过优化位置嵌入插值和动态缩放,后者通过双层注意力机制扩展了模型的上下文处理能力。两者在不同应用场景下都表现出色,为大语言模型的长文本处理提供了新的技术路径。

langchain从入门到精通(非常详细),零基础入门到精通,看这一篇就够了

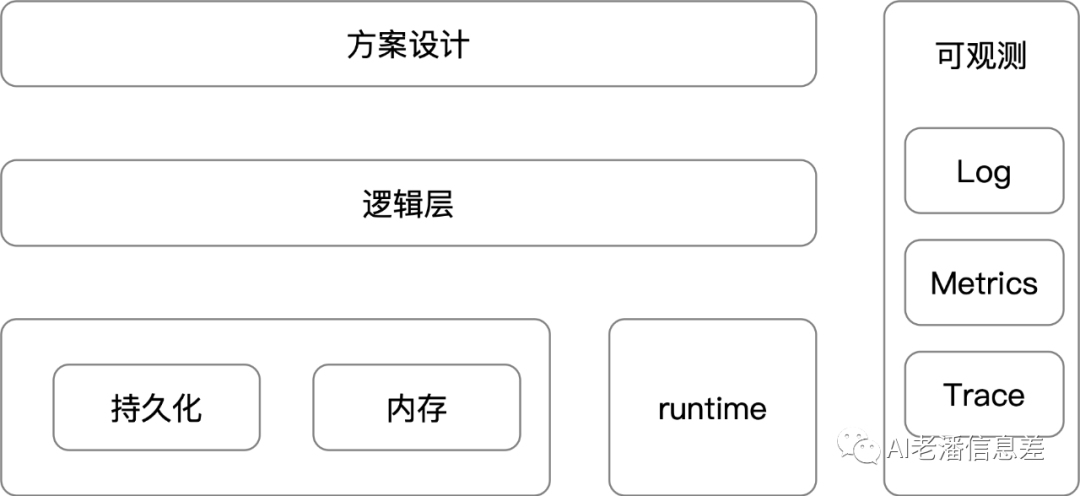

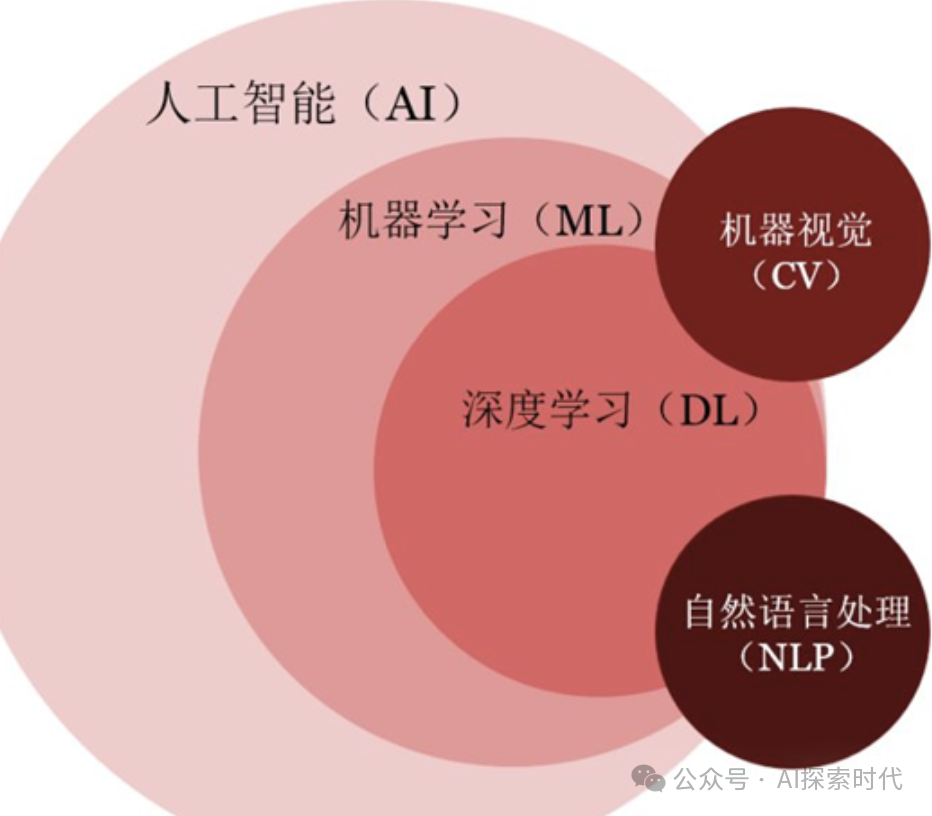

神经网络是神经网络,具体任务是具体任务,不能混为一谈学习了一段时间神经网络技术之后发现对很多东西理解还不够深刻,所以今天就来梳理一下神经网络的技术栈,深入了解一下不同的工具在神经网络中所处的位置,以及其扮演的角色。先说一句废话,神经网络仅仅只是神经网络,它不涉及具体的任务,只是一个神经网络模型;神经网络要解决实际问题就需要和不同的任务领域相结合。神经网络技术栈要了解或者说要学习

目前,春季招聘高峰已告一段落,记者走访发现,随着人工智能应用的爆发,生成式人工智能的招聘市场也十分火爆。在一家大型人工智能软件公司,团队负责人告诉记者,团队主要做基于大模型的办公协作类软件的开发,近期正在升级一款面向程序员的代码工具,产品已经在网页端取得不错的成绩,。**某人工智能软件公司办公协作产品负责人 贾安亚:**我们现在比较着急的是产品运营,还有测试和前端开发的岗位。因为本身整个大模型迭代

*大模型是指具有大规模参数和复杂计算结构的机器学习模型。**这些模型通常由。

AI大模型是指具有巨大参数量的深度学习模型,通常包含数十亿甚至数万亿个参数。这些模型可以通过学习大量的数据来提高预测能力,从而在自然语言处理、计算机视觉、自主驾驶等领域取得重要突破。AI大模型的定义具体可以根据参数规模来分类。根据OpenAI的分类方法,可以将AI模型分为以下几类:小型模型:≤ 1百万个参数中型模型:1百万 – 1亿个参数大型模型:1亿 – 10亿个参数极大型模型:≥ 10亿个参数

越来越多的企业想要私有部署DeepSeek,不同参数版本的模型,需要的硬件配置是不一样的,其中GPU型号对整体硬件成本影响很大。以下供大家参考。显卡:NVIDIA RTX 3060(12GB)或RTX 4060(8GB)内存:16GB DDR4存储:512GB SSD优化策略:FP16量化 + CPU/GPU混合推理单卡方案:约4,000-6,000元(消费级显卡)适用场景:个人开发者调试、轻量级

APP开发入门:了解主流的编程语言