简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

AIOps(Artificial Intelligence for IT Operations)即智能运维,是将人工智能技术应用于 IT 运维管理领域,以实现自动化、智能化的运维决策和管理。

GPU(Graphics Processing Unit,图形处理器)、NPU(Neural Processing Unit,神经网络处理器)和 TPU(Tensor Processing Unit,张量处理器)都是为了满足特定计算需求而设计的处理器。

通过以上步骤,即可在三台 GPU 服务器上实现 DeepSeek 的分布式部署,支持 7B/33B 模型的训练与推理,后续可根据需求调整节点数、GPU 数量及分布式策略(如增加节点扩展至更多 GPU)。分布式训练需主节点(Master)通过 SSH 无密码访问从节点(Worker),需配置三台服务器的 SSH 免密登录。避免多节点重复下载,建议在 Master 节点下载模型,通过 NFS 挂载或。

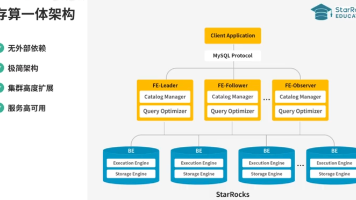

StarRocks 是一款,由字节跳动开源(2020 年开源,2023 年进入 Apache 孵化器),核心定位是 “实时数仓 + 湖仓一体”,专为 PB 级数据的快速查询、多维分析、实时报表等场景设计,广泛应用于互联网、金融、零售、政务等行业。

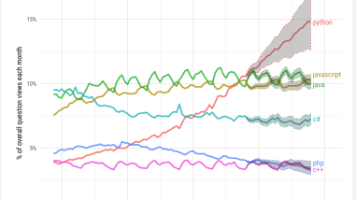

一、快速了解 Python 和 环境准备(一)Python 快速介绍Python 是一种 简洁、强大、易读 的编程语言,广泛应用于 Web 开发、数据分析、人工智能、自动化运维 等领域。它由 Guido van Rossum 在 1991 年设计,因其清晰的语法和强大的生态系统,迅速成为全球最受欢迎的编程语言之一。在 2017 年底,Stack Overflow 发布的数据显示,Python 已经

关于文件-块-DataNode关系的元数据保存到内存中HA(High Availablity)高可用,一主一从,从节点不断给主节点发送心跳信息,重试几次依然没有收到主节点返回的信息,就认为主节点死掉了,从节点变为主节点。两个主节点同时存在问题是脑裂,从节点发出请求强制关闭主节点。fsimageedits日志文件1、Map 阶段每个节点单独处理一个文件切片(缺省就是一块)处理后的结果文件先排序存储在

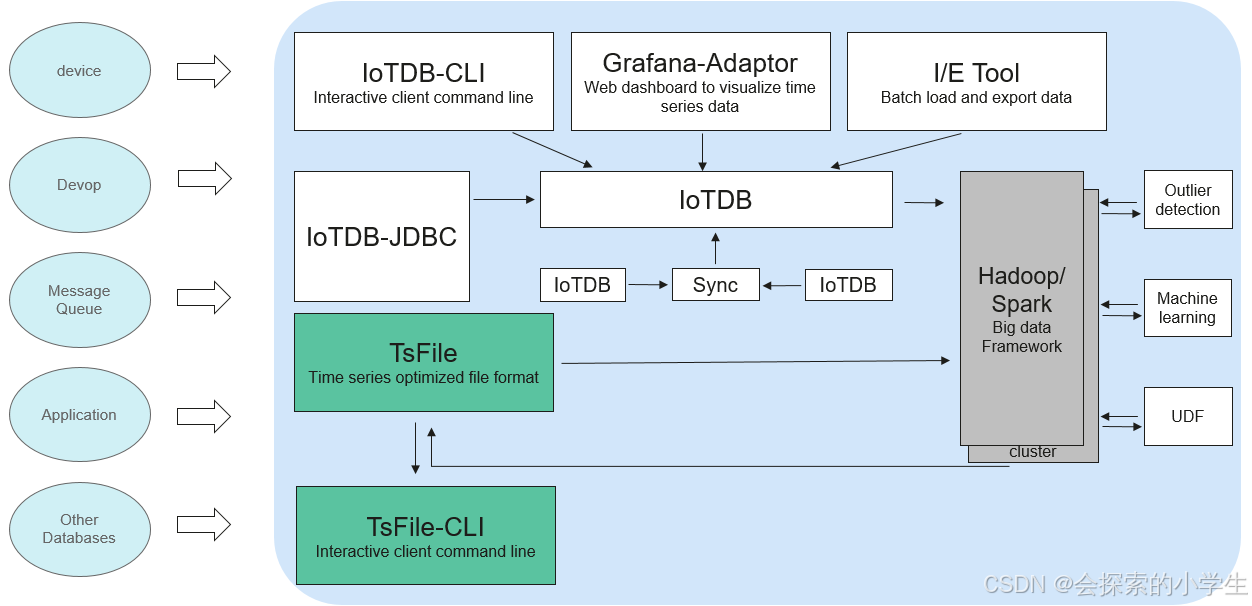

IoTDB(物联网数据库)是一体化收集、存储、管理与分析物联网时序数据的软件系统。Apache IoTDB采用轻量式架构,具有高性能和丰富的功能。IoTDB从存储上对时间序列进行排序,索引和chunk块存储,大大的提升时序数据的查询性能。通过Raft协议,来确保数据的一致性。针对时序场景,对存储数据进行预计算和存储,提升分析场景的性能。

DBService是一个高可用性的关系型数据库存储系统,适用于存储小量数据(10GB左右),比如:组件元数据。DBService仅提供给集群内部的组件使用,提供数据存储、查询、删除等功能。DBService是集群的基础组件,Hive、Hue、Oozie、Loader和Redis组件将元数据存储在DBService上,并由DBService提供这些元数据的备份与恢复功能。

在“Settings”页面中,找到“Your repositories”部分,点击“New repository”。在 GitHub 仓库页面,点击“Code”标签页下的“Clone or download”按钮,复制仓库地址。选择初始化仓库的 .gitignore 文件,这样可以忽略一些不需要提交到仓库的文件。在本地终端,使用 git clone [仓库地址] 将 GitHub 仓库克隆到本地。

在配置好这些基础组件后,GPU服务器就可以用来运行各种依赖GPU加速的任务了,包括但不限于深度学习模型的训练和推理、大规模数据处理、复杂的科学计算等。综上所述,虽然仅安装NVIDIA显卡和相关驱动可以让GPU服务器运行任务,但为了充分发挥其性能,还需要进行一系列的配置和安装工作,包括安装CUDA和cuDNN等工具集。,但为了充分发挥GPU的计算能力,还需要进行一系列的配置和安装工作。首先,确保服