简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

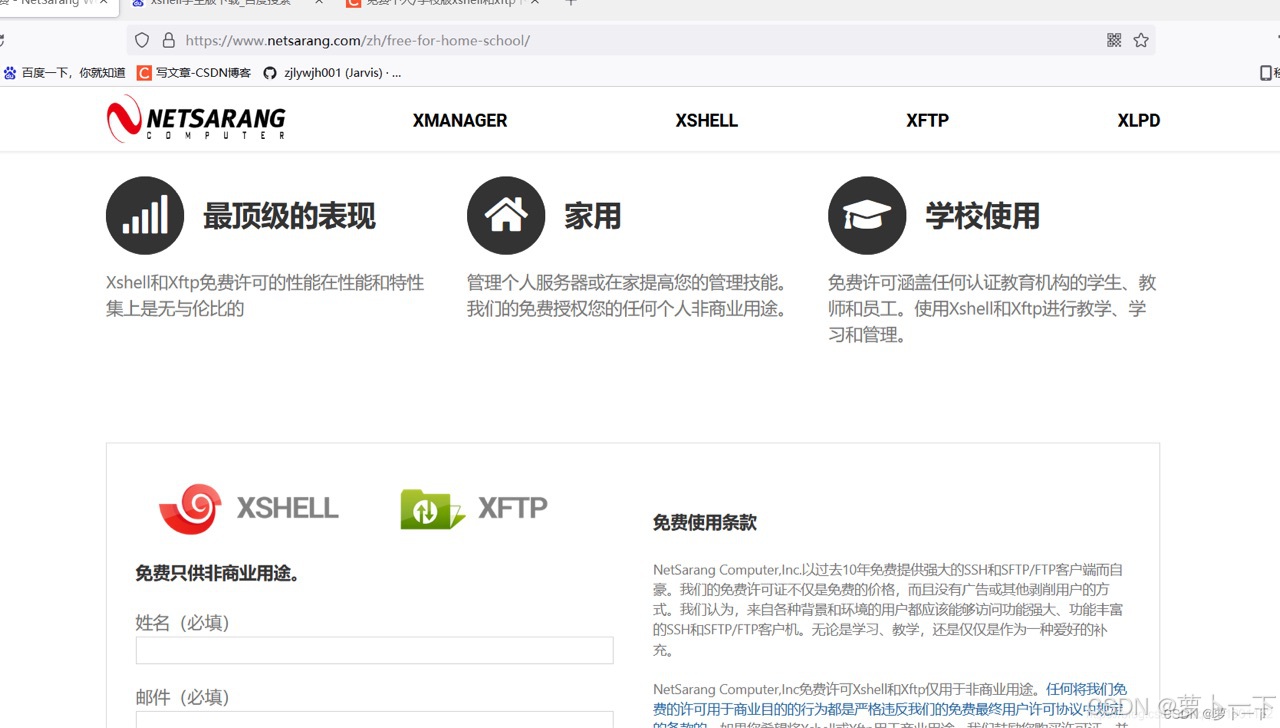

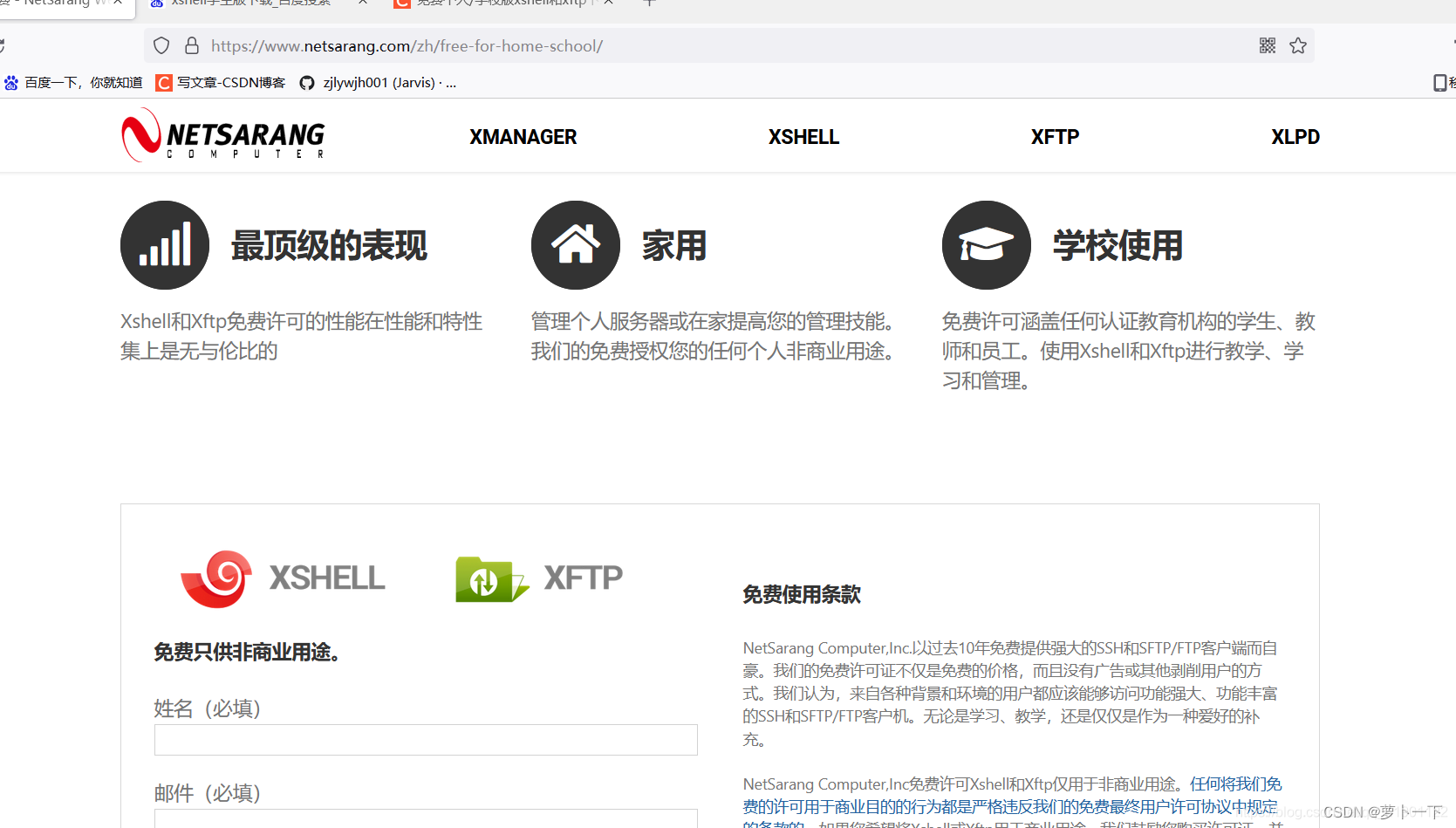

linux服务器配置深度学习环境,看这一篇就够了

linux深度学习环境配置

深度学习中超参数介绍,过拟合、欠拟合、梯度消失及梯度爆炸的理解

超参数的设置对训练的影响(1)学习率(learning rate)学习率(learning rate)是指在优化算法中更新网络权重的幅度大小。学习率可以是恒定的、逐渐降低的,基于动量的或者是自适应的,不同的优化算法决定不同的学习率。为了能够使得梯度下降法有较好的性能,我们需要把学习率的值设定在合适的范围内。学习率过小,会极大降低收敛速度,增加训练时间;学习率过大,可能导致参数在最优解两侧来回振荡,

在yolov5源码基础上修改,只识别一种类别

简单拓展yolov5

深度学习中超参数介绍,过拟合、欠拟合、梯度消失及梯度爆炸的理解

超参数的设置对训练的影响(1)学习率(learning rate)学习率(learning rate)是指在优化算法中更新网络权重的幅度大小。学习率可以是恒定的、逐渐降低的,基于动量的或者是自适应的,不同的优化算法决定不同的学习率。为了能够使得梯度下降法有较好的性能,我们需要把学习率的值设定在合适的范围内。学习率过小,会极大降低收敛速度,增加训练时间;学习率过大,可能导致参数在最优解两侧来回振荡,

c++调用pb文件并生成可执行文件exe

c++调用pb模型实现脱离环境直接进行预测猫狗

深度学习中超参数介绍,过拟合、欠拟合、梯度消失及梯度爆炸的理解

超参数的设置对训练的影响(1)学习率(learning rate)学习率(learning rate)是指在优化算法中更新网络权重的幅度大小。学习率可以是恒定的、逐渐降低的,基于动量的或者是自适应的,不同的优化算法决定不同的学习率。为了能够使得梯度下降法有较好的性能,我们需要把学习率的值设定在合适的范围内。学习率过小,会极大降低收敛速度,增加训练时间;学习率过大,可能导致参数在最优解两侧来回振荡,

linux服务器配置深度学习环境,看这一篇就够了

linux深度学习环境配置

到底了