简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

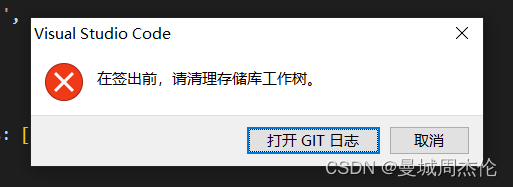

使用vscode 用git 拉取代码,提示:在签出前,请清理存储库工作树**git仓库上的代码和本地代码存在冲突了所以会报这个报错。

本次案例将使用深度学习技术来完成图像自然语言描述生成任务,输入一张图片,模型会给出关于图片内容的语言描述。本案例使用coco2014数据集[1],包含82,783张训练图片,40,504张验证图片,40,775张测试图片。案例使用Andrej Karpathy[2]提供的数据集划分方式和图片标注信息,案例已提供数据处理的脚本,只需下载数据集和划分方式即可…本次案例将使用深度学习技术来完成图像自然语

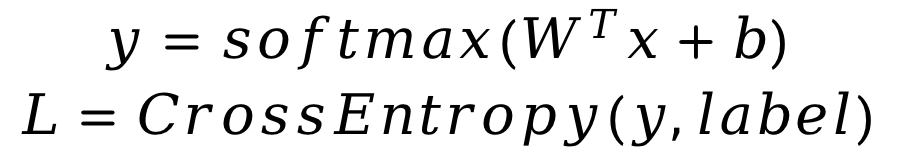

本次案例中,你需要用python实现Softmax回归方法,用于MNIST手写数字数据集分类任务。你需要完成前向计算loss和参数更新。你需要首先实现Softmax函数和交叉熵损失函数的计算。在更新参数的过程中,你需要实现参数梯度的计算,并按照随机梯度下降法来更新参数。

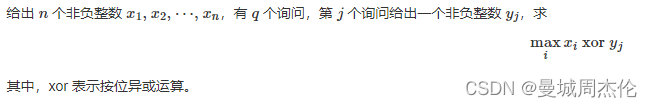

课程链接:驭风计划是由清华大学老师教授的,其分为四门课,包括: 机器学习(张敏教授) , 深度学习(胡晓林教授), 计算机语言(刘知远教授) 以及数据结构与算法(邓俊辉教授)。本人是综合成绩第一名,除了数据结构与算法其他单科均为第一名。代码和报告均为本人自己实现,由于篇幅限制,只展示任务布置以及关键代码,如果需要报告或者代码可以私聊博主部分授课老师为邓俊辉教授,主要通过从贪心,分治,图搜索,动态规

课程链接:驭风计划是由清华大学老师教授的,其分为四门课,包括: 机器学习(张敏教授) , 深度学习(胡晓林教授), 计算机语言(刘知远教授) 以及数据结构与算法(邓俊辉教授)。本人是综合成绩第一名,除了数据结构与算法其他单科均为第一名。代码和报告均为本人自己实现,由于篇幅限制,只展示任务布置以及关键代码,如果需要报告或者代码可以私聊博主部分授课老师为邓俊辉教授,主要通过从贪心,分治,图搜索,动态规

课程链接:驭风计划是由清华大学老师教授的,其分为四门课,包括: 机器学习(张敏教授) , 深度学习(胡晓林教授), 计算机语言(刘知远教授) 以及数据结构与算法(邓俊辉教授)。本人是综合成绩第一名,除了数据结构与算法其他单科均为第一名。代码和报告均为本人自己实现,由于篇幅限制,只展示任务布置以及关键代码,如果需要报告或者代码可以私聊博主部分授课老师为邓俊辉教授,主要通过从贪心,分治,图搜索,动态规

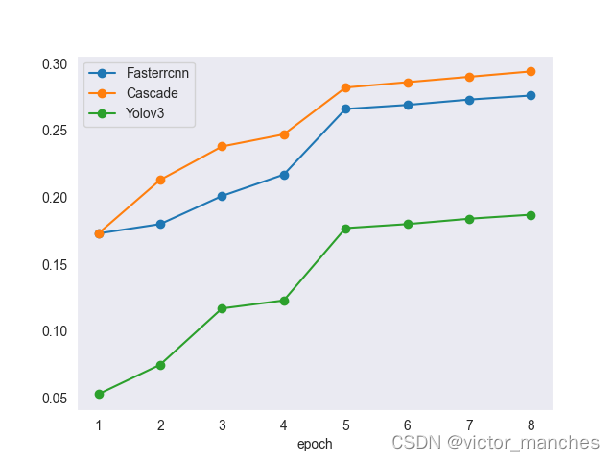

本次案例将使用深度学习技术来完成城市交通场景下的目标检测任务,案例所使用的数据集由滴滴出行提供,基于D2-City大规模行车记录视频数据集[1],经过视频抽帧等预处理步骤得到。数据集共包含12,000张图像,每张图像的大小为1080×1920或720×1280,已划分为训练集(10,000张)、验证集(1,000张)、测试集(1,000张),其中训练集和验证集提供了检测标签,测试集仅提供图像,用于

每年国际上召开的大大小小学术会议不计其数,发表了非常多的论文。在计算机领域的一些大型学术会议上,一次就可以发表涉及各个方向的几百篇论文。按论文的主题、内容进行聚类,有助于人们高效地查找和获得所需要的论文。本案例数据来源于AAAI 2014上发表的约400篇文章,由UCI公开提供,提供包括标题、作者、关键词、摘要在内的信息,希望大家能根据这些信息,合理地构造特征向量来表示这些论文,并设计实现或调用聚

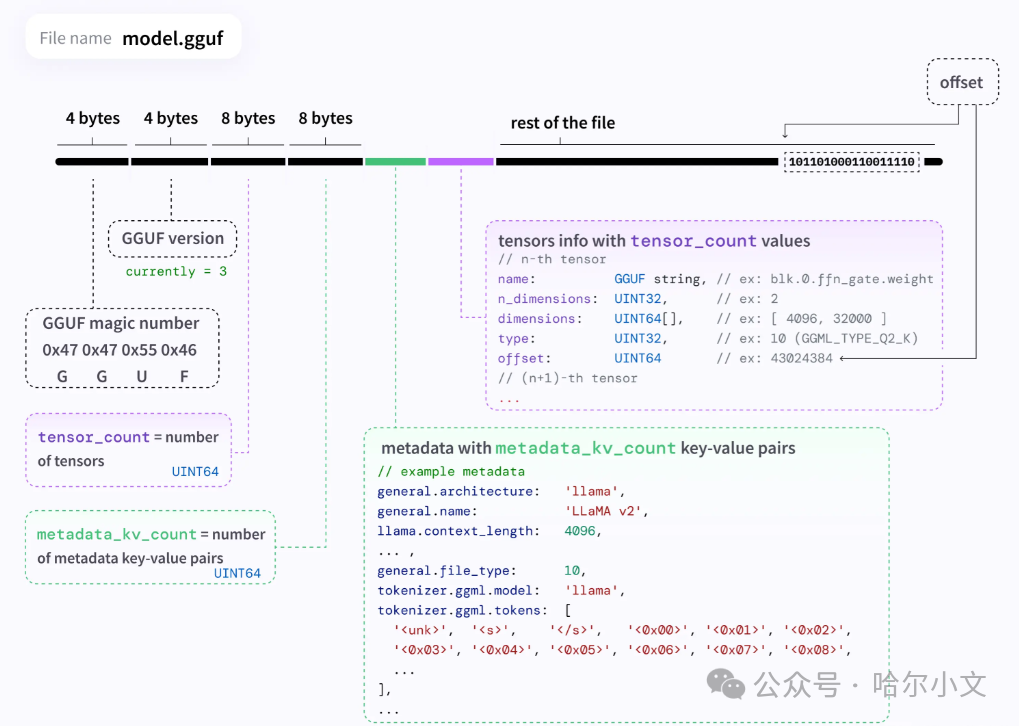

GGUF(GPTQ for GPUs Unified Format)是一种针对大语言模型(LLM)权重文件的统一格式,旨在简化和标准化不同模型格式之间的转换和加载。随着大语言模型的快速发展,不同的框架(如Hugging Face Transformers、TensorFlow、PyTorch等)和优化工具(如GPTQ、LoRA、INT8/INT4量化)可能生成不同格式的模型文件。GGUF格式的引入

这里主要阐述的是Lora与LLM合并后,可以直接由Transformer的AutoModel去加载与推理。这里就不再赘述了,大概原理就是。