简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1、引领未来的技术革新——人工智能大语言模型技术发展研究在当前科技革命的浪潮中,人工智能(AI)不仅仅是推动科技产业革命的强大引擎,更是新质生产力的核心驱动力。AI正以无法抗拒的力量深刻塑造全球经济、社会及文化景观。自2023年起,大模型技术崛起为AI发展的新标杆,引发了一场深远的技术变革。这些技术产品的快速迭代和升级,已经成为全球科技竞争的关键因素和战略博弈的核心。在这种快速变化的背景下,及时地

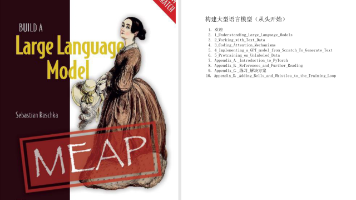

想要掌握大语言模型的构建吗?从零开始,这本书是你的理想选择!使用PyTorch框架,无需依赖其他库,你就能逐步掌握LLM的理论知识和实践技能。书中详细介绍了如何处理文本数据,包括文本预处理、分词、字节对编码、滑动窗口采样以及向量转换等关键步骤。通过这些步骤,你能为你的LLM提供高质量的训练数据。在构建LLM的过程中,我们首先需要准备训练数据集。这一章将详细讲解如何进行数据准备和采样,为你的LLM提

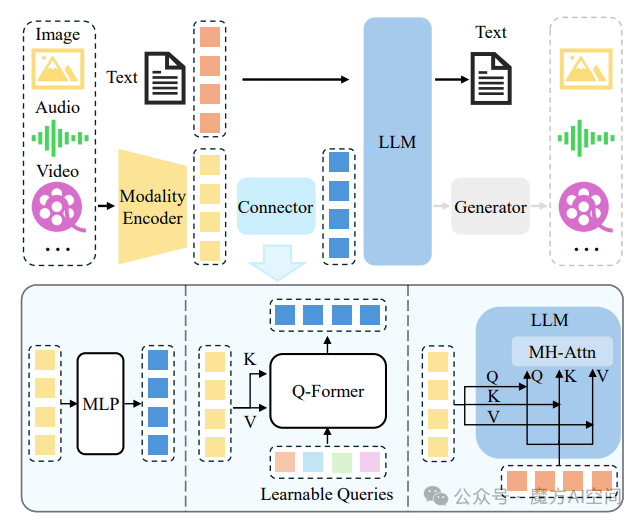

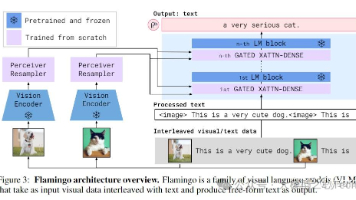

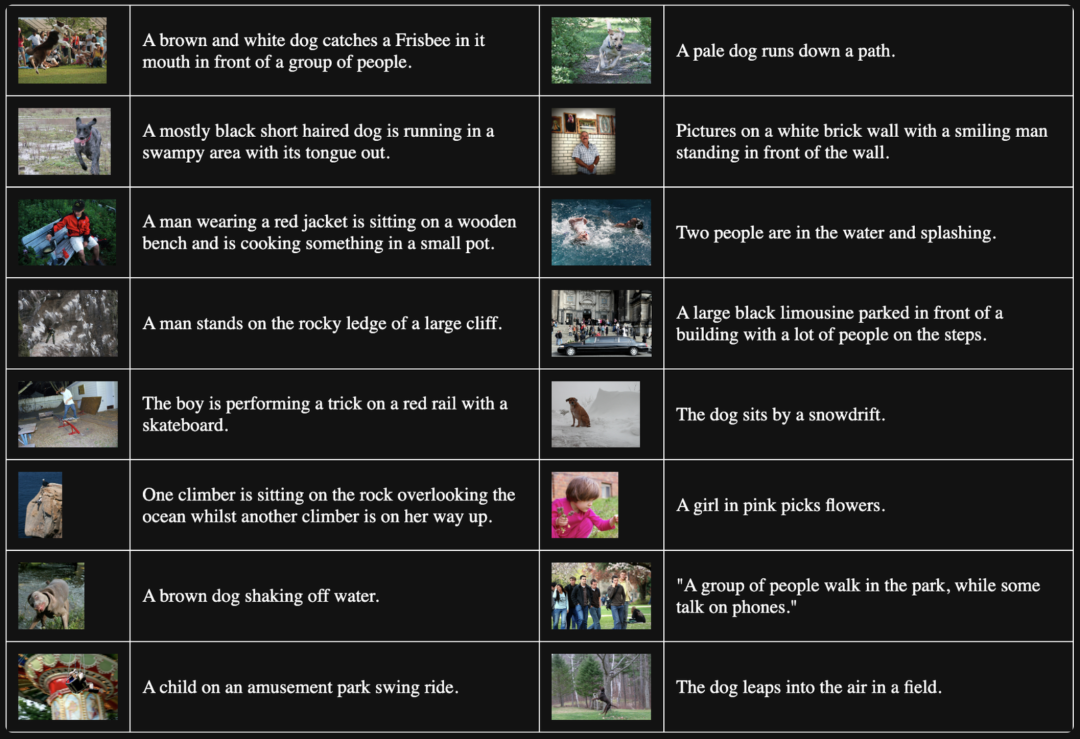

本文全面综述了多模态大型语言模型(MLLM)的发展历程与架构设计,分析了Flamingo、BLIP-2、LLaVA等主流模型的技术特点,探讨了视觉编码器、特征重采样器和多模态对齐等关键技术,并指出数据效率、幻觉问题和高分辨率处理等当前挑战,为AI开发者提供全面的技术参考和实践指导。

多模态大模型最新进展!把最核心的思路和代码都给你扒出来了!

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频,免费分享!

内容概述:引入多模态大模型的概念,探讨其技术挑战与解决方案。关键要点:多模态数据的表示、融合与对齐技术。内容概述:总结全书内容,提出对未来研究的建议与展望。有需要这本《多模态大模型:技术原理与实战》书籍PDF文档,可以微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】

本教程详细介绍如何使用n8n和飞书两个免费工具,零代码搭建专属智能客服系统。文章从准备工作开始,逐步指导读者创建飞书数字员工,配置n8n智能大脑,包括消息接收、智能处理和回复功能的全流程,最后进行上线测试。适合创业老板、运营小白和想学习AI客服搭建的程序员,无需编程基础即可实现基础智能客服功能。还在为重复回答客户问题而头疼?想要一个不知疲倦的数字员工?今天教你用两个免费工具——n8n和飞书,零代码