简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要: Model Context Protocol (MCP) 是连接AI与本地数据及第三方软件的标准化接口,通过赋予AI实时操作能力(如代码管理、数据库查询、浏览器自动化等)重塑工作流。文章盘点2025年热门MCP工具,涵盖开发者生产力(GitHub、PostgreSQL)、实时搜索(Brave)、企业协作(Notion、Slack)和逻辑增强(Sequential Thinking)四大类,

云计算已成为全球数字经济的核心基础设施,其技术本质是资源抽象与池化的分布式系统工程。虚拟化技术通过Hypervisor实现单机多租户,大幅提升资源利用率;资源池化则带来显著的规模经济效应。云计算架构持续演进:从虚拟机到容器(依赖Namespace和Cgroups技术),再到Kubernetes容器编排和Serverless极致抽象。云存储系统通过数据分片、复制和纠删码技术,在可用性、一致性与性能间

摘要:SE-Block是一种创新的通道注意力机制,通过Squeeze-Excitation操作自动学习特征通道的重要性权重。其核心包括全局平均池化获取通道信息、全连接层学习通道间关系,最后对特征通道进行加权。该方法以极小的计算开销(仅增加0.26%参数量)显著提升模型性能,如SE-ResNet50在ImageNet上的Top-1错误率降低1.5%。SE-Block证明了注意力机制在特征筛选中的有效

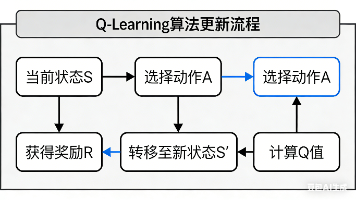

摘要:本文深入解析强化学习中SARSA和Q-learning这对"双胞胎"算法的核心区别。SARSA采用on-policy策略,基于实际执行动作更新Q值,学习风格保守安全;Q-learning采用off-policy策略,基于最优动作更新Q值,追求理论最优解。通过悬崖行走实验对比发现:SARSA学会安全绕远路(平均奖励-20),Q-learning选择冒险捷径(平均奖励-15但

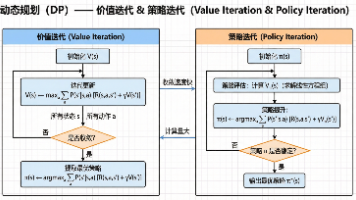

本文系统介绍了动态规划(DP)在强化学习中的应用。主要内容包括:1. DP基本原理:通过分解子问题求解最优策略,需满足最优子结构和重叠子问题条件;2. 核心算法:策略评估(计算给定策略的价值函数)、策略改进(基于价值函数优化策略)、策略迭代(交替评估和改进)和价值迭代(直接优化价值函数);3. 实现对比:策略迭代适合小规模问题,价值迭代效率更高;4. 代码示例:以网格世界为例展示了两种算法的Pyt

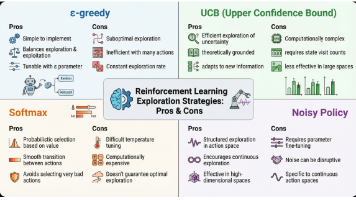

在强化学习的世界里,存在一个永恒的两难困境——探索(Exploration)还是利用(Exploitation)?是安于现状享受已知的美好,还是勇闯未知寻找更大的宝藏?今天,让我们深入研究四种经典的探索策略,看看它们如何在这场博弈中各显神通!

深度Q网络(DQN)是DeepMind团队提出的里程碑式算法,首次实现从高维感知输入直接学习控制策略。相比传统Q-Learning,DQN通过神经网络逼近Q函数,解决了状态空间过大和泛化问题。其核心技术包括经验回放(打破数据相关性)和目标网络(稳定训练)。改进版本如DoubleDQN和DuelingDQN进一步提升了性能。DQN适用于高维状态空间和离散动作环境,但仍存在样本效率低、超参数敏感等局限

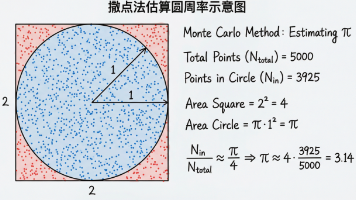

蒙特卡洛方法是一种利用随机试验解决复杂问题的数学方法。通过大量随机采样估算结果,适用于难以用传统方法求解的问题。文章通过不规则池塘面积估算和圆周率计算等生动例子,解释了该方法的核心思想:用随机试验的成功比例推算答案。蒙特卡洛方法在天气预报、金融投资等领域有广泛应用,虽结果不够精确但简单通用。文章还提供了Python代码示例,帮助读者理解实现过程。这种方法证明,有时"随机尝试"反

本文用通俗语言解析强化学习的四大数学基础:1. MDP(马尔可夫决策过程)是描述强化学习问题的框架,包含状态、动作、转移概率和奖励;2. 奖励函数是智能体的评分系统,即时奖励和考虑未来折扣的累积奖励;3. 策略是智能体的行动指南,分为确定性策略和随机策略;4. 价值函数评估状态或动作的长期价值,包括状态价值函数V(s)和动作价值函数Q(s,a)。文章还解释了核心的贝尔曼方程,并提供了公式速查表和常

Kurator:多云K8s集群管理的开源解决方案 Kurator是一个开源的分布式云原生管理平台,旨在解决企业多云Kubernetes集群管理中的痛点。它整合了Karmada、Istio、KubeEdge等优秀开源项目,提供了统一的管理层,简化了多云环境下的集群管理。 核心功能包括: Fleet抽象:可将多个集群组成舰队统一管理 跨集群应用分发:支持差异化配置部署 统一监控:集成Prometheu