简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

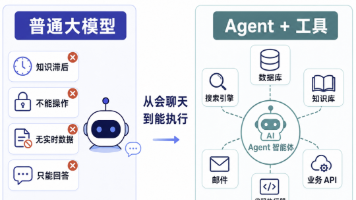

2026年AI Agent(智能体)成为企业核心应用工具,不再局限于展示性能,而是深入财务、客服、法务等业务系统。文章指出三大趋势:巨头推出企业级Agent搭建平台降低门槛,垂直领域标准化任务开始被Agent替代,AI准确率提升解决“幻觉”问题。企业需从重复性、规则明确的任务入手,利用Agent降低成本、提升效率,把握技术变革窗口期。2026年的第一季度刚刚过去,很多企业的IT部门甚至还没来得及复

低门槛入门:不用死磕底层算法,先掌握大模型使用与工程化能力优先级:落地能力>理论知识,商业化>Demo学历友好:大专 / 本科均可,以项目与技术实力为核心评判标准。

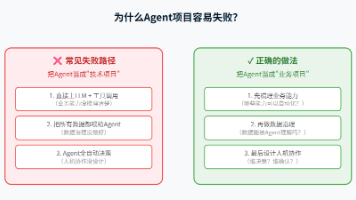

AI Agent的成功,不取决于LLM有多强大,而取决于你的业务梳理、数据治理、人机协作有多清晰。换句话说,Agent项目就是一次数字化转型的浓缩版。从业务视角,开启你的Agent之旅。

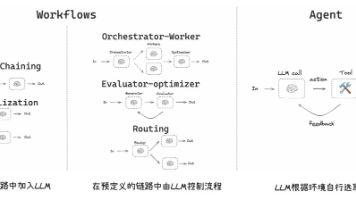

简介:AutoGPT是第一个爆火的自主AI Agent框架,提供一系列工具让用户构建和使用自治代理。其功能涵盖代理创建模块“Forge”、性能评测基准agbenchmark、排行榜以及易用的UI和CLI接口。主要特点:AutoGPT支持“思考-行动-反馈-学习”的循环,让代理不断生成子任务并执行。并且拥有丰富的插件和工具接口,允许代理访问浏览器、文件系统、API等资源,从而完成复杂的链式任务。

Function Calling 其实是工具调用的工程实现方式,开发者先把外部能力封装成函数,通过函数名、函数描述和参数 Schema 注册给模型。用户发起任务后,大模型判断是否需要调用函数。如果需要,它会生成结构化的函数调用请求,包括函数名和 JSON 参数。应用程序拿到这个请求后,负责真正执行函数,比如查数据库、调接口或检索知识库,执行结果再返回给大模型,大模型基于工具结果生成最终回答。"de

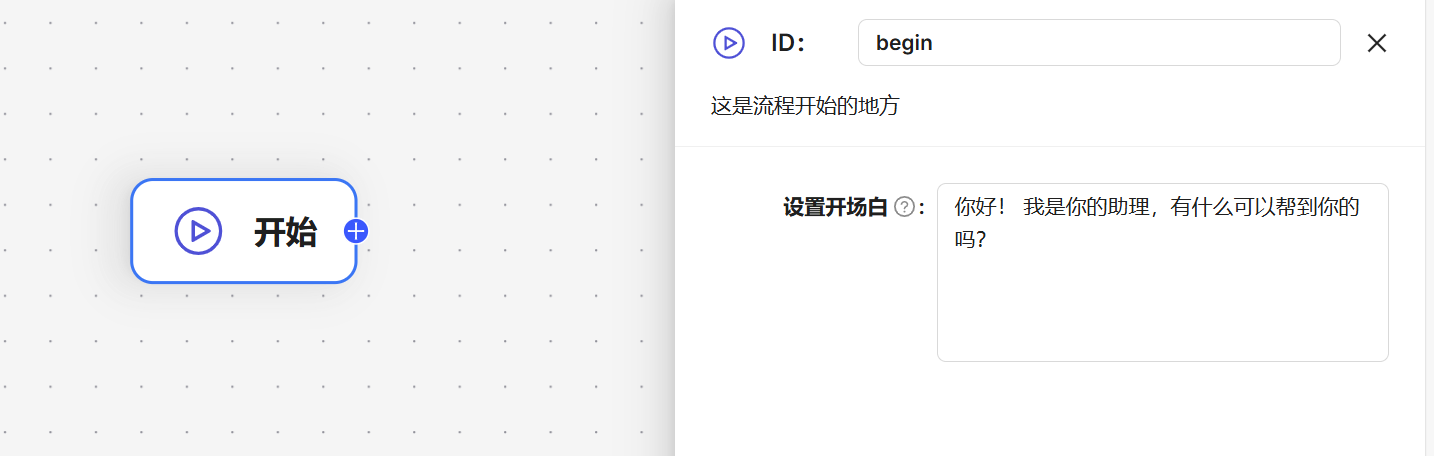

智能客服的应用场景非常广泛,如商品咨询,售后问答,配件更换,转人工客服等场景,今天将给大家介绍如何使用 RAGFlow 的来搭建一个商品智能客服,实现能够针对上述四种场景给出不同的解决方案。是一款基于深度文档理解构建的开源 RAG(Retrieval-Augmented Generation)引擎。RAGFlow 可以为不同规模的企业及个人提供一套精简的 RAG 工作流程,结合大语言模型(LLM)

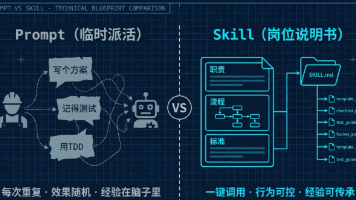

Skill 不神奇,就是一个文件夹里放了几个 markdown 文件。但"岗位说明书"也不神奇——就是一页规则。但正是因为有这一页规则,一个新人第一天上岗就能按正确的流程产出合格的结果。

回望过去十年,程序员行业经历了从“HTML+CSS就能就业”到“全栈开发成为标配”的迭代;而2026年,AI工程化的崛起,正在开启行业的全新阶段——纯开发降温不是寒冬,而是行业淘汰“低价值劳动者”、筛选“高价值创造者”的过程。50%的薪资溢价,从来不是“天上掉下来的馅饼”,而是给那些主动拥抱变化、主动升级能力的程序员的奖励。2026年,“会写代码”是基础,“会用AI落地代码”才是核心竞争力;纯开发

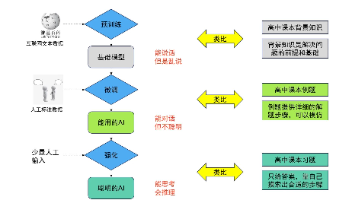

广义上的大模型优化还包括完整训练一个大模型,相信搞一个行业大模型出来是诸多老板梦寐以求的事情,虽然在战略上是势在必行,但从策略上还是建议先从提示词工程—>微调开始,毕竟只要涉及大模型训练,真的太太烧钱了,没有足够的钱和高质量的行业数据,建议慎重考虑。RAG做的好不好也是如此,核心就看能不能将内容检索的又快又准。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实

本文将详细梳理从零开始训练大语言模型的全过程,包括预训练阶段、指令微调、奖励模型和强化学习的实现方式。