简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

一、离散型概率分布 1. 伯努利分布(Bernoulli Distribution) 定义:单次二分类试验(成功/失败)的概率分布。概率质量函数(PMF):参数: p:事件成功的概率(0≤p≤1)。 例子: 抛一枚硬币,正面朝上(X=1)的概率为 p。点击率预测中用户是否点击广告(二分类)。 应用场景: 逻辑回归:输出伯努利分布

云原生是用云的方式去设计、开发和运行应用——把应用拆成小块、装进轻量的容器,用自动化工具(像 Kubernetes)管理,让它能随需弹性伸缩、快速迭代、出问题能自愈并且好观测。

测试对比# 输出: x=0.5: ReLU=0.50, GELU=0.34, Mish=0.41激活函数的演变史反应了深度学习对非线性认知的深化。

1.1 核心思想。

结构特性:卷积层提取空间特征,池化层增强鲁棒性数学本质:局部连接 + 权值共享工程价值:计算机视觉任务的基础架构%20bn%29%20x。

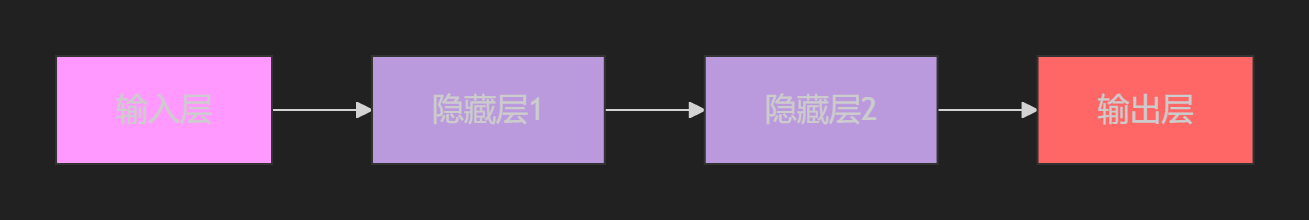

,输出层根据任务选择(如分类用Softmax)。Transformer中的。前馈神经网络(MLP)由。在残差块中,MLP用于。组成,每层全连接。

当英伟达在2018年发布Tesla V100时,深度学习界迎来了一场寂静的革命:混合精度训练技术(FP16)。这项技术如同打开了一道魔法门,让原本需要数周的训练任务在几天内完成,将GPU利用率推向前所未有的高度。

低比特量化(Low-Bit Quantization)是深度学习领域一场静默的效率革命,它将神经网络的"计算语言"从高精度的浮点数(如FP32)精简为高效的整数(如INT8/INT4)。这个过程如同将一部厚重的百科全书压缩成随身携带的摘要手册——保留核心知识,剔除冗余信息,实现更快的访问速度和更低的携带成本。

多阶段混合调度器return 0.1AlphaGo训练方案阶段1:前20轮 LR=0.1(快速探索)阶段2:20-60轮 LR=0.05(策略优化)阶段3:60+轮 LR指数衰减(精细调优)训练效率提升37%

——从边缘部署到多模态融合的范式革命。