简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

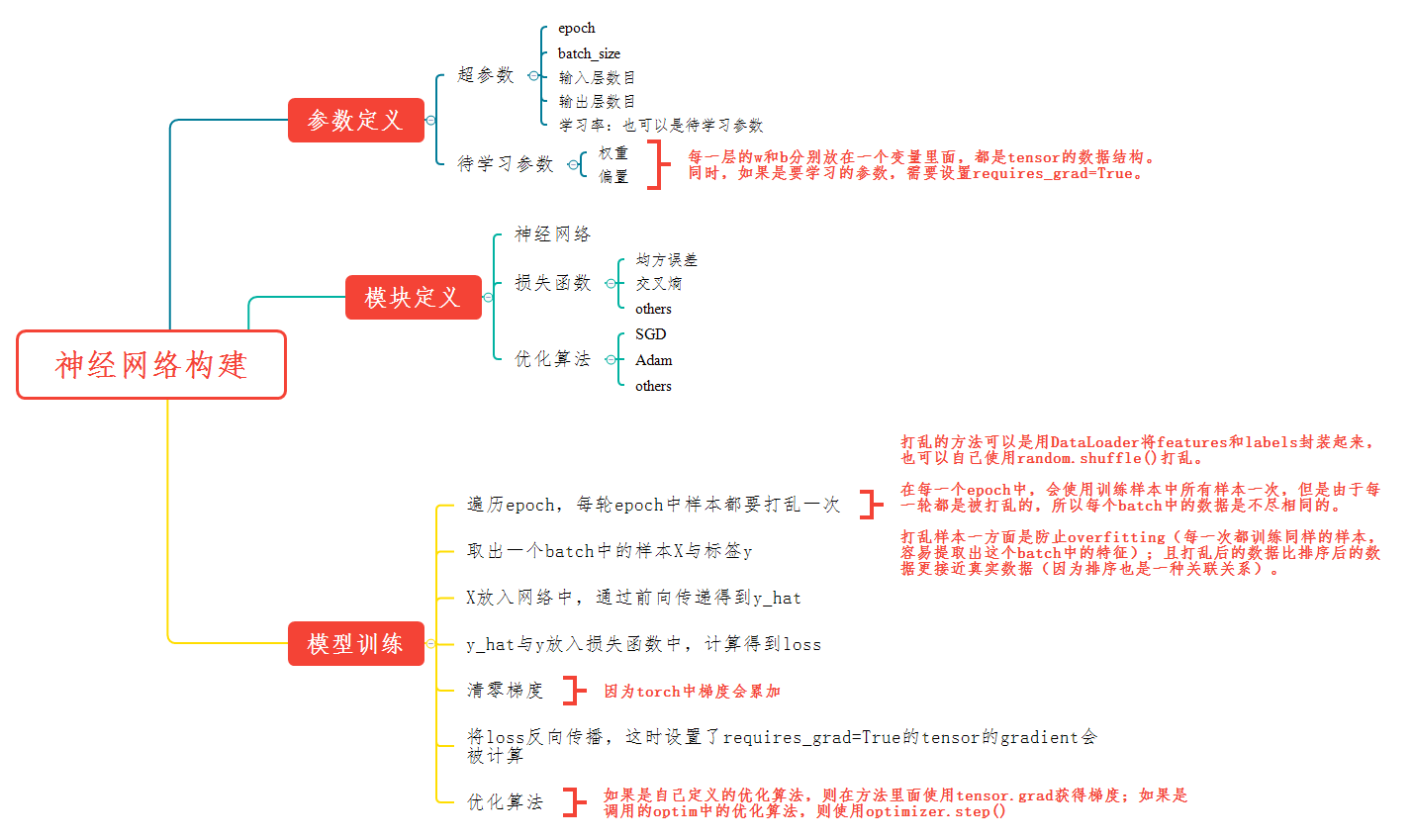

本文参考的是《动手学深度学习》(PyTorch版),链接在下面。由于照着网站上的代码敲一遍自己印象也不是很深刻,所以我整理了该书本中的内容,整理了自己的思路梳理了一遍。希望该文章能够对初学者的你来说有所帮助。同时由于我也是第一次用torch写代码,可能会有许多疏漏,如果有错误,希望各位能够指正。目录0 代码目的1 数据集创建2 神经网络搭建流程3 从0搭建一个线性回归神经网络3.1 参数定义3.2

作为一个第一次了解神经网络的学生来说,这一块基本上就是搬运的网上各个资源的内容,如果后续在使用和学习的过程中有了新的理解和感悟再来做更深入的补充。这一块由于才开始接触理论,就还没有运用代码实现出来,后续撸了代码出来后再补上。最后日常吹3B1B,3B1B永远滴神!目录神经网络简单介绍神经元与激活函数参考神经网络简单介绍由于我的规划是先看神经网络(包括概念与梯度下降),再看word2vec、RNN、L

本文从0实现了用torch做基于RNN的情感分析。代码已上传到Github,链接为:https://github.com/Balding-Lee/torch-sentiment-analysis-based-on-RNN。但是效果并不是特别好,有可能是数据问题,也有可能是代码问题。如果是代码问题,欢迎指教。目录1 任务描述2 数据处理2.1 词语数目确定2.2 未知词词向量给定2.3 词嵌入3 模

本文以我自己的实验数据来作为样例说明何为macro F1与micro F1目录1 前置知识2 macro-F1与micro-F12.1 使用场景2.2 计算方法3 总结4 参考1 前置知识关于F1 score的内容如果还不清楚的朋友,可以参考我的上一篇博客:《机器学习学习笔记(1)——错误率、精度、准确率、召回率、F1度量》这里就只简单的提一下核心的混淆矩阵与公式:F1 score的公式:F1=2

结合上上两篇文章的叙述,这一篇文章主要讲解梯度的公式的推导,笔记来自于3B1B的视频,链接会放在最后。同样的,这一篇文章依旧没有代码。上篇文章中稍稍写漏了点东西,就是说在梯度下降过程中,步长是与该点的斜率有关,如果无关的话,那么如果步长太大,是不是就从坑中心滚过去了呀?比如这样:下面开始正文。每层只有一个神经元根据上篇文章的内容,梯度会有正有负,代表的意思就是这个点该如何移动。而每一项的相对大小告

PageRank(Page et al., 1998)最开始做出来并非是用于情感分析的,只不过我最近看到一个无监督的情感分析算法名叫PolarityRank(Cruz et al. 2011),这是基于PageRank的思想做的,所以在动手做PolarityRank之前先把PageRank给制作了。本文不会过多的提起算法原理之类的内容,毕竟基本是搬运的其他大佬的文章,我会把参考链接放在文章中,本文

在本书中这一篇章就写的略显单薄,不过作者也说明了,本书是NLP入门实践书籍,句法分析又属于NLP中较为高阶的问题,所以并没有深入讲解,我学习本书也是入门NLP,学习完本书后会学习《统计自然语言处理》。由于本章实战内容很少,而且也没有特别晦涩的代码,所以在本文中更多的是讲解windows配置等问题。目录一、JDK安装与配置二、PCFG文件下载三、代码四、总结五、参考一、JDK安装与配置因为stanf

本文展示的是使用 Pytorch 构建一个 BERT 来实现情感分析。本文的架构是第一章详细介绍 BERT,其中包括 Self-attention,Transformer 的 Encoder,BERT 的输入与输出,以及 BERT 的预训练和微调方式;第二章是核心代码部分。

本文展示的是使用 Pytorch 构建一个 BiLSTM 来实现情感分析。本文的架构是第一章详细介绍 BiLSTM,第二章粗略介绍 BiLSTM(就是说如果你想快速上手可以跳过第一章),第三章是核心代码部分。

感觉之前RNN的代码写的太丑陋了,所以该文章主要参考了Dive-into-DL-PyTorch和中文文本分类 pytorch实现的代码。目录1 项目框架2 预处理2.1 将所有词映射为词向量2.2 将句子中的词语映射为id3 CNN模型4 参考1 项目框架整个项目的框架抽象来看是如下的:简而言之就是输入的是整一句话,宽度为词向量维度(这里是300维),高度为句子最大长度。经过嵌入层嵌入后,通过卷积