简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

人工智能作为21世纪最具革命性的技术之一,正在深刻改变着人类社会。本文回顾AI发展历程,分析当前技术现状,展望未来发展趋势。

人工智能作为21世纪最具革命性的技术之一,正在深刻改变着人类社会。本文回顾AI发展历程,分析当前技术现状,展望未来发展趋势。

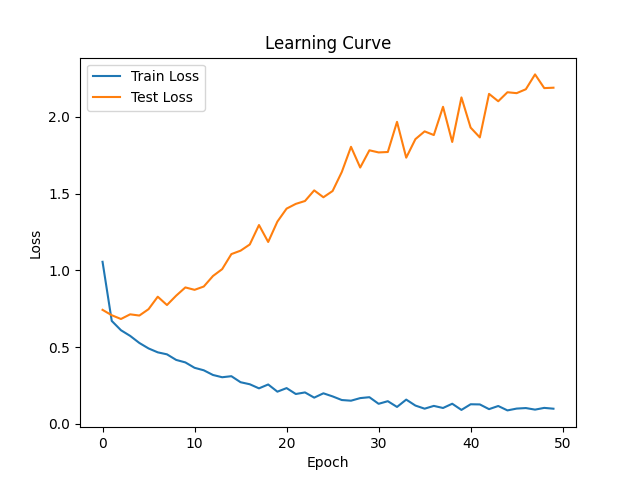

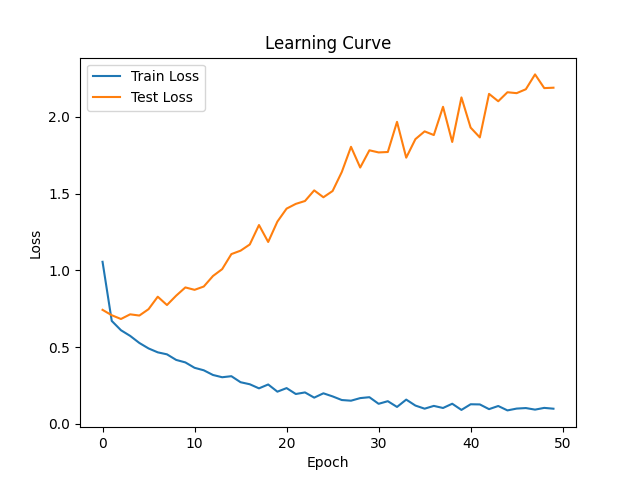

本研究通过对比多层感知机(MLP)在猫狗图像识别和手写数字识别任务上的表现,深入探讨了模型结构对机器学习模型性能的影响。实验发现,尽管猫狗数据集的数据量较大,理论上有利于模型训练,但MLP在这一任务上的表现并不理想,特别是在特征数量远多于手写数字数据集的情况下。此外,实验还观察到模型在训练集上的损失持续下降,而在测试集上的损失却上升,表明存在明显的过拟合现象。这些发现强调了模型结构在决定机器学习模

本文介绍了多个免费和付费的GPU算力平台,旨在帮助深度学习爱好者和研究者选择合适的资源进行模型训练和数据分析。文中详细比较了Google Colab、Kaggle Kernels、阿里云天池实验室、百度AI Studio等平台的优缺点,包括是否需要翻墙、显卡性能、稳定性和免费额度。

本文介绍了多个免费和付费的GPU算力平台,旨在帮助深度学习爱好者和研究者选择合适的资源进行模型训练和数据分析。文中详细比较了Google Colab、Kaggle Kernels、阿里云天池实验室、百度AI Studio等平台的优缺点,包括是否需要翻墙、显卡性能、稳定性和免费额度。

现在,每个人都能迅速从零基础开始,训练出一个强大的大型语言模型。本文已经汇总了可以免费获取的高端GPU算力资源,让AI训练之旅更加顺畅。

本研究通过对比多层感知机(MLP)在猫狗图像识别和手写数字识别任务上的表现,深入探讨了模型结构对机器学习模型性能的影响。实验发现,尽管猫狗数据集的数据量较大,理论上有利于模型训练,但MLP在这一任务上的表现并不理想,特别是在特征数量远多于手写数字数据集的情况下。此外,实验还观察到模型在训练集上的损失持续下降,而在测试集上的损失却上升,表明存在明显的过拟合现象。这些发现强调了模型结构在决定机器学习模

ollama工具的出现让大语言模型的部署变得格外的轻松,但是在windows系统部署之后发现无法使用GPU进行加速,通过多方面查找资料发现可以在docker中使用命令启用GPU加速。另外通过Docker也可以快速部署open webui,于是本文基于docker实现ollama模型的部署,以及webui部署。最终部署成功后可以实现公网访问本地大语言模型功能。

本文介绍了多个免费和付费的GPU算力平台,旨在帮助深度学习爱好者和研究者选择合适的资源进行模型训练和数据分析。文中详细比较了Google Colab、Kaggle Kernels、阿里云天池实验室、百度AI Studio等平台的优缺点,包括是否需要翻墙、显卡性能、稳定性和免费额度。

在学习机器学习之前,如果能先了解下机器学习都能做什么,大概的体系结构是什么,也许学起来会事半功倍。