简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

循环神经网络全景介绍,从RNN到LSTM再到GRU,全面介绍循环神经网络全貌。

蓦然回首,发现写了很多联邦学习方面的文章,但是没有写一篇联邦学习方面的介绍性的综述,所以写了这篇文章,从整体介绍下联邦学习的背景、联邦学习的简介、隐私保护技术与营销应用场景。▌联邦学习背景数据是AI的石油,加速了AI的高速发展,但是同时多维度高质量的数据是制约其进一步发展的瓶颈。由于用户隐私、商业机密、法律法规监管等原因,造成大量信息孤岛,导致各个组织与机构无法将原始数据整合在一起,进而联合训练训

文章目录一 什么是图神经网络1 神经网络的兴盛2 数据的异构性二 图神经网络1 图2 图神经网络综述2.1 图存储2.2 图嵌入2.3 图神经网络模型三 图卷积神经网络GCN参考文章一 什么是图神经网络我是蓝色1 神经网络的兴盛[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-yEi1eJgt-1642334328286)(/Users/dubaokun/Desktop

文章目录一 背景二 线性与非线性模型1 线性模型2 非线性模型三 深度学习的非线性表达一 背景近年来,伴随着大数据与大算力的突破性进展,基于深度学习的突破层出不穷,基于卷积的网络结构在图像领域大放异彩、基于时序的网络模型在搜广推被广泛使用,并且产生了巨大的经济与体验效益,深受广大算法从业者的偏爱。那么什么是深度学习呢?深度学习为何会如此强悍呢?引用维基百科对于深度学习的定义:通过多层非线性变

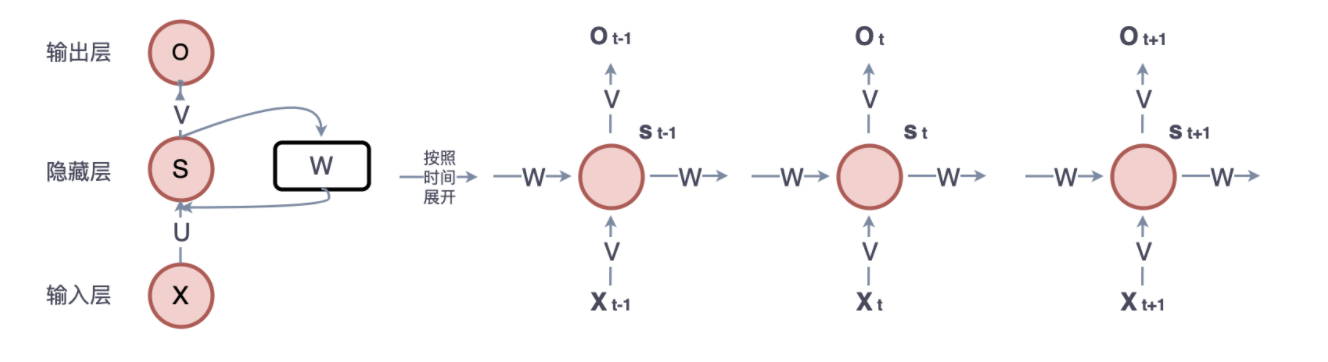

一 背景本章将要介绍一种常用的神经网络结构 – 循环神经网络(recurrent neural network,RNN)。常规的神经网络比如全连接网络只能单独孤立的处理一个个的输入,前一个输入和后一个输入是完全没有关系的。但是,某种情况下,输入是有序列关系的,需要网络能够更好的处理序列的信息。这种需要处理「序列数据 – 一串相互依赖的数据流」的场景就需要使用 RNN 来解决了。典型的几种序列数据:

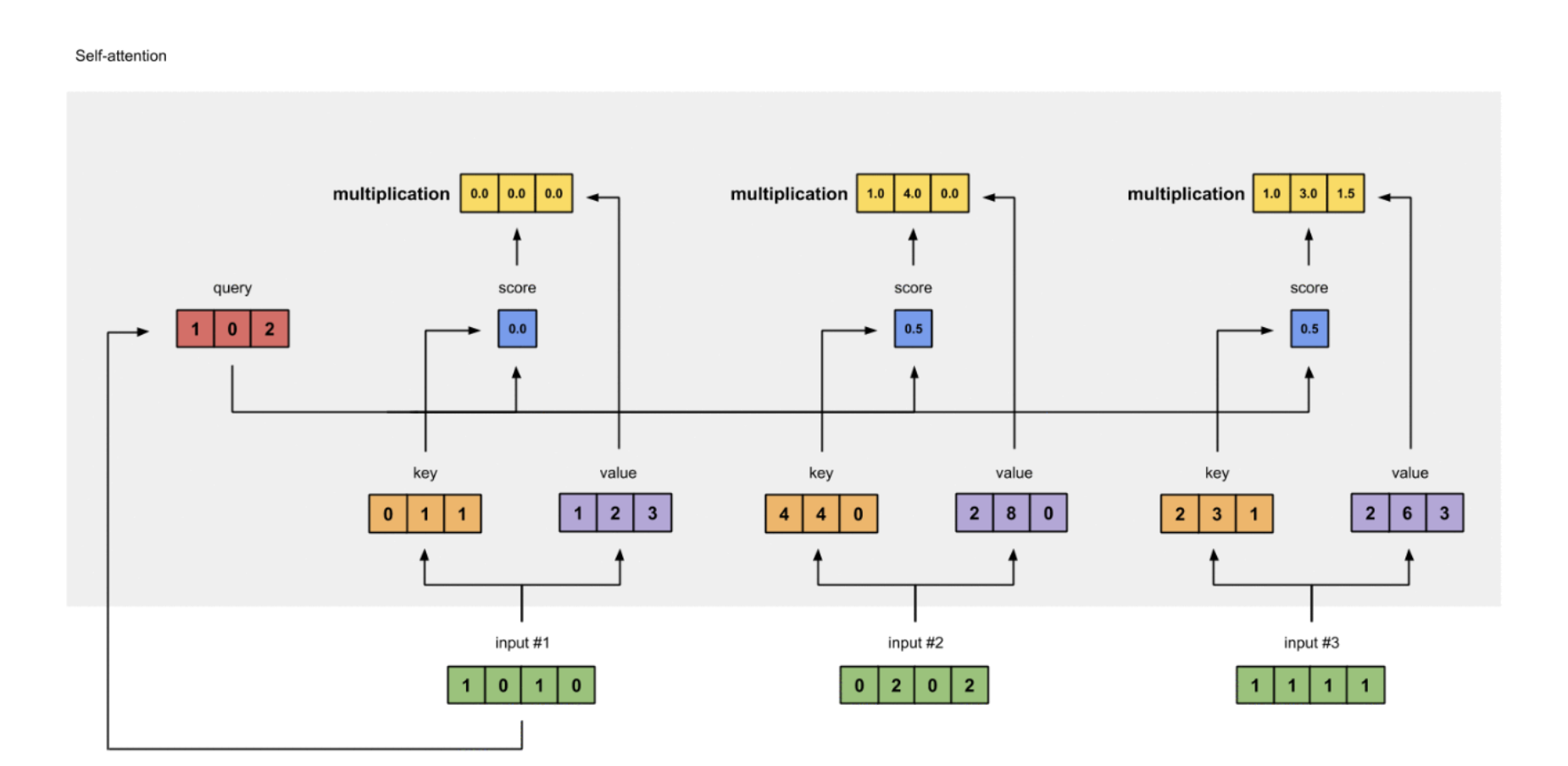

一 背景大抵是去年底吧,收到了几个公众号读者的信息,希望能写几篇介绍下Attention以及Transformer相关的算法的文章,当时的我也是满口答应了,但是确实最后耽误到了现在也没有写。前一阵打算写这方面的文章,不过发现一个问题,就是如果要介绍Transformer,则必须先介绍Self Attention,亦必须介绍下Attention,以及Encoder-Decoder框架,以及GRU、L

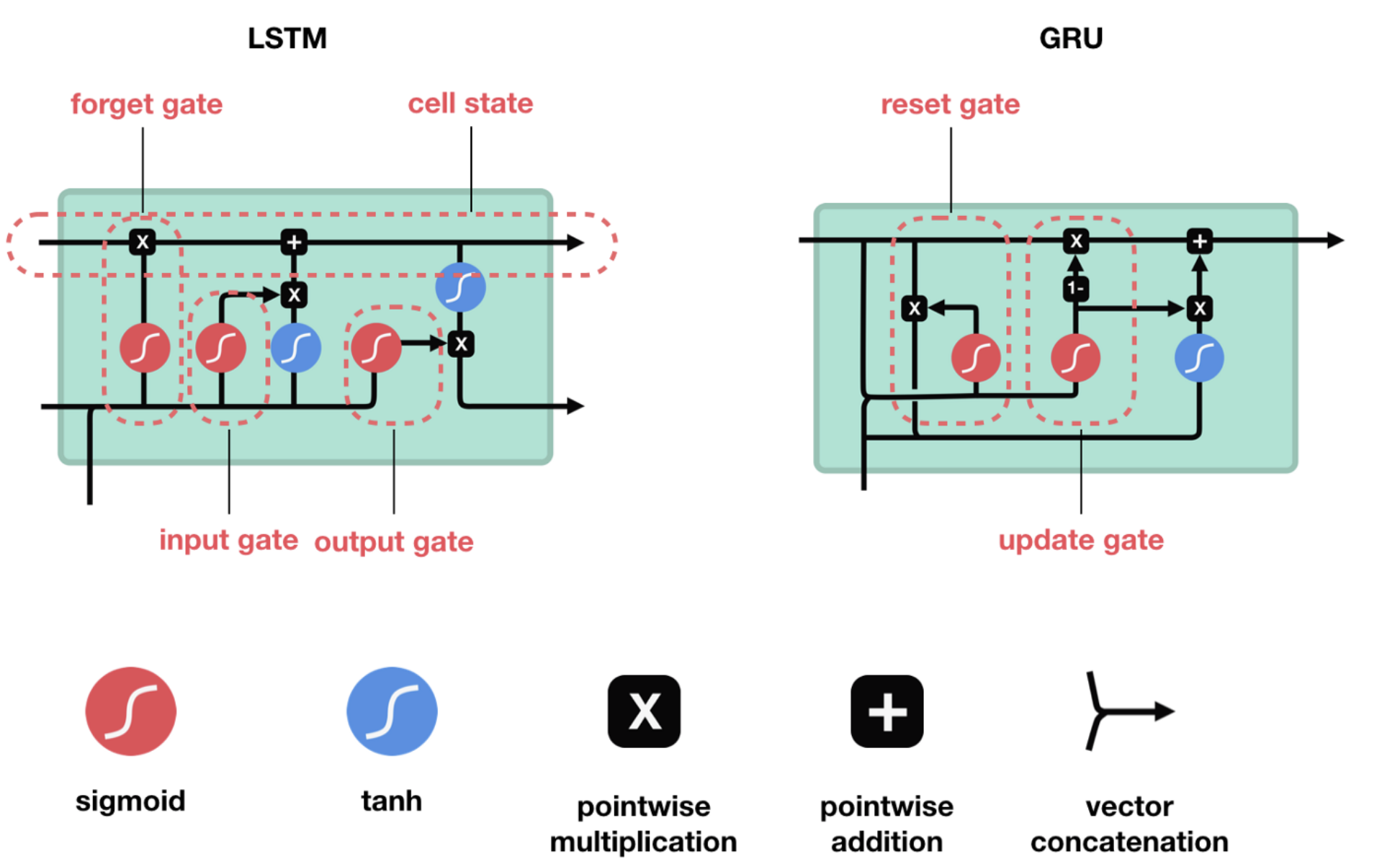

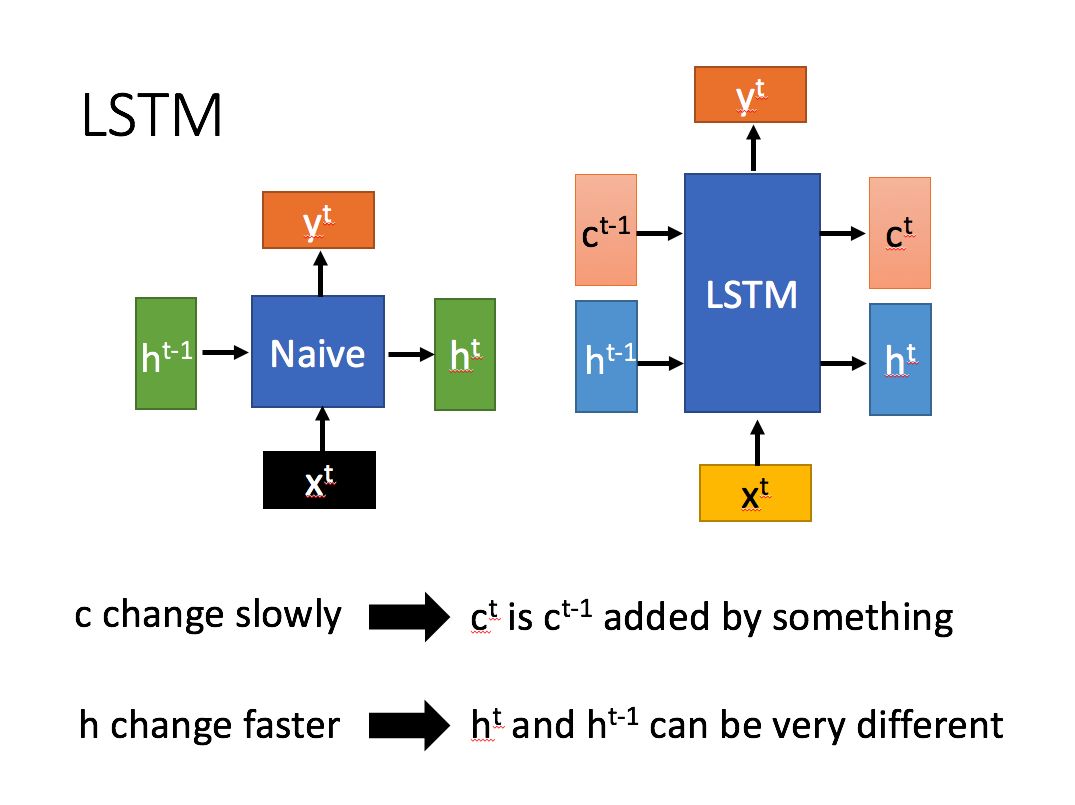

长短时记忆网络(Long Short Term Memory Network)LSTM,是一种改进之后的循环神经网络,通过门控机制有选择的记忆重要的内容,可以解决RNN无法处理长距离的依赖的问题,目前比较流行。LSTM结构(图右)和普通RNN的主要输入输出区别如下所示。

深度学习利器-GPU介绍1 深度学习之GPU近代史科技发展日新月异,摩尔定律从中显威,各种底层技术层出不穷,但是纵观科技发展史,几乎所有的新兴学科的发展背后都有一个字——“钱”!作为近年来最火热的行业——人工智能,在烧钱方面同样不遑多让。众所周知,人工智能的训练和推理都需要海量的高性能计算,做深度学习的朋友都知道,现今深度学习领域的SOTA模型往往需要巨大的显存空间,这直接导致了深度学习的研究者们

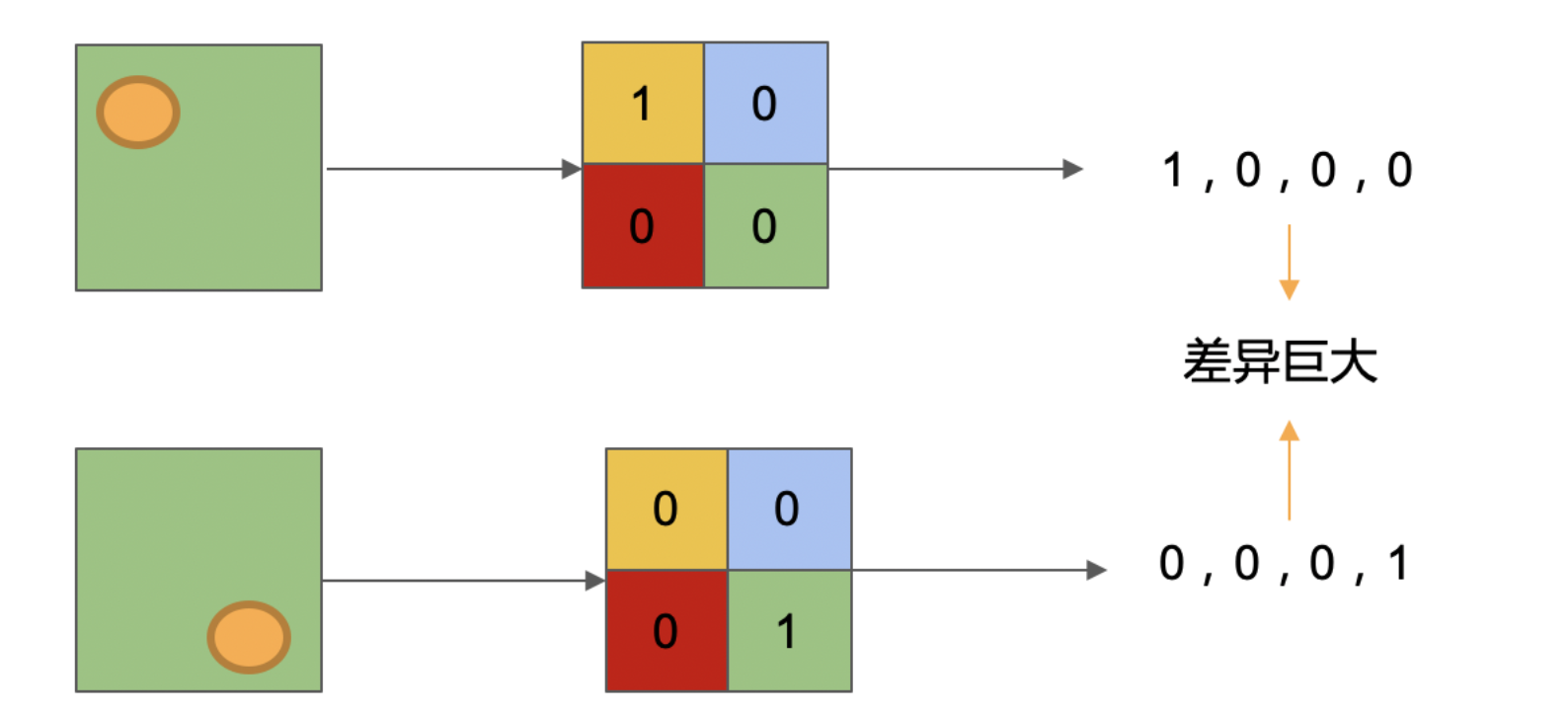

在卷积神经网络CNN 出现之前,图像对于人工智能来说是就是一个灾难,主要是有两个原因:一 图像需要处理的数据量过多;二 图像的特征无法很好的保留。CNN通过平移不变原理和参数共享机制非常完美的解决了图像特征提取的难题,在业界大放异彩。

一 背景大抵是去年底吧,收到了几个公众号读者的信息,希望能写几篇介绍下Attention以及Transformer相关的算法的文章,当时的我也是满口答应了,但是确实最后耽误到了现在也没有写。前一阵打算写这方面的文章,不过发现一个问题,就是如果要介绍Transformer,则必须先介绍Self Attention,亦必须介绍下Attention,以及Encoder-Decoder框架,以及GRU、L