简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Claude Code 是 Anthropic 官方推出的 AI 编程助手,运行在你的终端(命令行)里。,可以直接动手帮你写代码。

随着AI技术的不断发展,反事实推理的应用场景将更加广泛。它不仅有助于提高决策系统的智能化,还可以提升AI模型的透明度和可解释性。特别是在自动化决策系统、推荐系统和强化学习中,反事实推理为模型提供了更深层次的理解能力,从而更好地适应复杂的现实世界。总结来说,反事实推理是一个强大的工具,它让我们能够在面对不确定性时,基于假设条件推测潜在结果。尽管存在挑战,但其在AI和机器学习领域的潜力不可忽视。未来,

特性BatchNormLayerNorm规范化维度跨样本的同一特征单一样本内的所有特征Batch Size 依赖性依赖 Batch Size,小 Batch Size 下性能下降与 Batch Size 无关序列数据处理处理变长序列复杂天然契合序列数据处理训练推理一致性需要维护移动平均统计量,行为不一致训练推理使用相同逻辑,行为一致。

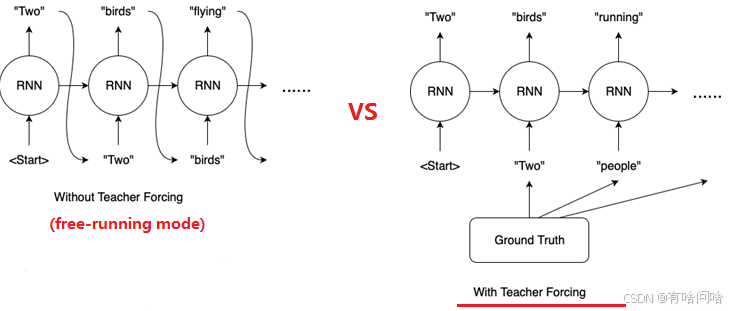

Free running 模式也常称为自动回归生成模式。其核心思想是:在生成序列时,模型不再使用真实历史数据,而是将上一步的预测结果作为下一步的输入。初始令牌(例如 “[START]”)作为输入,模型预测出第一个词将预测出的第一个词作为输入,生成第二个词如此反复,直到生成结束符“[END]”或达到预定长度这种模式直接模拟模型在实际应用中的工作方式,因此更接近真实场景。但同时,由于依赖自身预测作为输

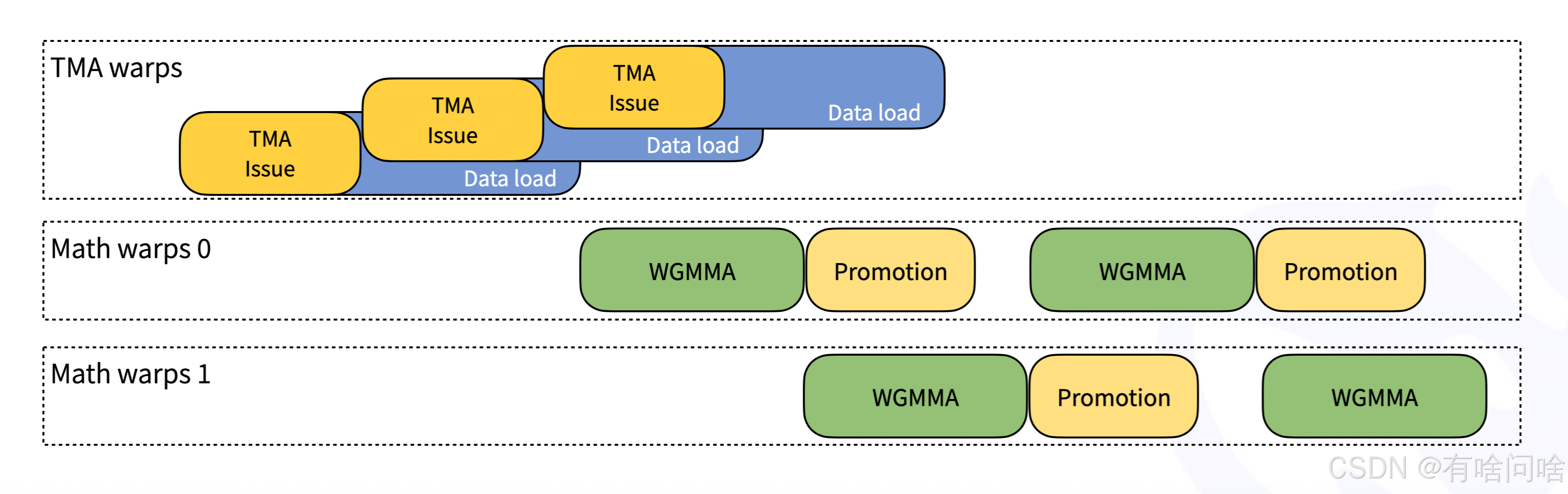

为了理解 FlashMLA 的优势,我们首先需要了解MLA 解码内核的概念。在深度学习模型,尤其是 Transformer 模型中,注意力机制 (Attention Mechanism)是核心组件之一。多层注意力 (MLA)机制是注意力机制的扩展,它允许模型在多个层级上进行信息交互和特征提取,从而更好地捕捉输入数据中的复杂关系。解码内核则指的是模型推理 (Inference) 阶段,特别是解码 (

Cα∗opAopBβ∗CCα∗opAopBβ∗CAAA和BBB是输入矩阵。CCC是输出矩阵。ααα和βββ是标量系数。opop()op代表可选的矩阵操作,例如转置或共轭转置。表示矩阵乘法。GEMM 广泛应用于各种计算密集型应用,尤其是在深度学习领域,它构成了卷积神经网络(CNN)、循环神经网络(RNN)、Transformer 模型等的核心计算层。因此,GEMM 的效率直接影响着 AI 模型的训练

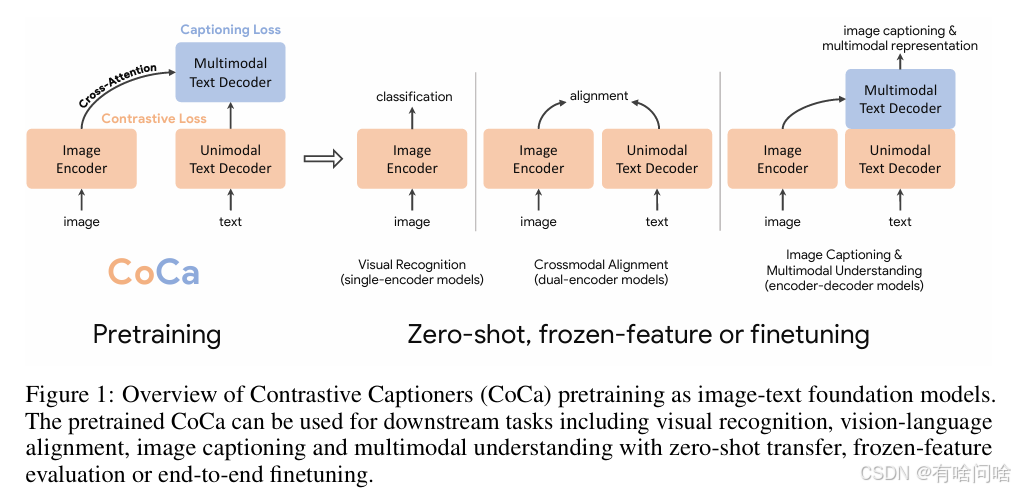

随着深度学习技术的发展,多模态模型在处理视觉和语言任务方面的能力逐渐增强。特别是大规模预训练模型的兴起,使得这些模型可以快速迁移到许多下游任务中。本文深入探讨了CoCa(ContrastiveCaptioner),这是一种新的图像-文本对齐模型,旨在同时优化对比学习和图像描述的任务。通过结合对比损失和图像描述损失,CoCa能够在一个统一的框架内实现单模态、双模态以及生成任务的有效处理。

RMSNorm 是对 LayerNorm 的有效简化,通过移除均值中心化步骤并仅使用均方根进行缩放,显著提高了计算效率,同时在许多任务中保持或超越了 LayerNorm 的性能。其简洁性和高效性使其成为现代深度学习(尤其是大型 Transformer 模型)中极具吸引力的归一化选项。

领域自适应是一种技术框架,旨在解决源领域和目标领域之间数据分布不一致的问题,同时假设这两个领域共享相同的特征空间和标签空间。其核心在于通过一系列技术手段,使模型能够学习到一种跨领域的通用表示,从而有效地将在源领域学到的知识迁移到目标领域。

Markov Chain Monte Carlo(MCMC)为我们提供了一种强大的工具,用于从复杂分布中进行采样,特别是在贝叶斯推断和概率模型中具有广泛的应用。尽管 MCMC 存在一定的收敛性和效率挑战,但随着算法的优化和硬件性能的提升,其在机器学习、统计学等领域的应用前景依旧广阔。诸如 Hamiltonian Monte Carlo(HMC)等高级变种,以及结合深度学习的方法(如变分推断与 MC