简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

刚刚,Meta发布了Meta副总裁、首席AI科学家杨立昆(Yann LeCun)亲自发布了该模型,他在官方视频中提到,在世界模型的帮助下,这可以极大提升效率。比如AI会预测我们舀出一勺东西是要放入另一个容器中:AI甚至可以理解运动员的复杂跳水动作,并进行动作拆解:据Meta测试数据,来进行自监督学习训练。在Meta看来,物理推理能力对于构建在现实世界中运作的AI agents、实现高级机器智能(A

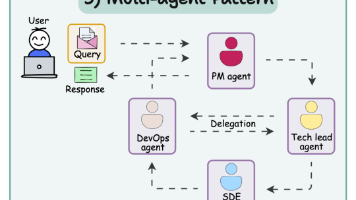

我们将筛选后的结果传递给写作智能体3:run_worwflow(query) 运行工作流程方法的完整代码如下:执行运行工作流程方法会生成预期的输出,如下图所示:当然,我们本文没有涉及 Streamlit 前端部分,完整的代码已放在 Github 上。

自然语言处理一直是人工智能最热门的应用研究领域,对科学技术、文化教育、经济社会的发展各个方面都具有极其重大的意义。近年以来,以ChatGPT 为代表的生成式预训练对话人工智能技术(即大语言模型,简称大模型)取得了令人瞩目的进展,给基于统计方法的自然语言处理技术带来了前所未有的进步。

在人工智能技术飞速发展的今天,大型语言模型(LLM)已成为技术创新的核心驱动力。本文将手把手教你使用高性能推理引擎vLLM部署Qwen大模型,并提供Python和Java两种语言的实现代码,帮助不同技术背景的开发者快速上手。

在当今信息爆炸的时代,如何从海量数据中快速准确地获取所需信息,是人工智能领域的一大挑战。Retrieval-Augmented Generation(RAG,检索增强生成)技术应运而生,它结合了检索和生成的优势,通过从大量文档中检索相关信息,再利用这些信息生成高质量的回答。然而,RAG 的实现方式多种多样,不同的技术路径有着不同的优势和局限。今天,我们就来深入探讨一下这些 RAG 技术,看看谁才是

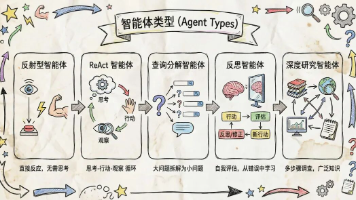

文章深入探讨AI智能体的编排策略,详述六种智能体类型及适用场景,分析三种工具选择方法和四种执行拓扑结构。强调上下文工程确保有效执行的核心作用,提供设计智能体系统的最佳实践,帮助开发者构建高效可靠处理现实世界多步骤任务的智能体系统。

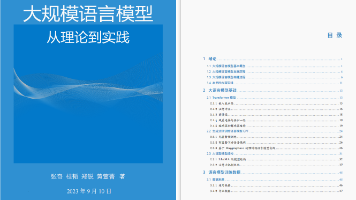

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频,免费分享!

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频,免费分享!

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!