简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

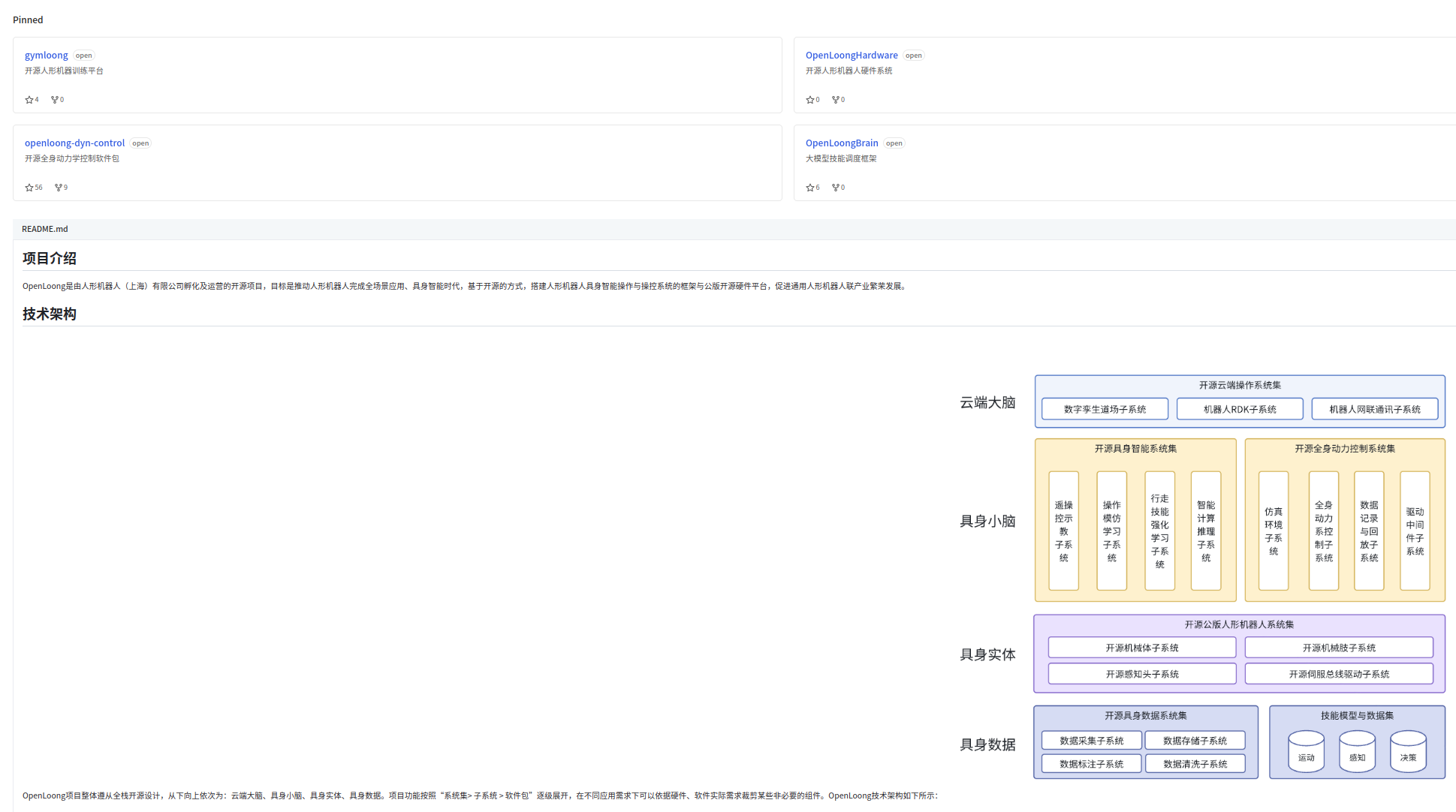

具身智能(Embodied Intelligence)是指通过物理体(如机器人或生物体)与环境进行互动而获得的智能。这种智能强调身体在认知过程中的重要性,认为智能不仅仅是大脑的功能,还包括身体的感知、运动和与环境的交互。具身智能的研究领域涉及机器人学、认知科学、神经科学等,重点在于如何通过身体的运动和感知来实现智能行为。而人形机器人与具身智能最近两年有效的结合到了一起,并以openloong为首,

rl_sar是一个开源的强化学习框架,专门用于四足、轮足和人形机器人的仿真验证与实物部署。该框架采用分层设计,包含仿真/实机层、核心库层(rl_sdk)、策略配置层和输入接口层,实现了从训练到部署的完整流程。核心模块rl_sdk定义了机器人的状态和控制命令数据结构,采用模板方法设计模式实现强化学习控制器的通用功能。框架支持PyTorch和ONNX格式的模型推理,通过统一的接口简化了不同仿真环境与真

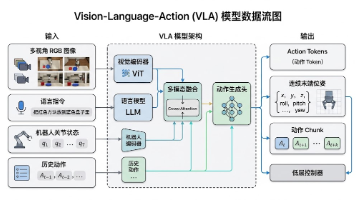

具身智能与VLA框架:核心概念与面试要点 摘要 本文系统介绍了具身智能的核心概念和VLA(Vision-Language-Action)框架。具身智能强调智能体通过身体、传感器和执行器在环境中闭环交互的能力,与传统CV/NLP的最大区别在于其动作会改变环境状态。VLA框架包含三个关键模块:视觉编码(处理多模态输入)、语言编码(理解任务指令)和动作生成(输出可执行控制)。文章详细解析了VLA的工作原

具身智能与VLA框架:核心概念与面试要点 摘要 本文系统介绍了具身智能的核心概念和VLA(Vision-Language-Action)框架。具身智能强调智能体通过身体、传感器和执行器在环境中闭环交互的能力,与传统CV/NLP的最大区别在于其动作会改变环境状态。VLA框架包含三个关键模块:视觉编码(处理多模态输入)、语言编码(理解任务指令)和动作生成(输出可执行控制)。文章详细解析了VLA的工作原

具身智能与VLA框架:核心概念与面试要点 摘要 本文系统介绍了具身智能的核心概念和VLA(Vision-Language-Action)框架。具身智能强调智能体通过身体、传感器和执行器在环境中闭环交互的能力,与传统CV/NLP的最大区别在于其动作会改变环境状态。VLA框架包含三个关键模块:视觉编码(处理多模态输入)、语言编码(理解任务指令)和动作生成(输出可执行控制)。文章详细解析了VLA的工作原

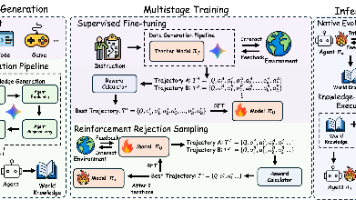

当前自进化智能体仍依赖人工预设任务和奖励机制,缺乏真正的自主探索能力。本研究提出元学习驱动的智能体进化范式,让智能体在没有明确任务时主动构建结构化环境知识(World Knowledge)。通过URL爬取聚类、知识生成、任务执行和效果评估的完整流程,智能体能预先建立环境认知地图,显著提升后续任务效率。实验表明,这种自主探索生成的知识能有效减少任务执行步数,提高成功率,为实现真正的自进化智能体提供了

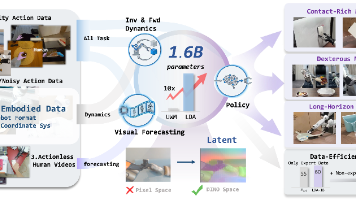

文章摘要: LDA-1B提出了一种突破性的机器人学习框架,通过整合异构数据(包括低质量轨迹、人类视频和仿真数据)来学习世界动态与动作的关系,而不仅依赖行为克隆。其核心是四任务联合训练模型(策略学习、前向/逆向动力学、视觉预测),配合标准化数据集EI-30K和分布式任务采样器,实现跨本体动作对齐。该框架将不同形态的机器人/人类动作映射到统一坐标系,利用掩码机制处理维度差异,显著提升了模型从复杂数据中

摘要 Physical Intelligence发布的π0.7机器人模型标志着通用机器人策略的重要突破。不同于简单增加任务数量或参数规模,该模型通过重构prompt设计,将任务目标、执行风格、行为质量等要素统一编码为多模态控制接口,实现了从"动作模仿"到"条件化行为生成"的范式转变。π0.7整合了前代模型在开放环境泛化(π0.5)、经验学习强化(π*0.6)

本文对当前主流视觉语言动作(VLA)模型进行了系统比较,旨在帮助读者理解不同模型的设计思路、适用场景及优缺点。文章重点分析了RT-2、OpenVLA、ACT、Diffusion Policy等8个关键模型,从动作表示、推理延迟、数据规模等维度展开对比。 核心观点包括:RT-2通过动作token化实现视觉语言与控制的统一,但存在离散误差问题;OpenVLA的价值在于提供开源可复现的VLA基线;ACT

本文对当前主流视觉语言动作(VLA)模型进行了系统比较,旨在帮助读者理解不同模型的设计思路、适用场景及优缺点。文章重点分析了RT-2、OpenVLA、ACT、Diffusion Policy等8个关键模型,从动作表示、推理延迟、数据规模等维度展开对比。 核心观点包括:RT-2通过动作token化实现视觉语言与控制的统一,但存在离散误差问题;OpenVLA的价值在于提供开源可复现的VLA基线;ACT