简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在 PyTorch 中,优化器(Optimizer)是用于更新模型参数以最小化损失函数的关键组件。在机器学习和深度学习领域,优化器是一个至关重要的工具,主要用于在模型训练过程中更新模型的参数,其目标是最小化损失函数。

这个错误 ImportError: DLL load failed while importing onnxruntime_pybind11_state: 动态链接库(DLL)初始化例程失败 表明在导入 onnxruntime 库时,Python 无法加载必要的动态链接库(DLL)文件。ImportError: DLL load failed while importing onnxruntime

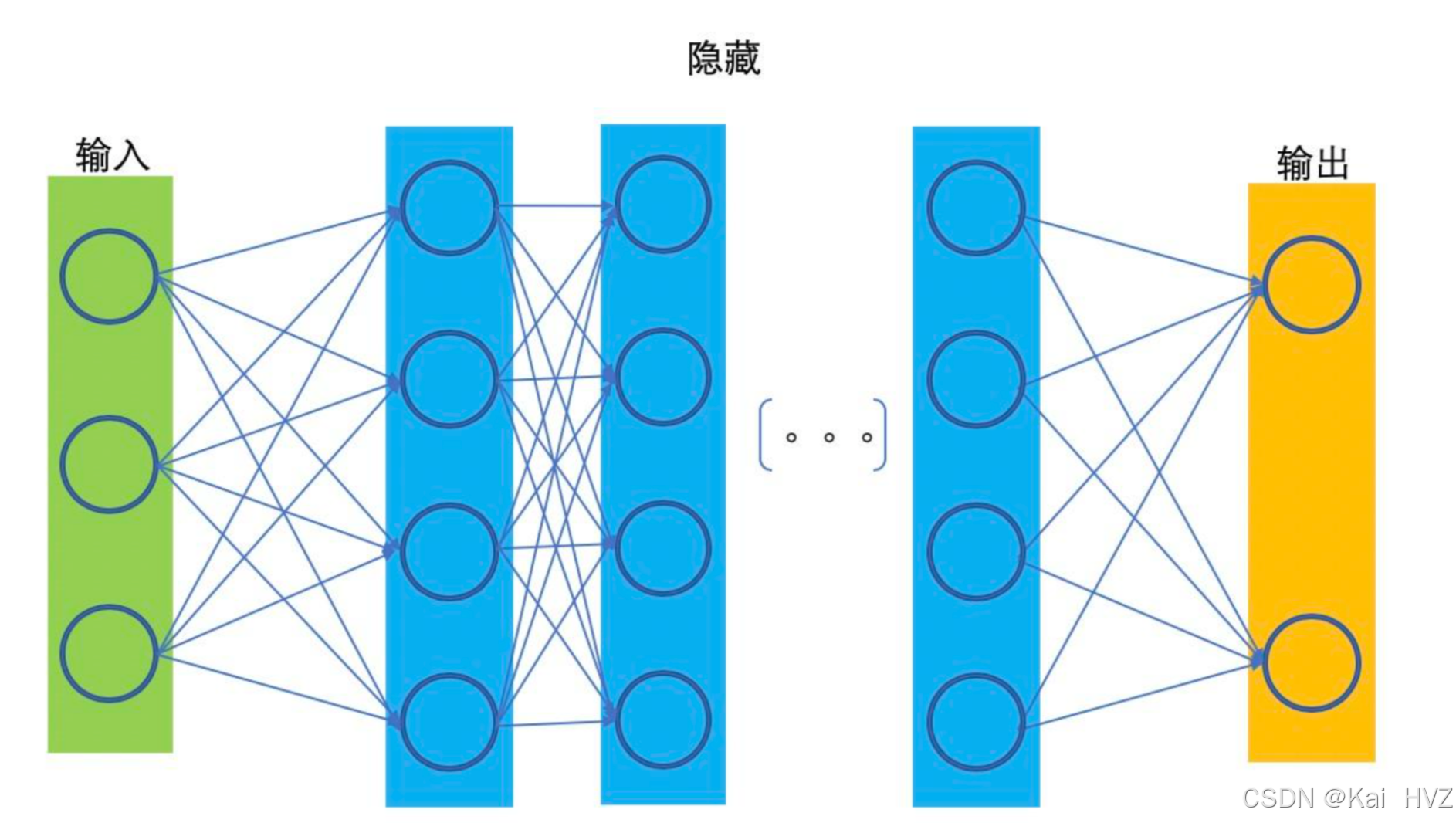

'''定义神经网络 类的继承这种方式'''class NeuralNetwork(nn.Module): # 通过调用类的形式来使用神经网络,神经网络模型nn.moduledef __init__(self): # self类自己本身super().__init__() # 继承的父类初始化self.flatten = nn.Flatten() # 展开,创建一个展开对象flattendef fo

YOLOv5 是一种目标检测算法,属于 YOLO(You Only Look Once)系列的第5代版本。YOLOv5 是一个广泛使用的目标检测算法,它基于 YOLO(You Only Look Once)系列的思想,具有速度快、精度高的特点。它和YOLOv4的区别是v4是属于学术上的,而v5增加了工程上的使用。它在目标检测领域有着重要地位,结合了许多先进的技术,在速度和精度上取得了较好的平衡。主

定义一个名为 CNN 的卷积神经网络类,继承自 nn.Module# 调用父类 nn.Module 的构造函数# 定义第一个卷积层块# nn.Conv2d(1, 64, 5, 1, 2):输入通道数为 1(因为是灰度图),输出通道数为 64,卷积核大小为 5x5,步长为 1,填充为 2# nn.ReLU():使用 ReLU 激活函数增加模型的非线性# nn.MaxPool2d(kernel_siz

迁移学习(Transfer Learning)是机器学习中的一个重要概念,旨在将从一个任务(源任务)中学习到的知识应用到另一个相关的任务(目标任务)中,以提高目标任务的学习效率和性能。在传统的机器学习中,模型通常是在特定的数据集上进行训练,并且只能在相似的任务上表现良好。如果遇到新的任务,就需要重新收集和标注大量的数据,并从头开始训练模型。迁移学习的出现,为解决这些问题提供了一种有效的方法。迁移学

YOLOv4 是一种目标检测算法,属于 YOLO(You Only Look Once)系列的第四代版本。它在目标检测领域有着重要地位,结合了许多先进的技术,在速度和精度上取得了较好的平衡。主要特点高效的检测速度:和传统的目标检测算法相比,YOLOv4 速度极快,能够实时处理视频流,这让它可以在对实时性要求较高的场景中使用,比如自动驾驶、视频监控等。高检测精度:它通过采用一系列先进的技术和改进的网

损失函数用于衡量模型的好坏,正则化惩罚用于防止过拟合,梯度下降用于优化模型参数,它们在神经网络的训练中起着至关重要的作用,相互配合,使得神经网络能够学习到数据中的规律,提高模型的性能和泛化能力。损失函数(Loss Function)用于衡量模型预测结果与真实标签之间的差异程度,它是评估模型性能的重要指标,也是模型训练过程中的优化目标。正则化惩罚是一种用于防止神经网络过拟合的技术,通过在损失函数中添

PyTorch 是一个开源的深度学习框架,由 Facebook 的人工智能研究团队开发。pytorch的cuda版本不要高于电脑的cuda版本,否则cuda和pytorch不可用。,cuda下载步骤可自行搜索下载,但是一定要对应版本号,高版本可向下兼容低版本。GPU版本安装首先电脑要有显卡才可以,并下载。以本人电脑为例,电脑cuda版本为12.4。强大的 GPU 支持。再根据cuda的版本。

threading 是 Python 标准库中用于实现多线程编程的模块。多线程编程允许程序同时执行多个任务,提高程序的并发性能,尤其适用于 I/O 密集型任务,例如网络请求、文件读写等。