简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大语言模型的工作原理简析 大语言模型(LLM)是一种基于海量文本训练的AI系统,核心任务是预测下一个最可能的词(Token)。通过预训练、指令微调和强化学习三阶段训练,模型学会生成流畅、合理的回答。 关键机制: Token化:将文字切分为数字化的片段。 Embedding:将Token映射为高维向量,捕捉语义关系。 自回归生成:逐步预测并拼接Token,形成完整回答。 模型能力与局限: 优势:依赖

2023 年,我们让 AI “自己跑”——然后发现它会跑偏。2024 年,我们给 AI “套上缰绳”——用框架约束行为。2025 年,我们给 AI “修好公路”——用 MCP/A2A 标准化连接。2026 年,我们开始"养 AI"——让它持续运行、学习、进化。技术选型的终极答案不是"哪个框架最好",而是"你的组织准备好了吗"。框架之争终将尘埃落定,操作系统之战也会分出胜负。但真正决定 Agent

2023 年,我们让 AI “自己跑”——然后发现它会跑偏。2024 年,我们给 AI “套上缰绳”——用框架约束行为。2025 年,我们给 AI “修好公路”——用 MCP/A2A 标准化连接。2026 年,我们开始"养 AI"——让它持续运行、学习、进化。技术选型的终极答案不是"哪个框架最好",而是"你的组织准备好了吗"。框架之争终将尘埃落定,操作系统之战也会分出胜负。但真正决定 Agent

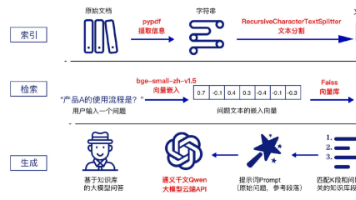

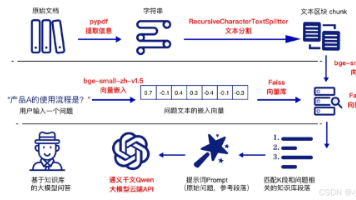

本文详细介绍了从零开始搭建RAG(检索增强生成)应用的完整流程。主要内容包括:技术框架选型(LangChain、pypdf、Faiss等)、开发环境配置(Python虚拟环境搭建及依赖库安装)、核心流程实现(索引、检索、生成三大环节)。通过具体代码示例演示了PDF文档解析、文本分块、向量化处理、相似度检索以及调用通义千问大模型生成回答的全过程。文章提供完整的技术栈组合方案和实战代码,帮助开发者快速

本文详细介绍了使用Python搭建RAG系统的完整流程。基于LangChain框架,采用PyPDF解析文档、bge-small-zh-v1.5进行向量化、Faiss存储向量、通义千问生成回答的技术方案。文章包含开发环境配置、核心代码实现(索引、检索、生成流程)及测试脚本,并提供了阿里云API密钥获取指南。通过实战代码帮助开发者快速掌握RAG应用开发,适合需要构建中文问答系统的读者参考。

本文介绍了如何将阿里巴巴的千问大模型Qwen 1.8B部署到Android手机端,实现离线使用。主要步骤包括:1)通过MLC-LLM框架转换模型权重并生成配置文件;2)编译适用于Android的模型库;3)修改APK配置文件并绑定Android库;4)安装APK并实测运行效果。最终实现每秒约20个token的生成速度,使大模型能在断网环境下正常使用。文章详细说明了模型转换、编译配置和APK打包等关

文章展示了利用千问大模型辅助SPSS数据分析的完整流程,包括数据预处理和跨国比较分析。作者强调AI助手功能日益强大,能帮助人们从执行者向管理者转变,但指出扎实的数据分析基础和实战经验至关重要。AI具备强大的文本、编程和作图能力,在数据分析领域有广阔的应用前景。

摘要:本文介绍了如何通过开源工具Ollama在本地部署AI大模型(如通义千问),详细演示了从下载安装到模型运行的完整流程。文章指出AI大模型虽存在局限性,但已成为不可逆的技术趋势,建议读者积极学习AI技能以适应变革。最后提供了AI大模型学习路径和资源获取方式,包含系统学习路线、实战案例及免费资料包,帮助开发者掌握从基础到进阶的AI应用能力。全文强调"未来淘汰的是不会用AI的人"

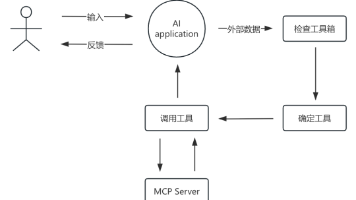

AI大模型通过MCP协议与外部数据源无缝集成,解决"知识截止"问题。在电商仓储中,这种结合实现库存管理、补货规划、劳务调配和运营优化等环节的智能化,提高效率。未来,AI+MCP将重塑电商仓储管理,实现从预测分析到自主执行的全流程智能化,推动仓储管理向更高效、更智能方向发展,助力企业数字化转型。

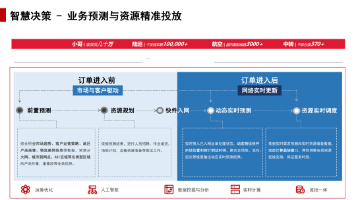

顺丰通过AI智能体技术构建物流"智能大脑",实现从订单预测到全流程管理的智能化。系统采用三层架构(业务应用层、AI智能体层、垂域模型层),结合大小模型协同,具备记忆、规划和工具协同能力。通过RAG技术增强知识应用,已在车辆调度等场景取得显著成效,未来将向更专业化、多智能体协同方向发展,持续提升物流效率。