简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

分词(Tokenization)是大语言模型(LLM)的核心基础技术,旨在将文本拆分为具有语义的词元(token)。主流分词方法包括词粒度、字符粒度和子词粒度,其中子词粒度(如BPE、WordPiece)通过平衡词表大小与语义表达成为LLM的默认选择。分词质量直接影响模型性能,是导致LLM拼写错误、数字处理异常等问题的根源。当前主流工具库(如SentencePiece、Hugging Face T

阿里云多模态大模型岗三面面经:三轮面试各有侧重,一面考察CLIP、BLIP等模型原理与代码实现(InfoNCE Loss等);二面聚焦宏观理解,涉及多模态发展脉络、数据清洗等开放性问题;三面以项目深挖和趋势讨论为主。整体注重候选人对技术的深度理解而非表面应用,建议重点掌握经典模型原理、设计动机及代码实现。面试官特别关注"为什么这样设计"的思考过程,项目经历需准备充分。

本文系统介绍了大语言模型(LLM)的核心概念与技术原理。LLM本质上是专门处理文本的深度神经网络,通过海量参数(如GPT-3的1750亿)实现语言理解和生成能力。Transformer架构是LLM的技术基础,其自注意力机制突破了传统NLP模型的限制。LLM实现了从专用工具到通用平台的跨越,可应用于内容创作、对话系统、翻译等多个领域。文章强调理解Transformer等底层原理的重要性,指出只有掌握

vLLM是伯克利团队开发的AI大语言模型高效推理引擎,其核心创新PagedAttention技术借鉴操作系统分页机制,显著提升内存利用率。相比传统框架,vLLM在吞吐量、推理速度和显存利用率上均有突破性提升,最高可达24倍吞吐量增长。该技术已应用于聊天机器人、智能客服等场景,并能通过简单pip安装快速部署。未来vLLM将持续优化模型支持与性能,拓展医疗、教育等领域的应用。

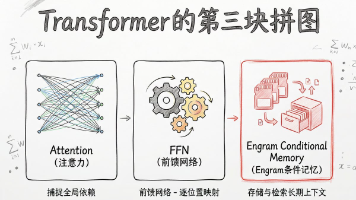

DeepSeek发布重磅论文提出Engram组件,为Transformer架构引入第三个核心模块。Engram作为条件记忆机制,能快速识别和检索多词元模式,避免传统架构中重复构建特征的计算冗余。研究团队通过精细实验设计证明,Engram与MOE分别代表条件记忆和条件计算两个不同的稀疏性维度,最佳配置是将20-25%稀疏容量分配给Engram。机制分析显示,Engram能显著提升模型早期层的表现,在

AI世界真相:ChatGPT等应用只是"门",背后是GPT等核心模型在运作。三大主流AI阵营各有优势:OpenAI的GPT-5.2是全能选手,Google的Gemini深度整合办公生态,Anthropic的Claude擅长编程推理。开源模型如DeepSeek、Llama让用户实现"从租到有"的转变。AI正从聊天转向代理模式,能直接执行多步骤任务。建议根据需求

AI世界真相:ChatGPT等应用只是"门",背后是GPT等核心模型在运作。三大主流AI阵营各有优势:OpenAI的GPT-5.2是全能选手,Google的Gemini深度整合办公生态,Anthropic的Claude擅长编程推理。开源模型如DeepSeek、Llama让用户实现"从租到有"的转变。AI正从聊天转向代理模式,能直接执行多步骤任务。建议根据需求

AI世界真相:ChatGPT等应用只是"门",背后是GPT等核心模型在运作。三大主流AI阵营各有优势:OpenAI的GPT-5.2是全能选手,Google的Gemini深度整合办公生态,Anthropic的Claude擅长编程推理。开源模型如DeepSeek、Llama让用户实现"从租到有"的转变。AI正从聊天转向代理模式,能直接执行多步骤任务。建议根据需求

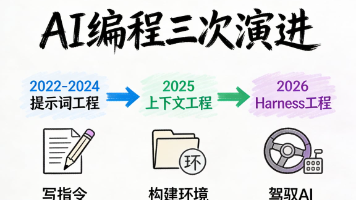

OpenAI 团队在总结他们的工作时说了这么一句话,我们现在最大的挑战在于设计环境、反馈循环和控制系统。换句话说,他们不写代码,他们写的是规则。Stripe 的工程师也不写代码,他们设计的是 Blueprint,确定性节点和 Agentic 节点的混合编排,全程管控 AI 的执行流程。这说明什么?这说明一个根本性的变化,工程师的价值,或者说程序员的价值,正在从写代码的人变成设计让 Agent 可靠

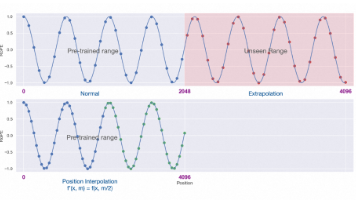

本文介绍了Transformer模型中的自注意力机制及其实现细节。首先讲解了自注意力层的计算过程,包括Q、K、V的线性变换、多头注意力重要的是要除以√d_k进行缩放,以防止梯度消失。文章还讨论了位置编码的必要性,并详细介绍了RoPE和Alibi两种位置编码方法。RoPE通过旋转实现相对位置编码,而Alibi则通过偏 bare attention分数来引入位置信息。文中提供了自注意力层的Python