简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

ChatGPT Images 2.0 实现 AI 生图能力大幅跃升,超写实画面可还原真实质感与场景氛围。它相较传统模型,在语义场景理解、多语言文字精准渲染、局部无损修改、角色风格一致性把控上优势突出,已能胜任电商主图、活动海报、PPT 配图等商业设计场景,可替代部分基础设计工作。但该工具以假乱真的生图能力,也大幅降低造假门槛,易滋生虚假新闻、伪造证据、造谣诈骗等问题。当下需依托技术水印、平台监管,

ChatGPT Images 2.0 实现 AI 生图能力大幅跃升,超写实画面可还原真实质感与场景氛围。它相较传统模型,在语义场景理解、多语言文字精准渲染、局部无损修改、角色风格一致性把控上优势突出,已能胜任电商主图、活动海报、PPT 配图等商业设计场景,可替代部分基础设计工作。但该工具以假乱真的生图能力,也大幅降低造假门槛,易滋生虚假新闻、伪造证据、造谣诈骗等问题。当下需依托技术水印、平台监管,

ChatGPT Images 2.0 实现 AI 生图能力大幅跃升,超写实画面可还原真实质感与场景氛围。它相较传统模型,在语义场景理解、多语言文字精准渲染、局部无损修改、角色风格一致性把控上优势突出,已能胜任电商主图、活动海报、PPT 配图等商业设计场景,可替代部分基础设计工作。但该工具以假乱真的生图能力,也大幅降低造假门槛,易滋生虚假新闻、伪造证据、造谣诈骗等问题。当下需依托技术水印、平台监管,

本来以为在Mac上搭建vue.js的环境挺简单的,谁知遇到各种问题(可能是RP问题),网上解决的方法也寥寥无几,这里就记录下遇到的坑。一、vue.js开发环境1、安装 brew,这个简单,直接执行远程脚本/usr/bin/ruby -e "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/mas

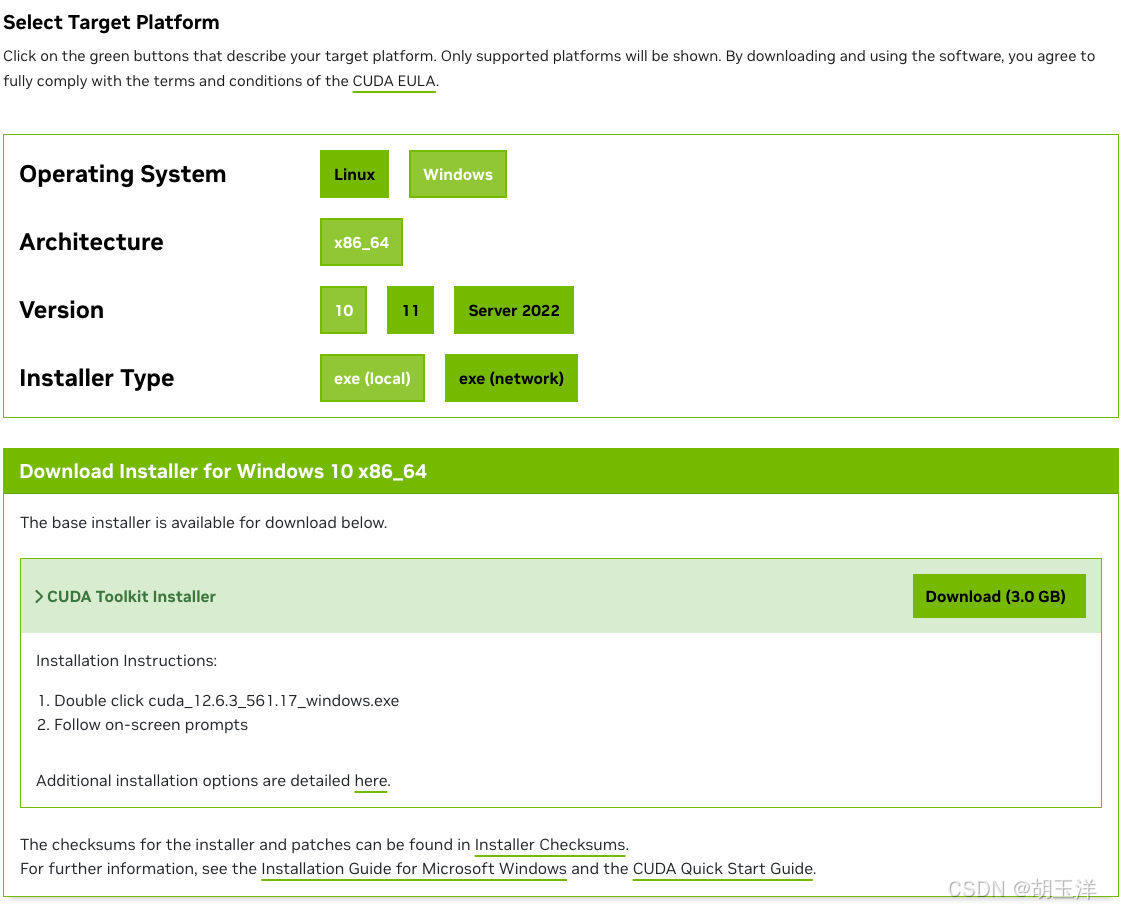

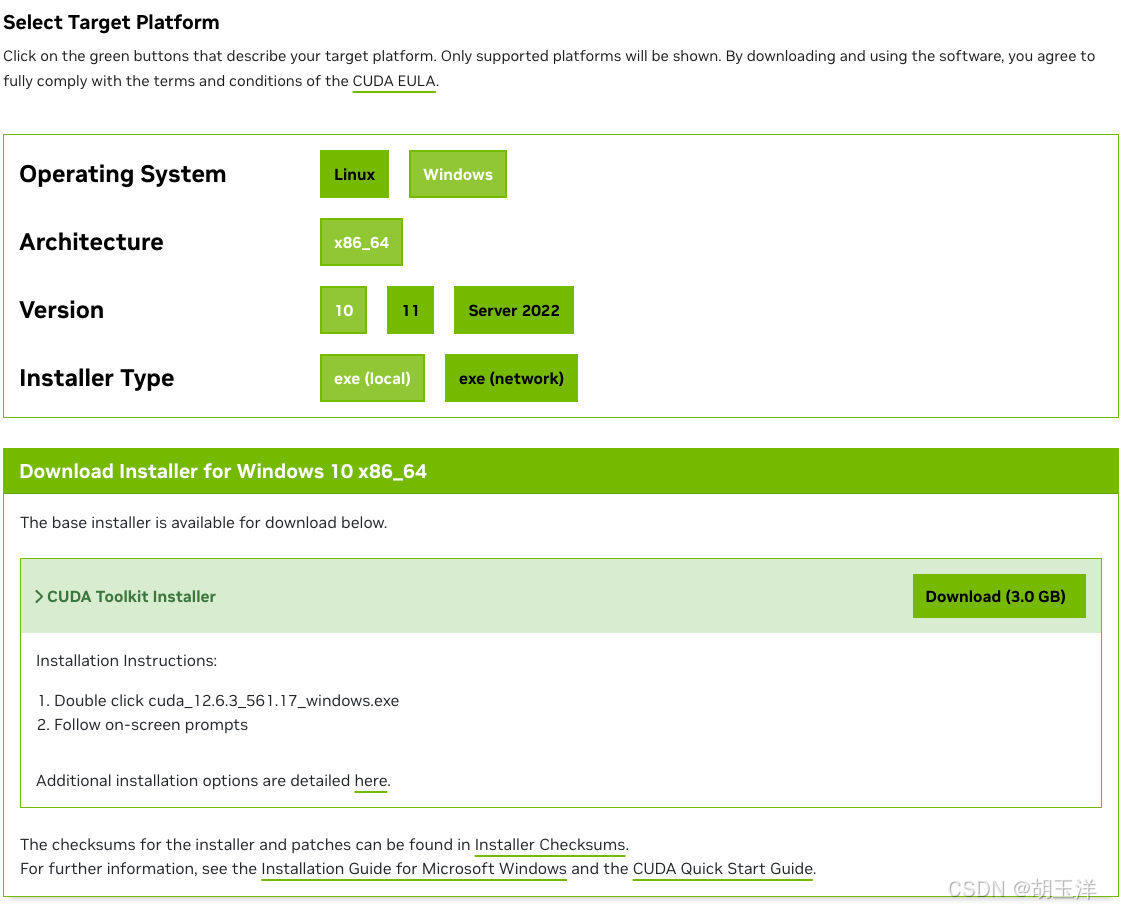

CUDA 是 NVIDIA 推出的并行计算平台和编程模型,专为利用 GPU 加速深度学习任务而设计。PyTorch 和 TensorFlow 等深度学习框架通过 CUDA 调用 GPU 资源,显著提升模型训练和推理的效率。CUDA 生态系统包括上层框架(如 PyTorch、TensorFlow)、中层加速库(如 cuDNN)和底层工具(如 CUDA Toolkit),共同为深度学习提供强大的计算支

本文介绍在 macOS 系统通过 Docker 本地部署 OpenClaw(小龙虾)AI 助手的完整流程。因直接安装存在安全风险、云服务成本高且隐私不可控,Docker 部署具备环境隔离、数据本地存储、安装简便等优势。部署需先安装 Docker Desktop,准备大模型 API,再下载源码执行安装脚本,随后通过配置向导完成快速设置,配置模型信息并跳过部分可选模块。登录时需记录 Token,若遇设

本文介绍在 macOS 系统通过 Docker 本地部署 OpenClaw(小龙虾)AI 助手的完整流程。因直接安装存在安全风险、云服务成本高且隐私不可控,Docker 部署具备环境隔离、数据本地存储、安装简便等优势。部署需先安装 Docker Desktop,准备大模型 API,再下载源码执行安装脚本,随后通过配置向导完成快速设置,配置模型信息并跳过部分可选模块。登录时需记录 Token,若遇设

Dubbo是一个分布式服务框架,以及SOA治理方案。其功能主要包括:高性能NIO通讯及多协议集成,服务动态寻址与路由,软负载均衡与容错,依赖分析与降级等。Dubbo是Alibaba开源的分布式服务框架,它最大的特点是按照分层的方式来架构,使用这种方式可以使各个层之间解耦合(或者最大限度地松耦合),我们可以非常容易地通过Dubbo来构建分布式服务,并根据自己实际业务应用场景来选择合适的集群容错模式,

CUDA 是 NVIDIA 推出的并行计算平台和编程模型,专为利用 GPU 加速深度学习任务而设计。PyTorch 和 TensorFlow 等深度学习框架通过 CUDA 调用 GPU 资源,显著提升模型训练和推理的效率。CUDA 生态系统包括上层框架(如 PyTorch、TensorFlow)、中层加速库(如 cuDNN)和底层工具(如 CUDA Toolkit),共同为深度学习提供强大的计算支

本文记录了 Claude Code 的一次完整实战使用过程,包括工具定位介绍、本地安装与代理配置、首次使用时“额度不足”问题的原因分析,以及如何接入第三方大模型继续使用。文章详细对比了手动修改配置与使用 CC-Switch 进行模型切换的方式,并介绍了其工作原理与使用体验。最后简要扩展了 Claude Code Router 这一进阶方案,说明其基于 Prompt 动态路由多模型的能力,帮助开发者