简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

仍以 chatgpt 为例,它的内部结构绝不是文字信息简单堆砌塑造而成,而是表现出一定的结构,训练数据较少时,这种结构不明显,看起来就是堆砌的噪声,随着训练数据增多,好看的结构便涌现出来,这可能是语言本身的结构,也可能是人类逻辑的本质展现,但没人能解释这种涌现到底是什么,就像没人能解释意识是什么一样,它就在那里。人自出生就通过视觉,听觉,触觉不停接收信息,这些信息不停对大脑神经元结构进行塑造,触发

我经常思考,在根本不知道曲线外还有一条准线的时候,是怎样知道它的存在的呢,虽然丹德林在 19 世纪用立体几何切线长定理找到了准线,但那是 1500 多年以后的事了,况且那个时候已经知道准线的存在,丹德林只是在圆锥中确定了它们的定位方法,实则一种作图法。帕普斯时代,他的知识仅限于阿波罗尼奥斯,阿基米德已经证明的结论,以及基于欧几里得纯几何的平方和,平方差,二次,三次多项式运算,仅依赖这些,如何寻求一

剩下还有一个原则我只字未提,即 “端到端的流量控制”,原因在于这属于私人范畴,于统计系统无关,只要有 W = min(cwnd, rwnd) 兜底,流控就无法进入公共领域,同理的一个私人范畴的例子是 BBR,从 Google 发布它开始迄今,BBR 一致在私人范畴被优化,它只为提高个别流量的吞吐,值得注意的是,BBR 在 Google 内部骨干网并非没有被公共权力管辖,它的部署环境是 G 家的 B

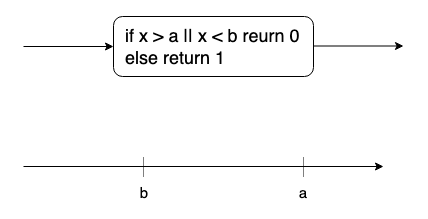

目前大多数防火墙还是传统的基于五元组的防火墙,我觉得这太差劲了,我认为只有第七层防火墙才是真正的防火墙,五元组不能标示一个应用,正如tcp的80端口并不总是代表http一样,想要标示一个应用,你必须去分析第七层的协议头,而不是联合第三层,第四层的协议头,毕竟我们需要匹配一个第七层的应用,那就要需要第七层的协议头!然而第七层解析的问题何在?我觉得这有两方面,第一方面是谁提供了匹配的内容,也就是协议头

<br />网络拓扑如下:hostA/B/C处于同一个局域网:<br />hostA:<br />eth0:192.168.0.2<br />----------------------<br />hostB:<br />eth0:192.168.0.1<br />eth1:10.0.0.1<br />----------------------<br />hostC:<br />eth0:192

不要在网络设备中show算法,赶紧让数据包通过,否则扣留。网络设备永远都是数据包要快速离开的地方,赶紧走,越快越好。我说这话可能有点矛盾,快速离开没有可以show的算法怎么能行?!问题是,不该你做的事就别做,你根本就不是一个专业防火墙,干嘛搞什么垃圾iptables!把你自己能做的工作,做好,show完美,其他的交给行家,交给适合的设备。网络通路中的算法不限于本机,整个路径中的每一个节点之间运行的

中华国学,用英文讲的,稀里糊涂听了个大概,不得不佩服西方人的缜密的逻辑思维,竟然把玄之又玄的道家思想说的跟牛顿定律一般,佩服。归家,又收到了邮件,还是关于nf-hipac的,不知不觉就想彻底整理一篇文章说个明白,可是哪有个够啊哪有个够。 匆匆吃完晚饭,碗也没刷,餐桌狼藉,家人都在看电视,玩手机,小小依然捧着iPad...我的摊子如下: 如果说理论分析不足以镇住人,或者说一上

人从婴儿到成人,一直在不停学习某种或几种语言的听说读写,本质上是在不断建立形象的,抽象的,具象的,概念的世间万物和某种符号的映射关系,从字到词,词组,句子的读写,到吵架,面试,扯淡,演讲,辩论,都是这种映射关系的学习,矫正,甚至遗忘,即增删改查。中国人无论听到哪个读音,残缺的,方言,连读的,学名,都能想到 🍎,但对于老外学中文,除了按照他学习时老师教的标准普通话 “pingguo” 读音和写法之

昨晚为了解决公司的一个bug熬了个夜,等待期间花了半小时撸了一个bpfilter的简易POC,今早发了个朋友圈:且看这个链接:https://lwn.net/Articles/747504这个POC还是复杂了,而且标准发行版里根本就不可用,ko模块不可执行,依然是标准模块。原理就这么简单,想证明可行性大可不必折腾大场面搞什么umh的(作者的意图显然是站技术实现的立场的,而我从业务角度考虑...

最近一直在分析数据包。同时也一直想学python。凑一块儿了...于是,便开工了。座椅爆炸!正文首先要说的是,我知道python有很多解析pcap文件的库,这里不使用它们的原因是为了理解pcap文件的格式细节。使用tcpdump你可以很容易抓取到一系列的数据包,然而tcpdump并没有分析数据包的功能,如果想从这个抓包文件中分析出一些端倪,比如重传情况,你必须使用wireshark之类的软件,用w