简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

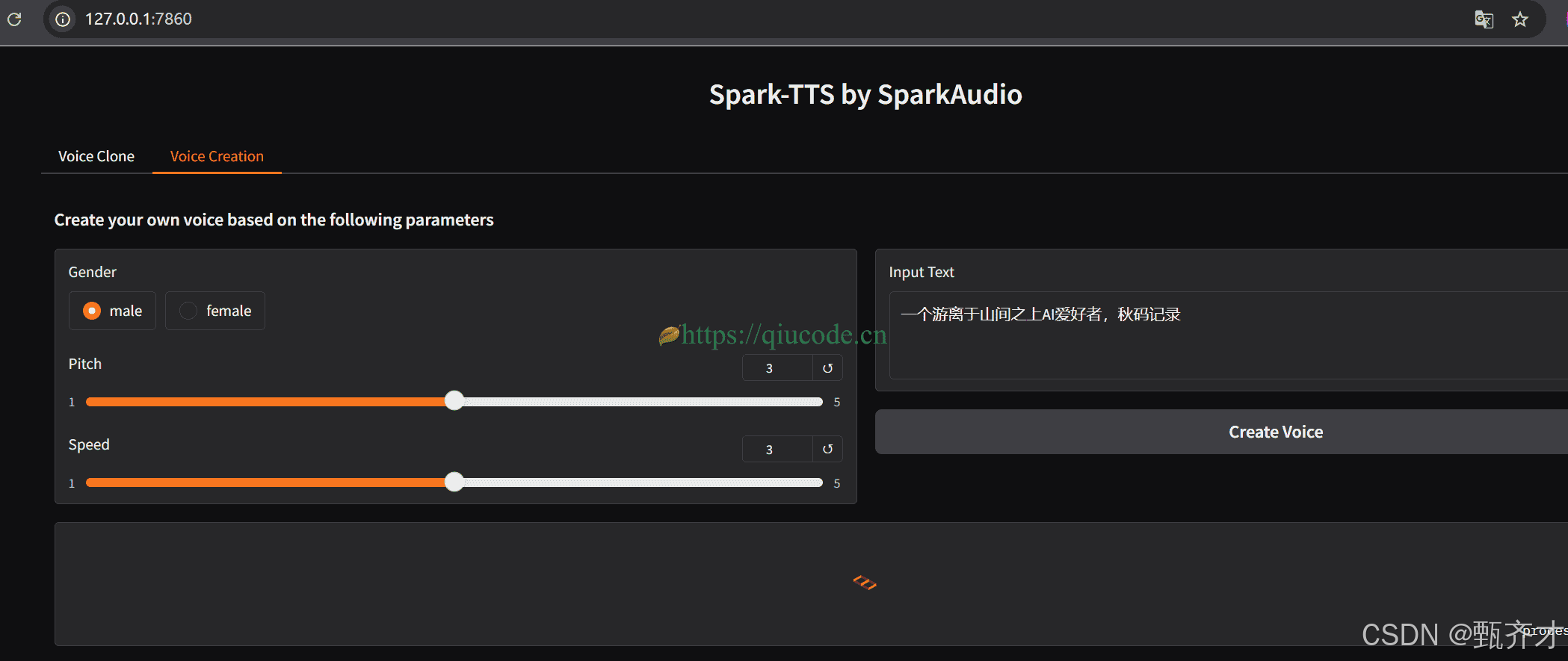

在人工智能时代,语音合成()技术已成为人机交互的核心组件之一。然而,传统系统长期受限于多阶段架构复杂、语音控制能力弱、跨语言表现差等问题。

Whisper是由OpenAI开发的开源语音识别模型,以其著称。它通过68万小时的多语言、多任务数据训练,覆盖100+语言,支持语音转录、翻译和语言检测,成为目前最通用的语音识别工具之一。

本文已同步发表个人博客网站 https://qiucode.cn/article/911、定义模块与设置头部首先先在app.json文件中定义首页、分类、购物车以及我的四个模块。背景颜色为白色,名称是秋码淘好货"pages":["pages/index/index","pages/category/category","pages/cart/cart","pages/personal/person

github首先在你的本地项目创建一个文件夹,如upload。用于要显示的图片。然后编辑README.md文件,其语法如下:例如:

作为一位IT或coder(码农、程序员),在日常工作中,多多少少都会有技术知识的积累(生产环境中所遇到的问题【亦可称为是坑】)。俗话说得好,好记性抵不过烂笔头。不管是前沿技术的研习后的心得,还是工作中所遇到的问题,亟需将这些笔记留存下来,为的是以备后续查看(未来有可能遇到类似的坑,也好该如何下手,以不至于手忙脚乱的),当然咯,在方便自己的同时,也分享给他人。那既然只是为了留存笔记而已,又何必去搭建

同样的,还是在左侧导航栏,找到域名与传输管理这一泪目,点开它底下的自项,点击自定义绑定域名。在绑定自定义域名之前,你得先确认你刚购买的COS区域是国内的,还是非国内的,若是国内区域的COS,那么你绑定自定义域名时,这个自定义域名是需要备案的。当然咯,COS购买时选择的是香港区域自定义域名是不需要备案的哦!

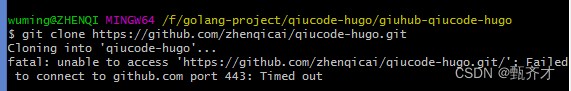

国内访问github.com总是那么不竟如人意,时而无法加载网页,时而等我们抽完了一根烟后,它还处于转圈的状态。虽然国内有gitee.com等诸多的代码托管平台,但却鲜有国人愿意去呢?其中的缘由,想必也不用我多说,大伙也都心知肚明了吧!即便github.com在国内访问慢,或是加载不出来,我们也宁愿等它慢慢地加载出来,却不愿将代码托管于境内的平台。

共识,从字面上来看,是在某方面达成一致。打个比方,一个部门最近来了几位新同事,部门主管为了欢迎新同事的加入,以能让新同事融入到新环境,提议下班后聚个餐,对于聚餐了,大伙对此举双手赞成,毕竟能蹭个免费餐的事并不是每月都有的,这时便可以说,大家对下班后聚餐迎新达成了一致认同。共识机制是一整套由协议、激励和想法构成的体系,使得整个网络的节点能够就区块链状态达成一致。我们知道,区块链是一个分布式的去中心化

个人博客地址秋码记录一、docker安装1、卸载旧版本docker当然在首次安装docker时,不需要执行以下的内容sudo apt-get remove docker docker-engine docker.io2、更新系统软件sudo apt-get update3、安装依赖包sudo apt-get install \apt-transport-https \ca-certificates