简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

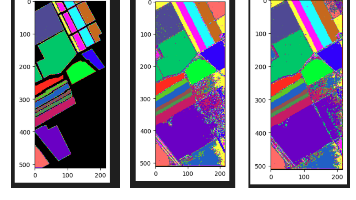

本文摘要: 本文实现了一个基于2D-CNN的高光谱图像分类模型,针对Salinas数据集进行农作物分类。主要流程包括:1)环境配置与随机种子固定;2)GPU选择与显存优化;3)数据加载与预处理,包括PCA降维至30维;4)3×3光谱-空间patch生成;5)数据划分与类别平衡处理;6)构建包含Conv-BN-MP层的CNN模型;7)训练评估与整图预测可视化。创新点在于采用PCA降维降低数据维度,通

由于要用到trtexec,而trtexec在/usr/src/tensorrt/bin目录下,每次执行,需要cd到该目录下执行下面的代码,这样有点麻烦,可以创建软链接放到要执行指令的目录下即可。yolov8/yolov11 bb如何转出多 batch 的模型, 以及修改onnx模型输出维度.但是这样的维度不⽅便用Tensorrt进行本地代码部署和解析。(找到对应的代码, 大约在409行左右, 注释

大多数目标检测方法使用边界框来编码和表示物体形状和位置,本论文中使用高斯分布对物体区域进行模糊表示,还提出了一种基于Hellinger距离的相似性度量,称为概率交并比(ProbIoU),可以视为一种概率形式的IoU。实验结果表明,所提出的高斯表示与公开可用数据集中的标注分割掩码更为接近,且基于ProbIoU的损失函数可以成功用于回归高斯表示的参数。此外,本论文提出了一个从传统(或旋转的)边界框到高

如果已经安装了NVIDIA驱动版本,先卸载旧驱动,再安装新CUDA对应的驱动,如果没有安装过NVIDIA驱动版本,可以直接安装新CUDA版本,它会自动安装对应的NVIDIA驱动。(2)执行nvidia-smi命令,显示是cuda的版本号(每个cuda版本对应了不同驱动版本),提供有关系统中NVIDIA GPU的实时状态信息。一个带显卡的环境系统能安装多个CUDA版本,但不能安装多个NVIDIA驱动

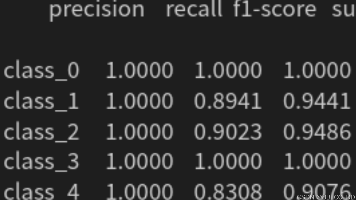

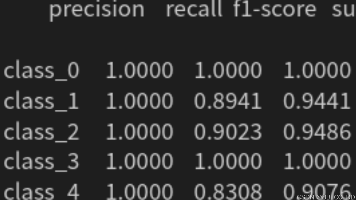

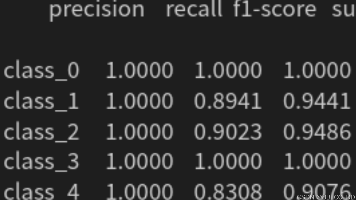

本文针对高光谱图像分类算法进行了三项主要优化:1)改进了数据集加载方式,采用批量加载并按类别组织数据,同时统一生成3×3×30的patch作为输入;2)优化了网络结构,移除了MaxPooling和GlobalAveragePooling层以减少空间信息损失,并简化了模型深度;3)在训练过程中加入了早停机制和模型保存功能以防止过拟合。实验结果表明,这些优化有效提升了分类精度,训练准确率达到98.33

本文针对高光谱图像分类算法进行了三项主要优化:1)改进了数据集加载方式,采用批量加载并按类别组织数据,同时统一生成3×3×30的patch作为输入;2)优化了网络结构,移除了MaxPooling和GlobalAveragePooling层以减少空间信息损失,并简化了模型深度;3)在训练过程中加入了早停机制和模型保存功能以防止过拟合。实验结果表明,这些优化有效提升了分类精度,训练准确率达到98.33

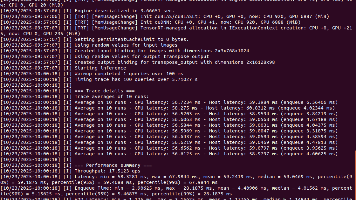

int8 --fp16: 启用INT8(8位整数)和–fp16量化精度, 对不支持量化的层默认转fp16. 如果模型finetune时, 全部层都做了int8量化, 那么只需要–int8即可;–workspace=4096 : 转engine模型用到, 模型小可以设置1024, 但如果模型大, 要设置大一些, 例如2048, 4096, 8192等,但不能大于GPU显存大小.可以自行设置, 例如设

量化感知训练(QAT)是一种先进技术,它弥合了高精度浮点模型与适用于资源受限硬件部署的高效低精度整数模型之间的差距。在原先检测模型背景下,QAT使模型能够保持其检测精度,同时通过TensorRT优化显著提高推理性能。量化是将模型权重和激活值从高精度(通常是32位浮点)转换为低精度(如8位整数)的过程。减少内存占用:INT8模型所需的内存比FP32模型少约4倍更快推理:在大多数硬件上,整数运算的计算

本文针对高光谱图像分类算法进行了三项主要优化:1)改进了数据集加载方式,采用批量加载并按类别组织数据,同时统一生成3×3×30的patch作为输入;2)优化了网络结构,移除了MaxPooling和GlobalAveragePooling层以减少空间信息损失,并简化了模型深度;3)在训练过程中加入了早停机制和模型保存功能以防止过拟合。实验结果表明,这些优化有效提升了分类精度,训练准确率达到98.33

如果已经安装了NVIDIA驱动版本,先卸载旧驱动,再安装新CUDA对应的驱动,如果没有安装过NVIDIA驱动版本,可以直接安装新CUDA版本,它会自动安装对应的NVIDIA驱动。(2)执行nvidia-smi命令,显示是cuda的版本号(每个cuda版本对应了不同驱动版本),提供有关系统中NVIDIA GPU的实时状态信息。一个带显卡的环境系统能安装多个CUDA版本,但不能安装多个NVIDIA驱动