简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

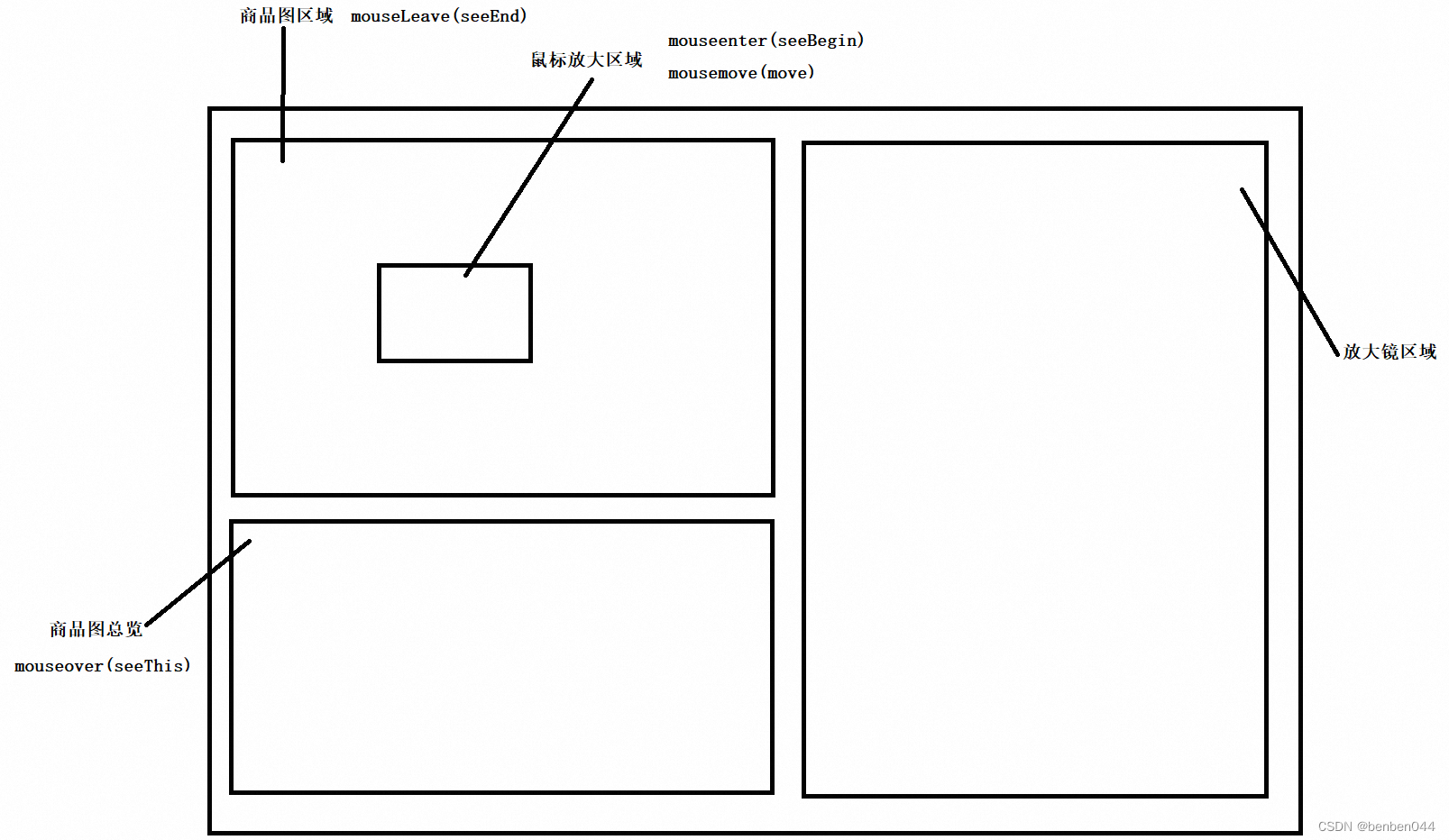

2)mousemove:鼠标移动时,鼠标的遮罩块区域跟着移动,同时放大镜区域的图片跟着切换(显示遮罩块的放大效果)(1)商品图区域:主要是浏览图片,根据图片的url显示图片。当鼠标离开此区域时"放大镜区域"不需要显示。放大镜区域其实放着一个大图,当鼠标在商品图区域移动时,放大镜区域的大图相向移动。1)mouseenter:鼠标进入时,放大镜区域根据url显示图片。(3)商品图总览:鼠标over时,

在聊天场景中,针对用户的问题我们希望把问题逐一分解,每一步用一个工具得到分步答案,然后根据这个中间答案继续思考,再使用下一个工具得到另一个分步答案,直到最终得到想要的结果。这个场景非常匹配langchain工具。在langchain中,我们定义好很多工具,每个工具对解决一类问题。然后针对用户的输入,langchain会不停的思考,最终得到想要的答案。

DoTween是一款对象动画类插件,它是一款针对Unity 3D编辑器的、快速高效的、安全的、面向对象的补间动画引擎,并且对C#语言开发做出了很多的优化。另外,它使得开发者无需通过Unity内置的Animator或Coroutines即可创建流畅、灵活的动画效果。

京东agent之JoyAgent解读

第三步,编辑etc下的redis-stack-service.conf文件。第二步,redis安装包解压缩。

根据地面属性(diggable, canDropItem, canPlaceFurniture, isPath, isNPCObstacle)决定角色进行何种操作。比如没有canDropItem属性的地面,则不能放置物体。

摘要:本文系统介绍了目标检测中的关键评估指标。首先解析混淆矩阵中的TP、FP、FN、TN概念及其实际含义;其次阐述准确率(衡量预测正样本的准确性)和召回率(衡量检出真实正样本的完整性)的计算方法;然后详细说明IoU(交并比)的定义及其对TP/FP判定的影响机制,包括定位和类别的双重考核标准;最后对比mAP50(IoU阈值为0.5)和mAP50-95(IoU阈值0.5-0.95范围平均)两个指标的区

摘要:OpenAI Triton是一种开源的类Python编程语言和编译器,专为GPU并行计算设计。其核心概念Program相当于CUDA中的线程块,自动处理线程调度和并行化。Triton提供高效的内存访问优化、边界检查机制和JIT即时编译功能,支持TMA硬件加速和持久化内核设计。关键特性包括:1)基于Block粒度的编程模型;2)自动并行化处理;3)L1/L2缓存优化;4)TMA硬件加速数据传输

(1)通过SocketTask = wx.connectSocket创建连接。3、测试发现,websocket性能有问题,有时候几个字的返回要卡半分钟。(4)通过SocketTask.onMessage接收对方发送的消息。(3)通过SocketTask.send发送消息,这个是异步的。(2)通过SocketTask.onOpen打开连接。

Unity3d中制作触发区域为圆形的按钮的方法说明