简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

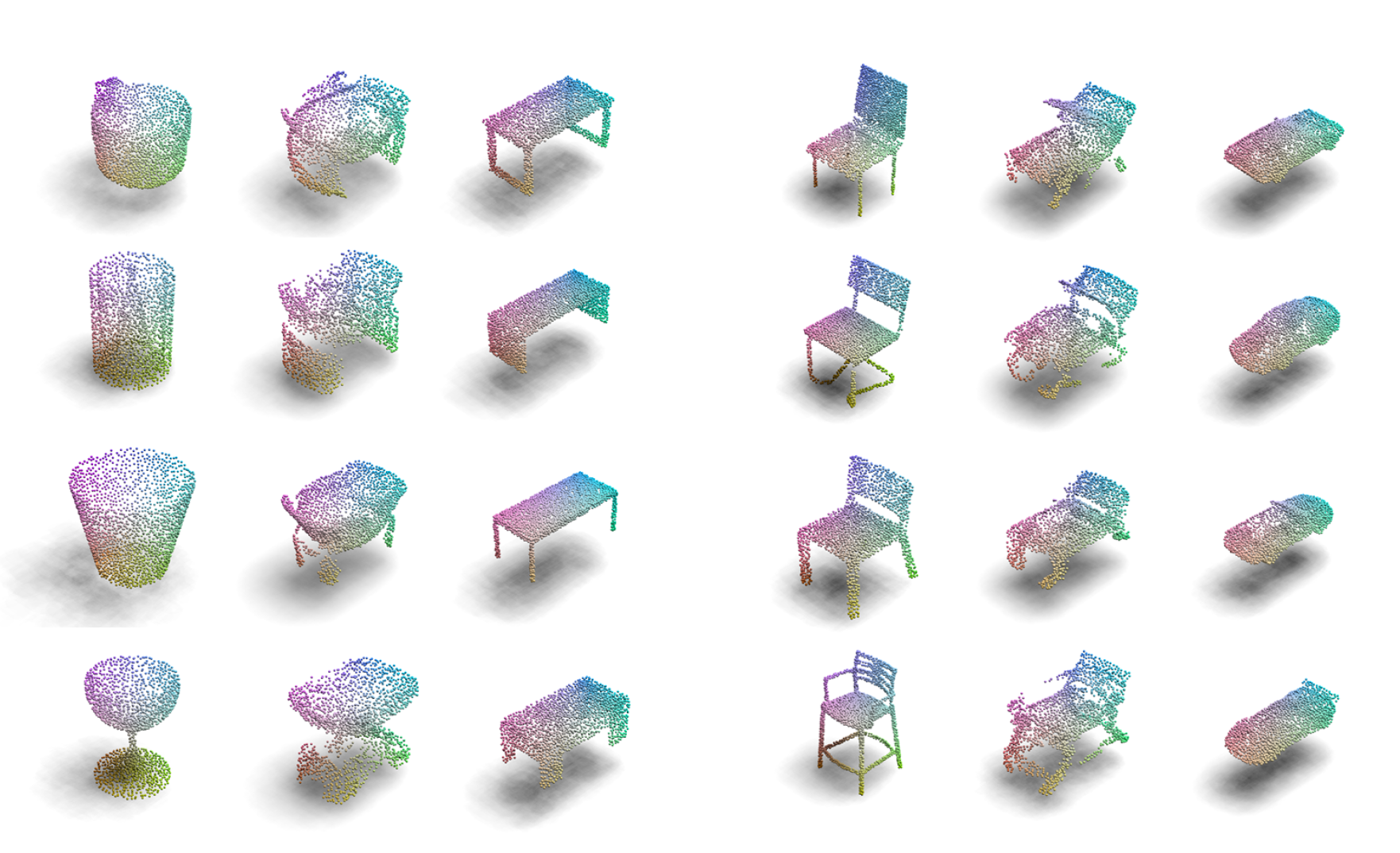

点云数据本身的数据规模存在极大的限制,目前主流的ModelNet40也就40个类别,就算组合了shapeNet,其数据量远远不能覆盖实际的样本空间,使得模型的泛化性收到了极大的限制。另外,由于点云属于三维数据,其表示形式自然要比文本和图像复杂,受到坐标系的限制会更大,对于姿态,尺度等更加敏感。这使得对于点云建立特征学习模型变得尤其困难。因此,面向点云的数据增强研究被提出。

本文详细介绍了在Ubuntu 24.04系统下配置深度学习开发环境的完整流程。主要内容包括:1)正确安装Anaconda的注意事项;2)通过官方deb网络方式安装CUDA 12.8及其环境配置;3)创建Conda虚拟环境并安装CUDA运行时;4)安装支持CUDA 12.8的PyTorch;5)PyCharm集成Conda环境的方法;6)环境验证步骤及常见问题解决方案。该配置方案适用于科研和工程开发

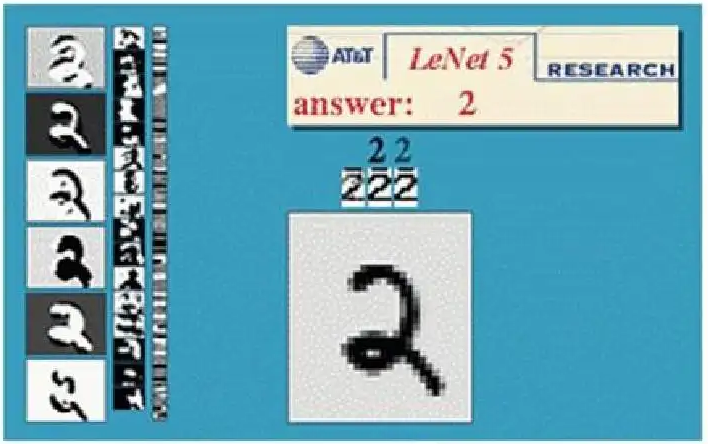

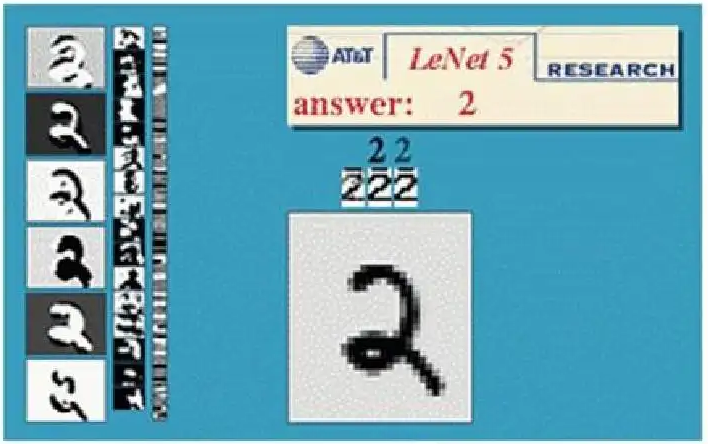

学习深度学习已经有小一年的时间,看了很多视频和书本内容,学习了很多代码,可始终感觉认知不够扎实。结合李沐老师的视频课程,我决定在本博客中介绍下复现LeNet的过程。代码基于Pycharm2021平台,选用python3.8版本+Pytorch1.12.1+cu116。基本上把各个包的版本都刷到最新版本,以方便后续的网络升级和向后兼容。

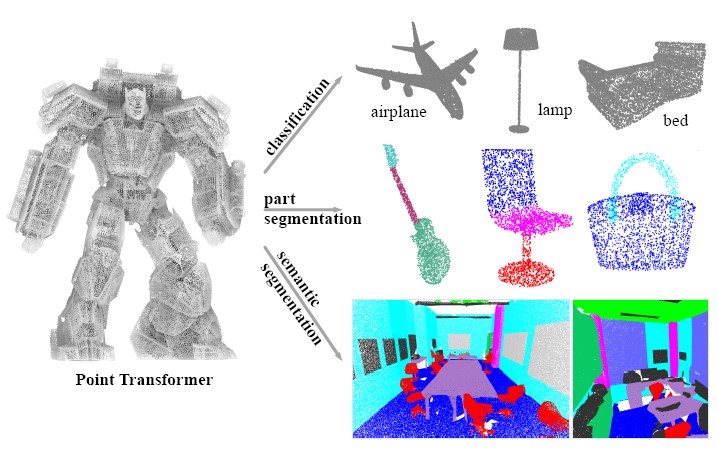

基于注意力机制的深度学习模型在起初设计时,针对的是NLP问题。包括词元分析,翻译等语言处理任务,注意力机制能够训练超大规模数据,并建立学习模型,获得显著的性能提升。鉴于注意力机制在NLP任务中的空前成功,视觉领域也尝试引入注意力机制,著名工作包括VIT [1] 和Swin Transformer [2]。对于点云数据处理,一些基于Transformer模型 [3][4] 的工作也被提出。本文以文献

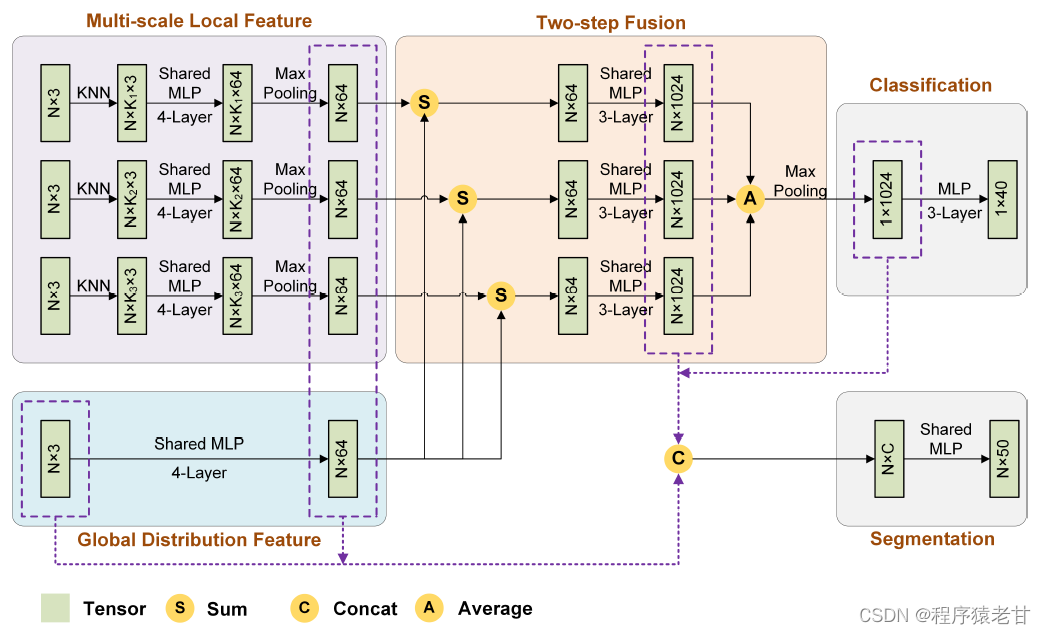

最近做深度学习研究,发现在视觉任务中,使用多尺度特征建立对图像的特征描述,大概率能够得到好的结果。自然地,如果能把多尺度特征推广到点云分析的任务中,直观感觉应该也能够获得性能提升。正好最近researchgate推给我一篇论文[1],就是基于该想法提出了一个网络实现。今天就来跟大家一起学习下这篇文章,看一看如何利用多尺度特征提升点云分析任务的性能。...

随着Transformer模型在NLP,CV甚至CG领域的流行,注意力机制(Attention Mechanism)被越来越多的学者所注意,将其引入各种深度学习任务中,以提升性能。清华大学胡世民教授团队近期发表在CVM上的Attention综述 [1],详细介绍了该领域相关研究的进展。对于点云应用,引入注意力机制,设计新的深度学习模型,自然是一个研究热点。本文以注意力机制为对象,概述其发展脉络,以

随着Transformer模型在NLP,CV甚至CG领域的流行,注意力机制(Attention Mechanism)被越来越多的学者所注意,将其引入各种深度学习任务中,以提升性能。清华大学胡世民教授团队近期发表在CVM上的Attention综述 [1],详细介绍了该领域相关研究的进展。对于点云应用,引入注意力机制,设计新的深度学习模型,自然是一个研究热点。本文以注意力机制为对象,概述其发展脉络,以

最近在b站看李沐老师的深度学习课程,受益颇多。不过觉得光看视频实在是不过瘾,最好还是能实际的玩起来。鉴于我还是习惯使用pycharm,且不需要过多的中间过程展示,所以代码的编写基本都是在pycharm进行。由于李沐老师的代码主要是在Jupyter运行的,在pycharm上使用会略有差异。本篇博客以求解线性优化问题代码为例,来谈一谈在pycharm运行相关代码的一些注意事项。

本文详细介绍了在Ubuntu 24.04系统下配置深度学习开发环境的完整流程。主要内容包括:1)正确安装Anaconda的注意事项;2)通过官方deb网络方式安装CUDA 12.8及其环境配置;3)创建Conda虚拟环境并安装CUDA运行时;4)安装支持CUDA 12.8的PyTorch;5)PyCharm集成Conda环境的方法;6)环境验证步骤及常见问题解决方案。该配置方案适用于科研和工程开发

学习深度学习已经有小一年的时间,看了很多视频和书本内容,学习了很多代码,可始终感觉认知不够扎实。结合李沐老师的视频课程,我决定在本博客中介绍下复现LeNet的过程。代码基于Pycharm2021平台,选用python3.8版本+Pytorch1.12.1+cu116。基本上把各个包的版本都刷到最新版本,以方便后续的网络升级和向后兼容。