简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Ollama是一款用于本地安装和管理大规模预训练语言模型的工具。它简化了模型的下载、安装和使用流程,支持多种流行的模型如GPT-4和llama。

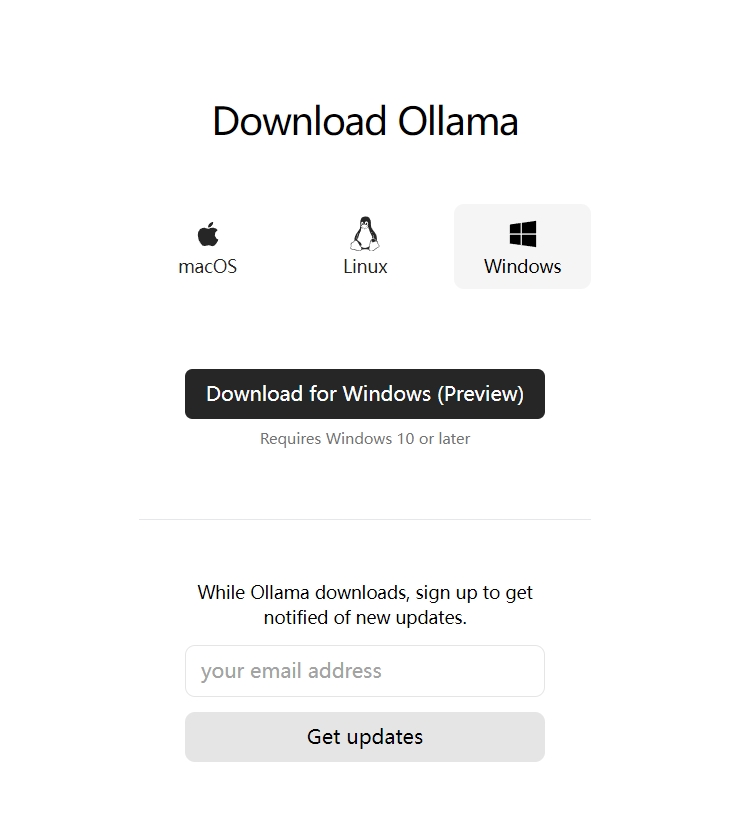

Ollama (https://ollama.com/) 是一款命令行工具,可在 macOS 、 Linux 、Windows 上本地运行 Llama 2、Code Llama 、Gemma 等模型。

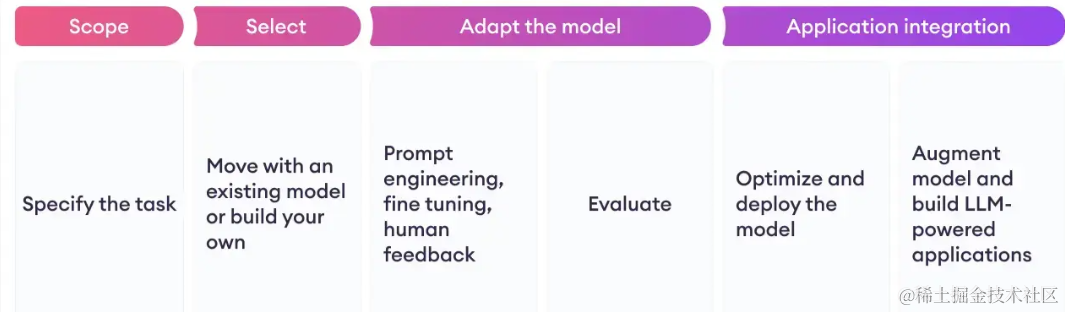

LLaMA-Factory 是一个国内北航开源的低代码大模型训练框架,专为大型语言模型(LLMs)的微调而设计

大模型现在超级火热,Deepseek开出的工资高达11w*14薪,如果大家想要抓住这个风口,可以学习一下大模型。

知识库问答是一种应用广泛的系统,可以在许多领域发挥重要作用。不过以往的系统通常是基于固定规则、相似度检索或者seq2seq模型,这类系统开发成本较高、修改也较为麻烦,尤其在数据准备过程需要耗费大量精力。

2024带你深入了解 大语言模型(LLM)微调方法(总结)

本文介绍了在 Windows 上快速运行本地 AI 大语言模型 - Llama3 的实战步骤, 通过利用: WSL + WasmEdge + LlamaEdge 快速实现.,易上手, 门槛低.

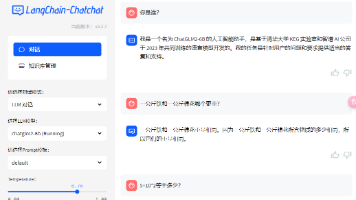

langchain-chatchat是一个基于 ChatGLM 等大语言模型与 Langchain 等应用框架实现,开源、可离线部署的检索增强生成(RAG)大模型知识库项目,采用Apache License,可以免费商用。

本文将详细介绍如何通过 Ollama 在本地环境中部署 DeepSeek-R1 模型,帮助用户满足数据隐私、定制化需求或离线使用的场景。

本文将带领您了解如何迅速在Windows平台上部署Ollama,这是一个开源的大语言模型(LLM)运行工具,以及如何通过Open WebUI和cpolar内网穿透技术,让您在任何地方都能访问您本地部署的AI语言模型,如llama2和千文qwen。