简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文深入讲解了LangGraph中的持久化能力,分为线程级和跨会话持久化两大类型。线程级持久化通过Thread和Checkpoint机制实现单次会话内的状态保存与恢复,支持断点续跑和流程回滚。文章详细介绍了检查点的生成时机、数据结构及使用方法,包括内存存储和PostgreSQL数据库存储的配置方式,并演示了状态快照获取、历史记录查询、流程重放和状态更新等核心操作。这些功能为AI系统提供了稳定的记忆

本文探讨了LangGraph框架中跨会话持久化的实现方法。首先分析了线程级持久化的局限性,即仅能维持单次对话记忆,无法实现跨会话信息共享。随后提出解决方案:引入Store全局存储机制,与Checkpoint配合使用,形成完整的记忆体系。文章详细介绍了两种Store实现方式:内存存储(InMemoryStore)和PostgreSQL数据库存储,并演示了如何通过命名空间组织数据、使用put/stor

本文深入讲解了LangGraph中的持久化能力,分为线程级和跨会话持久化两大类型。线程级持久化通过Thread和Checkpoint机制实现单次会话内的状态保存与恢复,支持断点续跑和流程回滚。文章详细介绍了检查点的生成时机、数据结构及使用方法,包括内存存储和PostgreSQL数据库存储的配置方式,并演示了状态快照获取、历史记录查询、流程重放和状态更新等核心操作。这些功能为AI系统提供了稳定的记忆

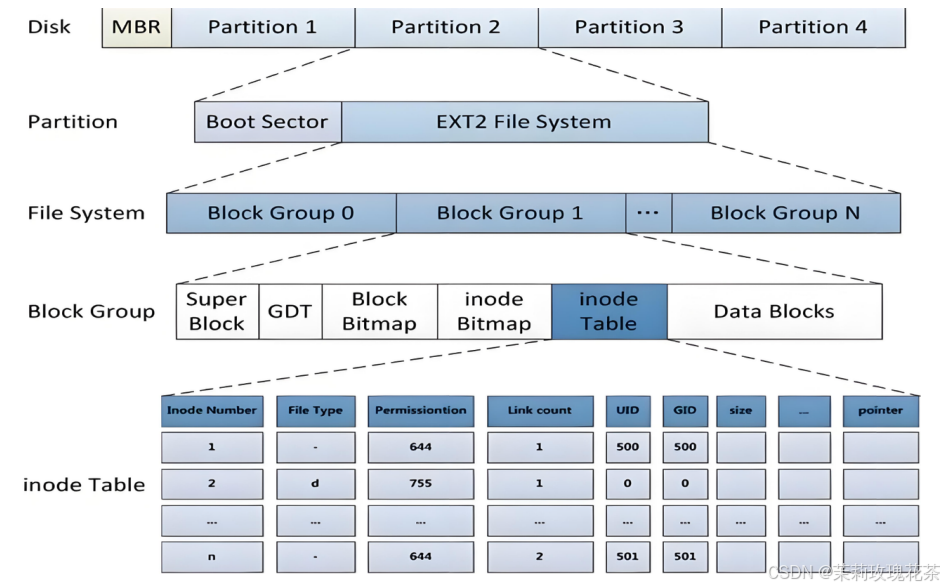

我们之前说过,文件=内容+属性,这是我们从一个文件得视角去谈的,而系统当中存在成百上千的文件,在系统层面上,文件也就被打开了一小部分,操作是将那么多的文件是进行怎么样的管理呢?更重要的是,我们之前fopen()打开文件的时候,为什么我们的系统就能够准确的把我们想要打开的文件打开,并且可以在系统层面上将文件信息加载到内存?怎么可以做到如此精准?被打开的文件是在内存当中的,因为操作系统要管理他,如果文

这些图描述了在Linux操作系统中,文件从进程打开到挂载在文件系统上的整个流程。首先,每个进程(如进程A和进程B)都有一个结构,其中包含一个结构,用于跟踪该进程打开的所有文件。每个打开的文件由file结构表示,该结构包含文件描述符、文件状态信息以及指向inode和dentry的指针。inode结构代表硬盘文件系统上的索引节点,包含文件的元数据,如权限、所有者、大小和时间戳等。dentry(目录项)

协调者-工作者模式是一种处理复杂任务的动态工作模式。该模式包含三个核心角色:协调者负责接收整体任务并动态拆分子任务;工作者从备选池中被选中执行具体子任务;合成器汇总所有工作成果。与并行化模式不同,协调者-工作者模式在运行时才确定任务数量和分配方式,具有高度灵活性。通过代码示例展示了该模式的实现过程:协调者使用大模型拆分"中国近代史"写作任务,动态分配给多个工作者并行处理章节内容

本文介绍了RabbitMQ在C++高并发后端开发中的应用,重点讲解了AMQP协议和AMQP-CPP库的使用。主要内容包括: RabbitMQ概述:作为支持原生C++客户端的开源分布式消息队列,适用于服务解耦、异步通信、流量削峰等场景。 AMQP协议核心概念:包括Broker、Exchange、Queue等组件,以及四种交换机类型(Direct、Fanout、Topic、Headers)的工作原理。

原因是因为,我们今天在进行对应的输出的时候,虽然我们的标准输出和标准错误都指向同一个文件,但是当我们进行对应的重定向时,他的本质是把文件描述符1重定向到新文件log.txt,即把新打开的文件描述符对应内容的的地址拷贝到了1里面,这时候1指向的内容就是log.txt,可是2依旧指向标准错误,在重定向时,这也是我们后面要谈到的,其实struct file是我们操作系统内打开的文件,但是我们文件相关的一

本文介绍了基于LangGraph实现的智能代理式RAG(检索增强生成)系统。该系统通过将传统线性RAG升级为闭环架构,显著提升了系统的鲁棒性。核心设计包含四大节点:决策节点判断问题是否需要检索;检索节点执行文档查询;问题重写节点优化不匹配的查询;答案生成节点整合有效信息。系统通过两条条件边实现智能路由:一条判断是否需要检索,另一条评估检索结果相关性。相比传统RAG,该系统能有效处理无关查询,并通过

本文介绍了基于LangGraph框架构建支持搜索的智能代理系统的完整实现方案。该系统通过图示化工作流架构,实现了智能对话与工具调用的无缝集成,主要功能包括:1)基于LLM的智能对话能力;2)通过Tavily搜索工具获取实时信息;3)循环决策机制确保答案完整性。系统采用两个核心节点(LLM调用节点和工具执行节点)和状态管理机制,自动维护对话历史,简化了传统LangChain实现中繁琐的消息管理。文章