简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文系统分析了卷积神经网络第一层可被抽象为线性映射$\mathbf{Z} = \mathbf{WX}+\mathbf{b}$的理论依据。研究表明,卷积的线性性来源于空间局部加权和跨通道组合两个层次的结构叠加。从统计视角看,这种抽象在分析均值、方差等统计量传播时是合理的,因为Normalize等操作仅依赖于线性变换本身,而与具体实现结构无关。因此,在初始化、梯度稳定性等理论分析中,将卷积层视为带约束

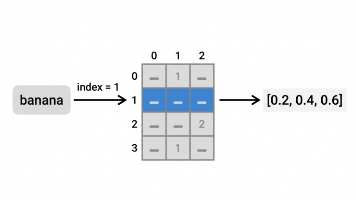

摘要:Embedding Lookup是NLP模型的基础操作,将离散词语转换为连续向量。通过词索引从embedding矩阵中查找对应向量(如"banana"索引1对应向量[0.2,0.4,0.6])。数学上可视为矩阵行索引操作,PyTorch中通过nn.Embedding实现批量查询。相比传统one-hot编码(需构造高维稀疏向量并矩阵乘法),Embedding Lookup直

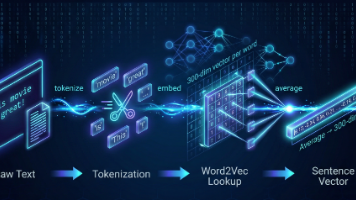

本文介绍了一个基于Word2Vec和逻辑回归的IMDB电影评论情感分类实战案例。通过NLTK进行文本预处理,使用Gensim训练Word2Vec模型生成词向量,采用词向量平均方法将句子转换为固定维度特征,最后用逻辑回归完成二分类任务。文章详细阐述了从数据加载、文本预处理、模型训练到特征构建的完整流程,特别适合NLP初学者理解文本特征工程与传统机器学习的结合应用。该方案在效果与成本之间取得平衡,是入

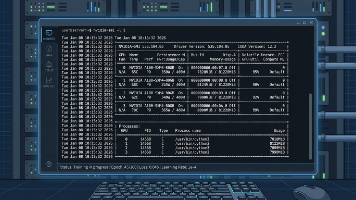

本文介绍了深度学习训练中GPU监控的工程级方案。从基础nvidia-smi命令出发,逐步优化为带时间戳、不清屏、可记录日志的实用监控方法,特别适合PyTorch+Docker环境。文章详细讲解了如何通过定时刷新、精简关键指标(GPU利用率和显存)、添加时间戳等方式实现有效监控,并指出容器环境中GPU编号易混淆的问题。最后总结了常见GPU异常现象的诊断经验,强调持续监控对发现训练瓶颈的重要性。通过简

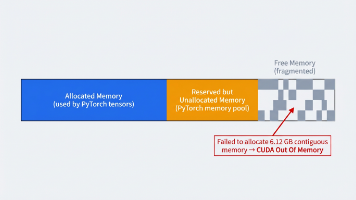

本文分析了深度学习训练中常见的CUDA显存不足问题,探讨了模型过大、批次过大、内存碎片化等关键原因。提出了多层次的优化解决方案:通过环境变量设置减少内存碎片;合理调整批次大小;为每个客户端创建独立模型副本避免内存累积;主动清理中间变量和缓存;使用torch.no_grad()避免不必要的梯度计算。这些方法可有效缓解显存不足问题,提高GPU利用率,尤其适用于联邦学习等需要多模型实例的场景。

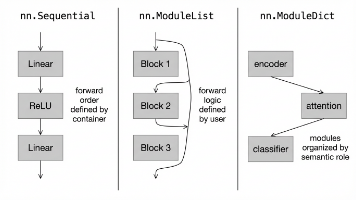

PyTorch提供了三种主要模块容器来组织神经网络结构:nn.Sequential、nn.ModuleList和nn.ModuleDict。nn.Sequential适用于固定顺序的线性结构,自动处理前向传播;nn.ModuleList仅存储模块顺序,需要手动定义forward逻辑,适合动态或复杂结构;nn.ModuleDict通过字典提供更灵活的模块访问。选择合适容器对编写清晰、可维护的模型代码

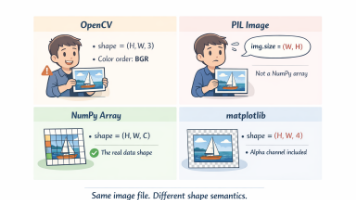

文章摘要: 本文探讨了计算机视觉中不同图像库读取图片shape的差异及常见问题。OpenCV默认输出BGR顺序且灰度图缺少通道维度;PIL的shape信息隐藏在NumPy转换后,其size属性与shape概念不同;matplotlib会保留PNG的alpha通道,导致通道数不符预期。这些差异容易引发模型输入错误,但往往被忽视。核心观点是:图像shape不是附带信息,而是数据的第一层语义,必须显式验

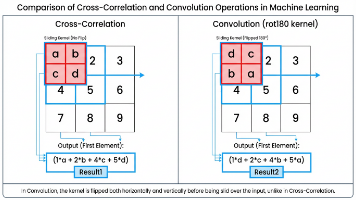

摘要:本文分析了卷积神经网络中互相关与卷积的数学区别。

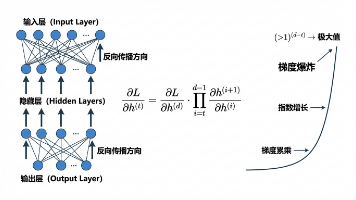

本文深入解析了深度学习中的梯度爆炸问题。梯度爆炸指反向传播时梯度值指数级增长,导致数值溢出和训练不稳定。其核心原因是深层网络梯度链式乘积中权重矩阵范数大于1时的累乘效应,尤其在ReLU激活函数下梯度路径筛选会放大该问题。数学推导和实验表明,即使初始梯度正常,连续矩阵相乘也会快速引发数值爆炸。梯度爆炸会导致浮点数溢出、参数更新失控等问题,严重影响模型训练。理解这一现象的成因有助于设计更稳定的网络结构

本文系统分析了卷积神经网络第一层可被抽象为线性映射$\mathbf{Z} = \mathbf{WX}+\mathbf{b}$的理论依据。研究表明,卷积的线性性来源于空间局部加权和跨通道组合两个层次的结构叠加。从统计视角看,这种抽象在分析均值、方差等统计量传播时是合理的,因为Normalize等操作仅依赖于线性变换本身,而与具体实现结构无关。因此,在初始化、梯度稳定性等理论分析中,将卷积层视为带约束