简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

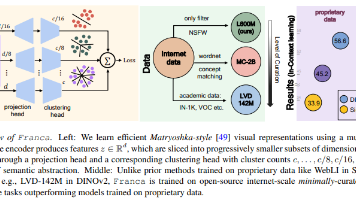

Franca模型通过创新的嵌套套娃聚类、循环掩码和绝对空间属性剥离技术实现了有效的视觉基础模型。该模型完全开源,使用公开数据集训练,在多项任务上超越DINOv2等主流模型。其核心创新包括:1)嵌套套娃聚类通过多粒度特征学习实现从宏观到微观的语义捕捉;2)循环掩码策略打破空间连续性,迫使模型深入理解语义;3)RASA技术分离空间位置与语义内容。这些设计使Franca 能获得更纯净的特征表示,有效解决

本文探讨了如何用信息论方法分析大语言模型(LLM)的内部表征,重点讨论了互信息与熵的估计难题。由于LLM隐藏状态是高维连续向量,传统网格划分方法面临维数灾难;。文章比较了K近邻估计、神经互信息估计和参数化密度估计等方法的优劣,最终引入软熵估计器作为工程折中方案。

文章目录训练数据优化器选择SGDRMSpropAdam回调函数选择模型保存-ModelCheckpointLearningRateScheduler评估标准选择数据集的划分划分比例fit实际建议训练数据https://www.yuque.com/lart/ml-newer/...

文章目录DenseNet(2017)核心: DenseBlock结构图结构分析ResNetDenseNet基本复合函数过渡层增长率瓶颈层(B标记)压缩(C标记)实现细节存在的问题: 梯度弥散解决的思路: 密集的快捷连接结构的其他优点: 参数效率/训练效率模型紧凑型隐性深度监督随机连接与确定连接特征重用DenseNet的不足Dense Connection 的显存占用大现有的工作: 连接模式/网络宽

文章目录FCN总结(2015)前言背景新意完全卷积网络(FCN)基本情况为什么CNN对像素级别的分类很难?如何将`全连接层`和`全卷积层`的相互转化?全连接层的权重W重塑成卷积层的滤波器有什么好处呢?怎么使反卷积的output大小和输入图片大小一致, 从而得到`pixel level prediction`?上采样(Upsampling)反卷积插值跳级(skip)结构构思其他人的工作Convnet

GoogLeNet(InceptionV1)(2014)文档存放更新地址:https://github.com/lartpang/ML_markdown文章书写匆忙,有些使用了网上其他朋友的文字以及图片,但是没有及时复制对应的链接,在此深表歉意,以及深深的感谢。如有朋友看到了对应的出处,或者作者发现,可以留言,小弟马上修改,添加引用。前言2014年,在google工作的Chris...

CNN、Transformer、ONN(Operational Neural Network)和KAN

早期的重要CNN架构: LeNet

文章目录Network-in-network(2013)论文概要新奇点MLP Convolution Layers(MLP卷积层)全局平均池化(GAP)层输出作为可信度构思细节训练细节训练结果架构代码Network-in-network(2013)文档存放更新地址:https://github.com/lartpang/ML_markdown文章书写匆忙,有些使用了网上其他朋友的文字以...