简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

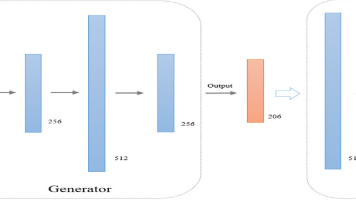

基于WGAN-GP的一维医学数据增强方法,解决医学AI面临的数据稀缺和不均衡问题。针对影像组学等一维医学数据,该方法通过改进的生成对抗网络生成高质量合成样本。实验在心脏病和放射性肺炎数据集上验证,相比SMOTE和普通GAN,WGAN-GP显著提升AUC和敏感性指标,尤其在小样本场景优势明显。可视化分析显示生成数据分布更接近真实样本。该研究首次将WGAN-GP应用于一维医学数据增强,为医疗AI数据瓶

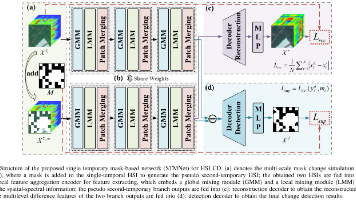

STMNet,一种基于单时相掩码的自监督高光谱变化检测网络,解决了传统方法依赖双时相配对数据和人工标注的瓶颈。通过多尺度掩码变化模拟策略(MMCS)生成伪第二时相图像,结合全局-局部特征聚合网络提取空谱特征,实现了无需标注的单时相自监督学习。在三个高光谱数据集上的实验表明,STMNet在精度上超越现有方法,Farmland数据集达到97.47%的总体精度。该工作首次在高光谱变化检测领域实现了完全无

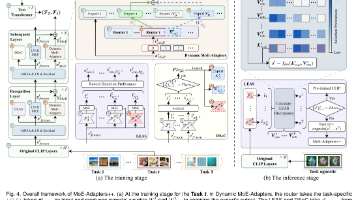

MoE-Adapters++框架,通过动态混合专家适配器实现视觉语言模型的高效持续学习。该方法采用参数高效的训练策略,在冻结CLIP模型基础上构建动态可扩展的专家集合,利用潜在嵌入自动选择器(LEAS)实现任务识别与零样本推理的无缝切换。相比原始MoE-Adapters,改进后的框架显著降低98%训练参数和70%GPU内存消耗,在11个任务的持续学习基准上取得77.5%平均准确率。实验表明,该方案

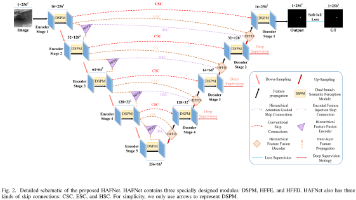

一种用于红外小目标检测的分层注意力融合网络HAFNet。针对现有U-Net方法在复杂场景下性能受限的问题,HAFNet设计了双分支语义感知模块(DSPM)作为特征提取主干,结合标准卷积和扩张卷积增强上下文语义交互。同时,通过层次特征融合编码器(HFFE)和层次特征融合解码器(HFFD)扩展了跳过连接,实现多尺度特征的有效融合。实验结果表明,HAFNet在NUAA-SIRST、IRSTD-1k和NU

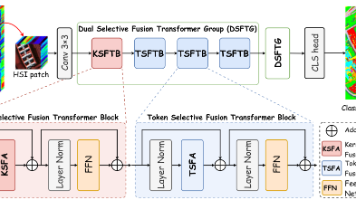

一种双选择融合Transformer网络(DSFormer)用于高光谱图像分类。针对现有Transformer模型在处理不同地物类型时感受野固定和自注意力机制存在冗余噪声的问题,DSFormer设计了核选择融合Transformer块(KSFTB)和Token选择性融合Transformer块(TSFTB)。KSFTB通过自适应融合多尺度特征来优化感受野,TSFTB则通过选择性关注最相关的Toke

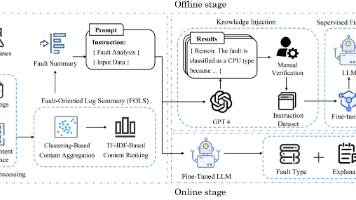

LogInsight框架,利用大语言模型实现准确且可解释的日志故障诊断。针对现有方法缺乏解释性和大语言模型直接应用的局限性,LogInsight通过三个创新点解决问题:(1)面向故障的日志摘要模块(FOLS)压缩冗余日志;(2)构建专业指令数据集(LFDInstruction)注入领域知识;(3)采用LoRA方法对Mistral-7B模型进行高效微调。实验表明,LogInsight在三个真实数据集

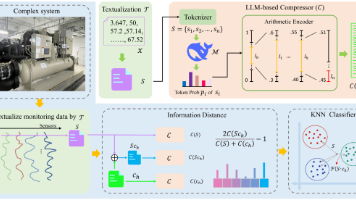

一种基于大语言模型(LLM)的类人单样本故障诊断方法。通过将传感器数据转化为语言表示并引入LLM的推理能力,结合算术编码构建信息距离度量,实现了仅需单样本即可完成准确诊断。实验在冷水机组系统上验证了该方法的有效性,达到了零误差的诊断精度。该方法突破了传统小样本学习需要多个样本的限制,为复杂工业系统的智能故障诊断提供了新思路,同时展示了LLM在工业领域的应用潜力。研究还揭示了模型规模与诊断性能的正相

小明(生成器)专门负责画假钞,他的目标是画得越来越像真钞,让人分辨不出真假小红(判别器)是个验钞专家,她的任务是识别哪些是真钞,哪些是假钞小明的造假技术越来越高超小红的识别能力也越来越强最终,小明能画出连小红都分辨不出的"假钞"这就是GANs的核心思想!两个神经网络在"对抗"中共同进步,最终生成器能产生以假乱真的数据。GANs为我们打开了一扇通向AI创造力的大门。从最初简单的手写数字生成,到今天能

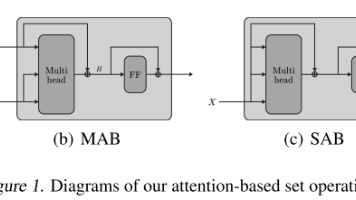

Set Transformer是一种基于注意力机制的置换不变神经网络框架,专为处理集合数据设计。该模型通过编码器-解码器结构,利用自注意力机制捕获集合元素间的交互关系,并通过创新的诱导点方法(ISAB)将计算复杂度从O(n²)降至O(nm)。实验表明,SetTransformer在聚类、异常检测和点云分类等任务中显著优于传统方法,尤其擅长建模复杂元素交互。该框架兼具理论保证(通用近似性和置换不变性

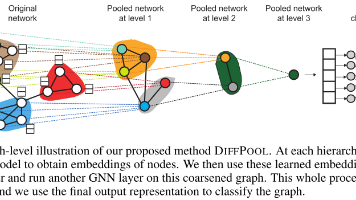

DIFFPOOL,一种可微的层次图池化方法,用于解决现有图神经网络(GNN)在图分类任务中缺乏层次表示能力的问题。DIFFPOOL通过双GNN架构学习软聚类分配矩阵,实现端到端的层次化图表示学习。实验表明,该方法在5个基准数据集上平均提升5-10%准确率,且计算效率优于现有池化方法。论文还深入分析了DIFFPOOL的自适应聚类特性、理论保证和实现细节,同时指出了训练稳定性等局限性。该工作为图神经网