简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

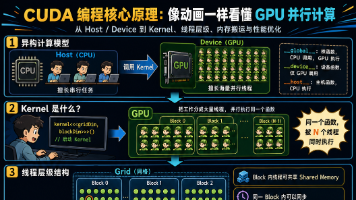

这篇文章是一份关于GPU编程优化的实战笔记,重点讲解了两个"Easy"但性能敏感的问题:分块矩阵乘法和矩阵转置。文章通过分析朴素写法的性能瓶颈,深入讲解了GPU执行模型和内存优化策略。 对于矩阵乘法,作者指出全局显存访问的带宽浪费问题,提出了分块(Tiling)优化方案:利用共享内存缓存数据块,减少全局内存访问。关键点包括:维度命名确认、线程网格划分、坐标计算和边界处理。 对于

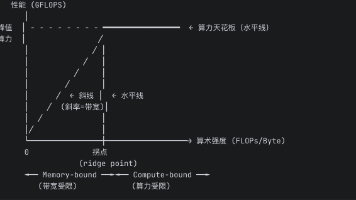

本文揭示了性能优化中的核心问题:瓶颈往往不在算力,而在数据搬运。通过两个典型案例(LayerNorm精度转换无效和GPU利用率低下)分析,指出优化前需先用Roofline模型区分算力受限(Compute-bound)和带宽受限(Memory-bound)场景。 对于带宽受限算子(如LayerNorm),优化重点应是减少数据搬运量,可采用FP16存储或算子融合;对于CPU-GPU传输瓶颈,关键要确保

摘要:AI大模型推动自动语音识别(ASR)技术革新,端到端模型突破传统级联架构局限。开源工具Wenet-e2e等提供工业级解决方案,全链路对话模型将延迟降至650ms。2025年全球语音市场预计超500亿美元,开发者可通过GitHub资源库入门,关注多模态融合和低延迟优化等趋势,把握语音AI时代机遇。

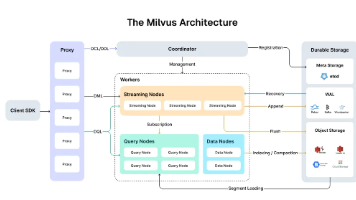

本文系统介绍了开源分布式向量数据库Milvus的核心架构与索引选型。Milvus采用分层解耦设计,包含Proxy接入层、Coordinator协调层、Workers执行层和DurableStorage存储层,支持弹性扩展。重点解析了FLAT、IVF_FLAT、IVF_SQ8、HNSW、SCANN和DISKANN六种索引类型的特点及适用场景,并对比了L2、IP和COSINE三种相似度量方式。作为RA

摘要:具身智能面临数据困境,当前行业投入大量资金采集的数据存在质量差、利用率低等问题。研究揭示了四种数据范式:网络视频缺乏动作标注,遥操作精度高但成本昂贵,仿真数据存在真实差距,第一视角数据兼具规模与精度优势。NVIDIA提出的"数据金字塔"框架表明,未来需要整合多种数据源形成互补生态。真正的价值不在于数据规模,而在于从海量数据中提取有效信息的"提纯能力"。

《云端架构演进实录:自动驾驶数据闭环平台实践》摘要 本文系统梳理了自动驾驶云端数据平台的架构演进历程,围绕数据闭环核心,从四大维度展开: 1)基础设施层:通过云原生、服务网格等技术构建高可靠底座; 2)数据流转层:运用湖仓一体、Kappa架构处理PB级数据洪峰; 3)AI智能层:探索大模型在场景挖掘与标注中的前沿应用; 4)效能平台层:借助自动化测试与智能运维保障系统健康。全文通过14个专题,完整

本文深入剖析了PyTorch中torch.add(a,b)调用的完整执行路径,揭示了其核心调度机制。PyTorch通过七层抽象完成调用,关键组件是Dispatcher系统,它基于TensorImpl中的DispatchKeySet(64位掩码)动态决定算子执行路径。文章详细讲解了:1)PyTorch的三层架构(c10/ATen/torch);2)Tensor作为轻量级手柄的设计;3)Dispatc

摘要:本文针对希望从PyTorch调参进阶到编写CUDA算子和部署模型的工程师,提供了一条基于RTX4090D显卡的完整实践路径。文章首先构建CUDA编程的核心心智模型,强调GPU作为吞吐优化设备的特性,并通过向量加法示例展示CUDA程序的完整生命周期。随后对比Triton、PyTorch扩展和纯NVCC三种工程化路径的适用场景,推荐Triton作为大多数场景的起点。核心部分以Swin-Tiny模

H100 一张卡的售价能买一辆轿车,一个千卡集群的电费一天就够普通人吃几年。可即便砸下这么多钱,绝大多数团队真正用上的算力,可能还不到硬件理论巅峰的30%。程序还在跑,损失还在降,监控里 GPU 利用率显示 100%——所有指标都告诉你一切正常,但你其实是在原地烧钱。这篇博客把分布式训练里最常见、也最隐蔽的四个坑摊开来讲清楚。每一个我都会用两层语言来解释:先是工程师视角的硬核原理,再用一个生活化的

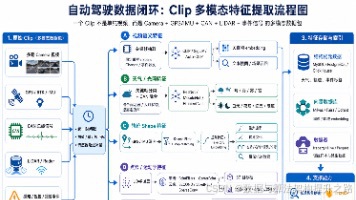

自动驾驶数据闭环中的Clip特征提取,本质是构建多模态数据的索引系统。一个Clip并非单一视频,而是包含摄像头、LiDAR、GPS等多元信息的综合数据包。特征提取流程需先对齐时间窗口,再分别提取语义、运动、环境等特征。关键环节包括:关键帧抽取、天气识别、轨迹编码、点云分析等。工程落地需注意时间同步、模型选型和版本管理,最终形成结构化标签+向量索引的数据资产。这种处理方式将海量路测数据转化为可检索、