简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

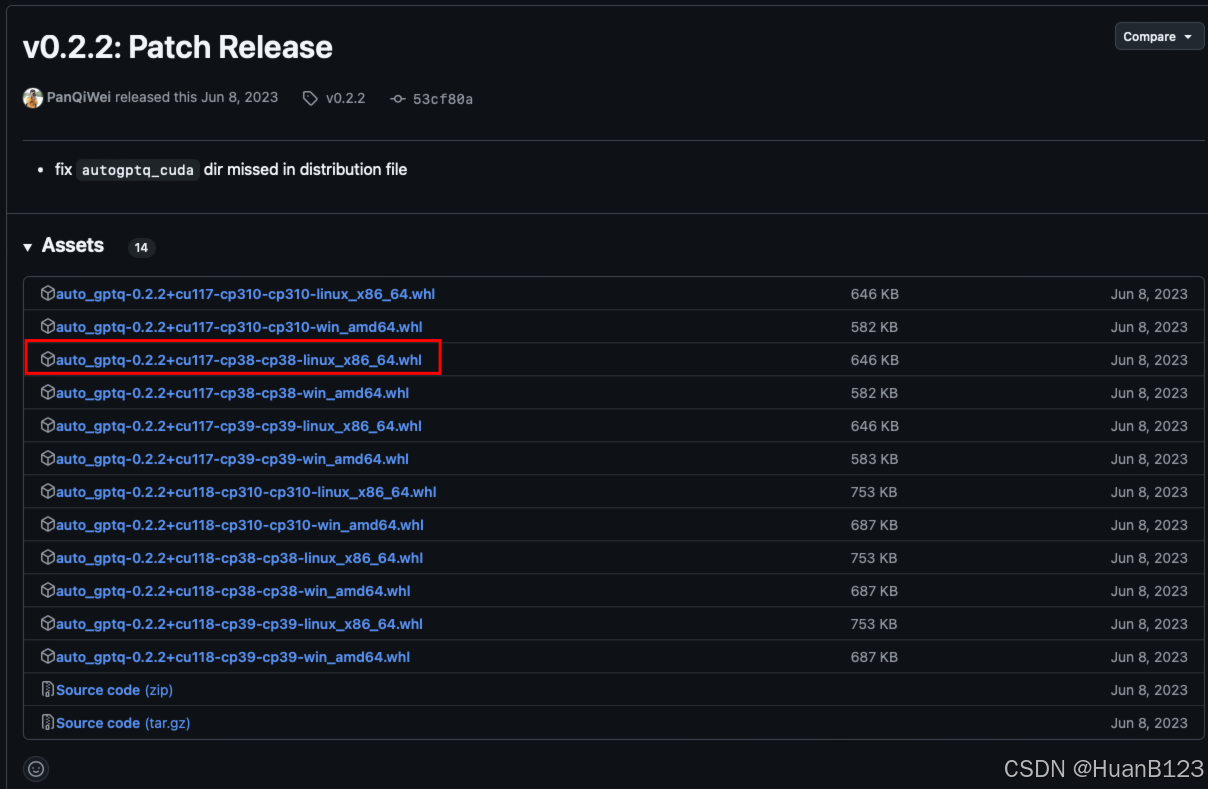

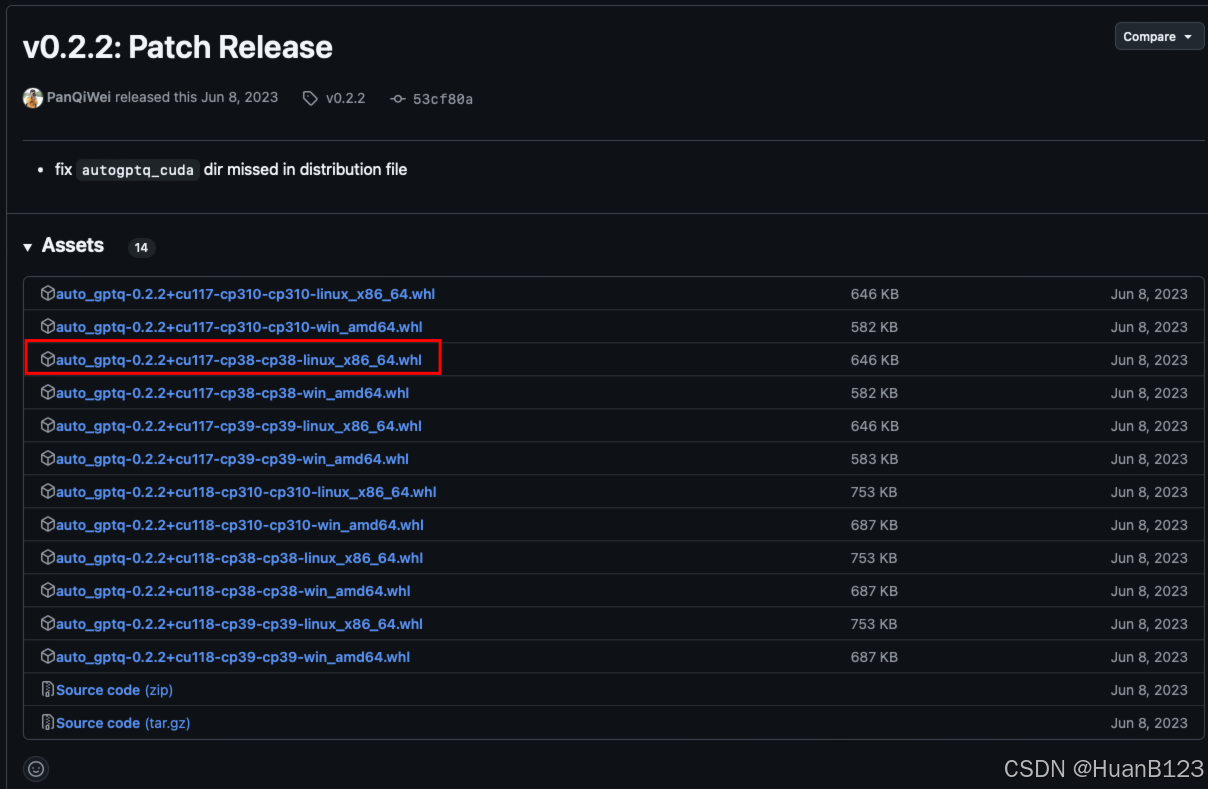

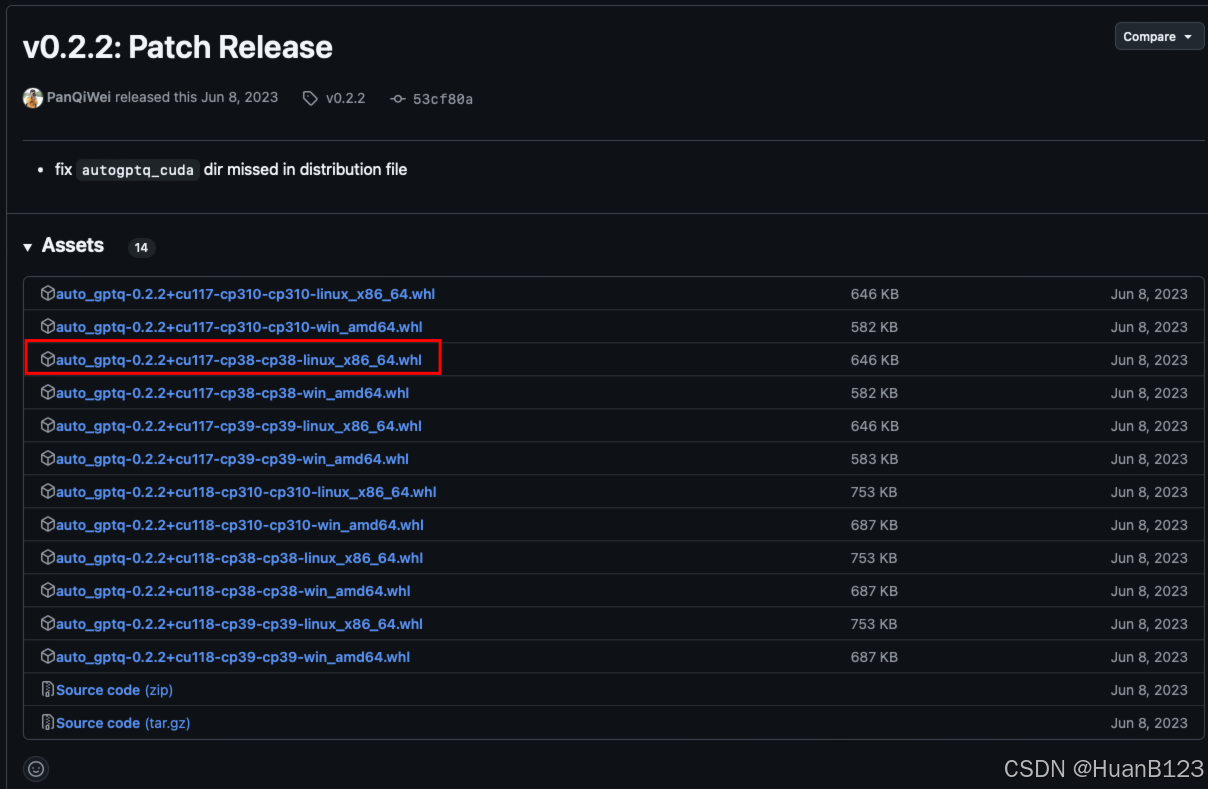

针对大语言模型推理性能优化的研究取得了巨大的进展,如今我们不仅能够在高端显卡上完成大语言模型的推理,甚至在 CPU 和边缘设备上都可以轻松运行大语言模型。在此记录我配置大模型量化的代码AutoGPTQ的过程中出现的问题和解决方案。选择合适自己的python、系统、和cuda版本的wheel文件,在这里我选择的第三个,因为我的是cu117。大家也可以根据图示命令查看自己虚拟环境中的cuda版本,选择

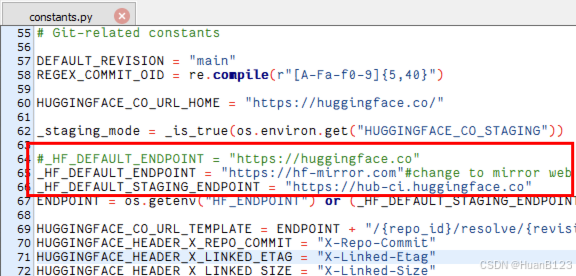

在跑大模型相关的代码时,经常会遇到从hugging face中加载预训练模型失败的情况,下面记录一下解决的方法。打开后找到constants.py文件,并做以下修改,替换为镜像网站。

本文探讨了如何修改run_glue.py代码以支持Qwen2.5-14B模型在GLUE基准测试上进行LoRA微调。关键修改包括:1)在模型加载后通过peft工具包注入LoRA配置,指定目标模块为"q_proj"和"v_proj";2)提供完整的运行脚本示例,包括8GPU并行训练设置和关键超参数配置;3)展示完整的代码实现,涵盖数据处理、模型训练和评估流程。该

针对大语言模型推理性能优化的研究取得了巨大的进展,如今我们不仅能够在高端显卡上完成大语言模型的推理,甚至在 CPU 和边缘设备上都可以轻松运行大语言模型。在此记录我配置大模型量化的代码AutoGPTQ的过程中出现的问题和解决方案。选择合适自己的python、系统、和cuda版本的wheel文件,在这里我选择的第三个,因为我的是cu117。大家也可以根据图示命令查看自己虚拟环境中的cuda版本,选择

针对大语言模型推理性能优化的研究取得了巨大的进展,如今我们不仅能够在高端显卡上完成大语言模型的推理,甚至在 CPU 和边缘设备上都可以轻松运行大语言模型。在此记录我配置大模型量化的代码AutoGPTQ的过程中出现的问题和解决方案。选择合适自己的python、系统、和cuda版本的wheel文件,在这里我选择的第三个,因为我的是cu117。大家也可以根据图示命令查看自己虚拟环境中的cuda版本,选择

【代码】图片生成文字描述BLIP2模型复现代码。

问题描述:24点游戏是经典的纸牌益智游戏。常见游戏规则:从扑克中每次取出4张牌。使用加减乘除,第一个能得出24者为赢。(其中,J代表11,Q代表12,K代表13,A代表1),按照要求编程解决24点游戏。基本要求: 随机生成4个代表扑克牌牌面的数字字母,程序自动列出所有可能算出24的表达式,用擅长的语言(C/C++/Java或其他均可)实现程序解决问题。1.程序风格良好(使用自定义注释模板)2.列出