简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

社会上还暂未出现大批鸿蒙开发人员,大家几乎都是同一起跑线,如果你还没有掌握鸿蒙,现在想要在最短的时间里吃透它,可以参考一下这份《鸿蒙开发学习指南》,里面内容包含了:配置,资源分类,ArkTs,ArkUI,应用模型,web开发,UI开发……随着鸿蒙系统在各领域的广泛应用,将产生大量的开发岗位,掌握鸿蒙开发技能的程序员将成为市场上的抢手人才。由于鸿蒙系统构建了丰富的技术体系,其底层接口尚未完全开发利用

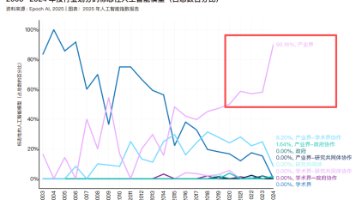

斯坦福李飞飞团队《2025人工智能指数报告》显示,产业界主导AI研发,中美成为主要竞争者。大模型性能快速提升,在语言理解、视觉推理等领域已超越人类基准。全球AI投资迅猛增长,但缺乏统一的AI安全标准。AI正成为全球通识教育,公众态度因地区而异。报告为AI从业者提供全景视角,把握技术前沿与市场趋势。

文章系统规划了成为智能体AI专家的六步学习路径:从理解大语言模型核心原理,通过无代码平台快速入门,到学习基础与前沿模型拓展技术视野,再到掌握Python/SQL工程化技能和API/Web框架实现外部交互。强调"先核心、再扩展、后落地"的学习逻辑,帮助小白和程序员循序渐进构建知识体系,为2025年成为智能体AI专家奠定基础。想在2025年跻身“智能体AI专家”?这次拆解了从大模型基础到实战开发的完整

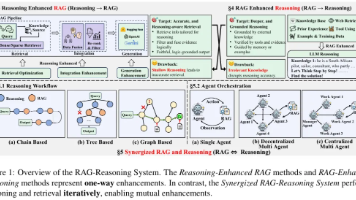

本文系统探讨了检索-推理系统在大语言模型中的应用,针对知识幻觉与推理不足两大瓶颈,详细分析了推理增强型RAG、RAG增强型推理及协同检索-推理框架三种方法。文章阐述了检索优化、整合优化、生成优化等关键技术路线,以及推理工作流和智能体编排两大协同范式,并对推理效率、检索效率、人机协作等挑战与未来发展方向进行了展望,为构建高效可信的大模型系统提供了重要参考。大语言模型虽然具备强大的生成能力,但仍受困于

传统搜索更多依赖关键词匹配,比如“AI”和“人工智能”在字面上差距很大,结果往往无法对应。但 Embedding 不一样,它会把语义信息映射到向量空间,把“AI”和“人工智能”放得很近,从而实现语义级别的检索。文本经过模型编码,得到一个固定维度的向量;数据库里的候选内容也被转换成向量;系统计算“查询向量”和“候选向量”之间的相似度(常用方法有余弦相似度、欧氏距离等);最终按照相似度得分进行排序,相

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

文章研究了通过“链式推理”增强模型蒸馏,发现将推理链附加在目标标签后能显著提升小型模型性能,即使推理链不连贯或仅使用少量关键词汇。论文题目: Investigating Mysteries of CoT-Augmented Distillation论文链接: https://arxiv.org/abs/2406.14511AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

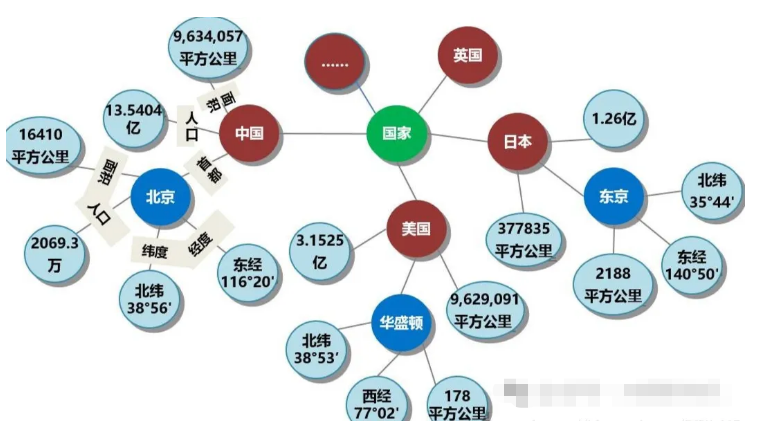

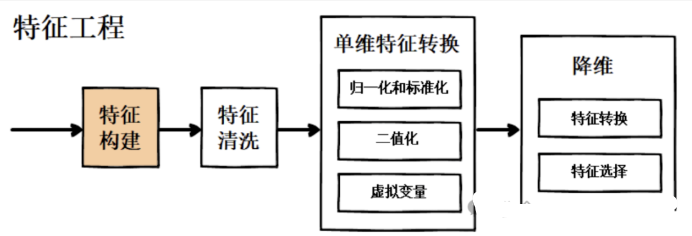

特征提取是机器学习模型中的重要前置环境,特征提取的效果直接影响到模型的性能在学习大模型技术的过程中,每个人应该都听过特征提取;但大部分人可能并不了解什么是特征提取,以及特征提取的方法和作用。所以,今天我们就来介绍一下大模型的前置处理——特征提取。。

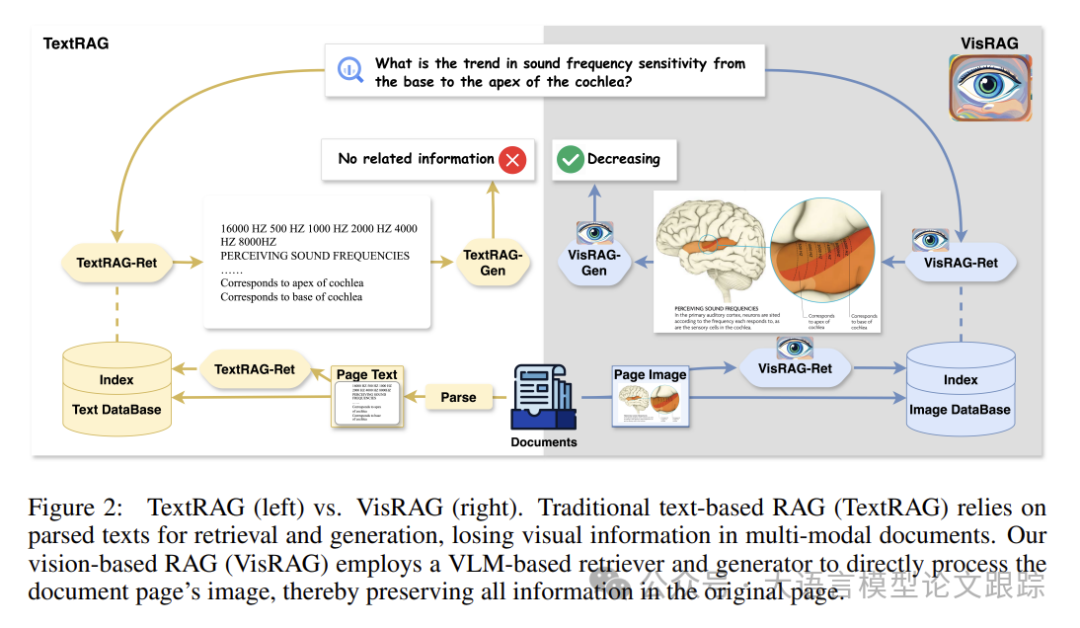

VisRAG是一种新型视觉检索增强生成系统,由VLM驱动的检索器VisRAG-Ret和生成器VisRAG-Gen组成。如上图(左边)所示,TextRAG 通常使用基于文本的单元进行检索和生成。右边是 VisRAG,与传统RAG框架利用文本片段进行检索和生成不同,VisRAG通过文档图像来保留全部信息,确保数据的完整性。AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量