简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

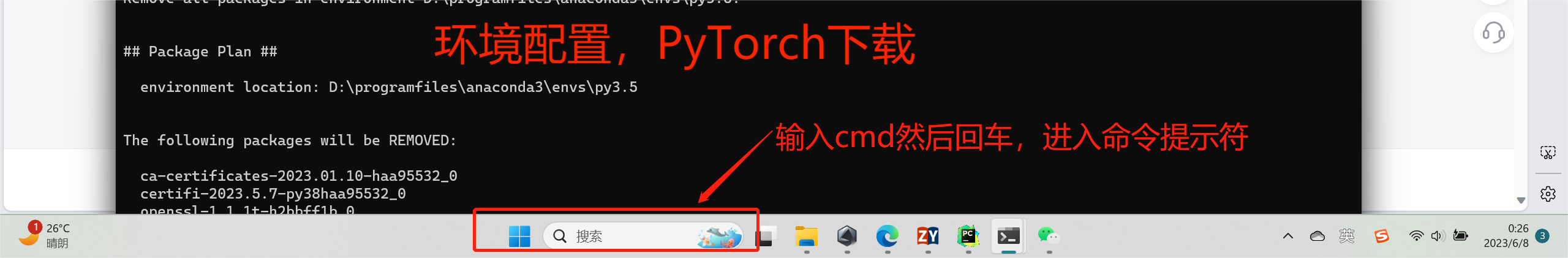

环境的配置,通俗讲解,PyTorchtorchvisiontorchaudiocudatoolkit的安装

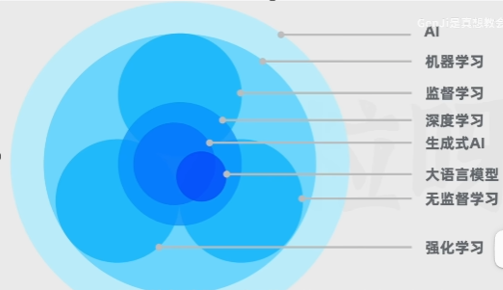

深度神经网络(Deep Neural Networks, DNNs)是机器学习的一种复杂形式,属于广义的人工神经网络(Artificial Neural Networks, ANNs)的范畴。它们设计用来模仿人类大脑的处理方式,通过多层(即“深度”)的神经元结构处理数据,从而解决各种复杂的数据驱动问题。这些网络通过多个隐藏层连接输入和输出层,每层都包含多个神经元,这些神经元通过激活函数处理信号。深

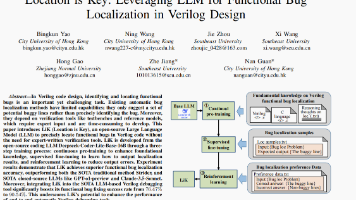

本文提出了一种基于大型语言模型(LLM)的Verilog功能缺陷定位方法LiK(Location is Key)。该方法通过三阶段训练:持续预训练(利用VGen、OpenCores等数据集增强Verilog理解)、有监督微调(使用LoRA算法避免过拟合)和强化学习(采用SimPO算法优化定位准确性)。实验表明,LiK在pass@1指标上达到93.33%的准确率,显著优于GPT-4(78.08%)等

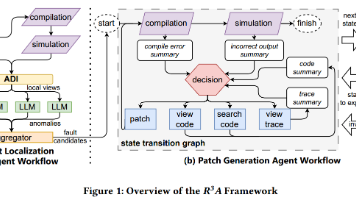

这篇论文提出了一个名为 R³A 的 RTL 自动修复框架,目标是提高 LLM 修复 RTL bug 的可靠性。它的核心做法是:先通过多智能体异常检测对大规模 RTL 代码进行局部分析,得到可疑故障位置;再把补丁生成建模成搜索问题,利用带启发式函数的随机 Tree-of-Thoughts 在多个代码状态和对话状态之间进行探索,从而更稳定地找到可通过测试的补丁。实验表明,该方法在 RTL-repair

作者提出了 CirFix,一个专门用于修复 Verilog 硬件设计缺陷的自动化修复框架。论文声称,这是首次较有效地把软件自动修复的收益迁移到硬件领域。

使用符号方法、形式化推理或约束求解来快速修复 RTL / 硬件设计代码。和依赖 LLM 的方法相比,这类方法通常更强调可验证性、严谨性、正确性保证。(不是LLM的方法这意思)(传统的方法,还有点复杂)

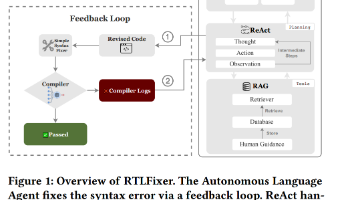

这篇论文提出了一个叫 RTLFixer 的框架,它把 LLM + ReAct + RAG + 编译器反馈 结合起来,让大语言模型像“自动调试代理”一样,反复修改 Verilog 代码里的语法错误,直到编译通过。论文声称它在他们构造的数据集上能修复 98.5% 的编译错误。

论文证明了:硬件安全 RTL repair 可以被有效建模为“prompt 引导的代码生成 + 自动验证筛选”问题,而不是只能依赖传统搜索式修复。

本文提出了一种基于大型语言模型(LLM)的Verilog功能缺陷定位方法LiK(Location is Key)。该方法通过三阶段训练:持续预训练(利用VGen、OpenCores等数据集增强Verilog理解)、有监督微调(使用LoRA算法避免过拟合)和强化学习(采用SimPO算法优化定位准确性)。实验表明,LiK在pass@1指标上达到93.33%的准确率,显著优于GPT-4(78.08%)等

深度神经网络(Deep Neural Networks, DNNs)是机器学习的一种复杂形式,属于广义的人工神经网络(Artificial Neural Networks, ANNs)的范畴。它们设计用来模仿人类大脑的处理方式,通过多层(即“深度”)的神经元结构处理数据,从而解决各种复杂的数据驱动问题。这些网络通过多个隐藏层连接输入和输出层,每层都包含多个神经元,这些神经元通过激活函数处理信号。深