简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

未来,希尔贝壳将秉持长期开源、优质开源的原则,持续迭代并开源更多覆盖多元场景、适配特殊需求的高质量语音数据集,为全球语音技术领域的模型创新、算法优化及应用落地提供坚实的数据支撑,助力破解非典型语音研究中的技术瓶颈,推动语音智能技术向更精准、更普惠、更多元的方向发展。我们期望以该语料库为纽带,凝聚全球协作力量,打破地域与技术壁垒,共建包容、公平、可持续的全球语音技术研究生态,推动语音技术普惠落地,覆

摘要:希尔贝壳联合多家研究机构推出首个大规模吴语语音语料库WenetSpeech-Wu,包含8000小时多维度标注数据,覆盖8种吴语子方言和13个领域。针对吴语语音处理生态匮乏问题,团队同时发布标准化评测基准WenetSpeech-Wu-Bench,涵盖ASR、语音翻译、情感识别等6项任务,并开源多个高性能语音处理模型。实验表明,基于该数据集训练的模型在各项任务中均显著优于现有系统,其中Confo

2024年5月,极佳科技联合国内外多家单位推出了全球首篇通用世界模型综述,该综述通过260余篇文献,对世界模型在视频生成、自动驾驶、智能体、通用机器人等领域的研究和应用进行了详尽的分析和讨论,该综述还审视了当前世界模型的挑战和局限性,并展望了它们未来的发展方向。「视界一粟 YiSu」基于团队自研的视频生成大模型技术,并没有止步于DiT,而是融合LLM和扩散模型的自研架构,结合各种路线的优势,在多模

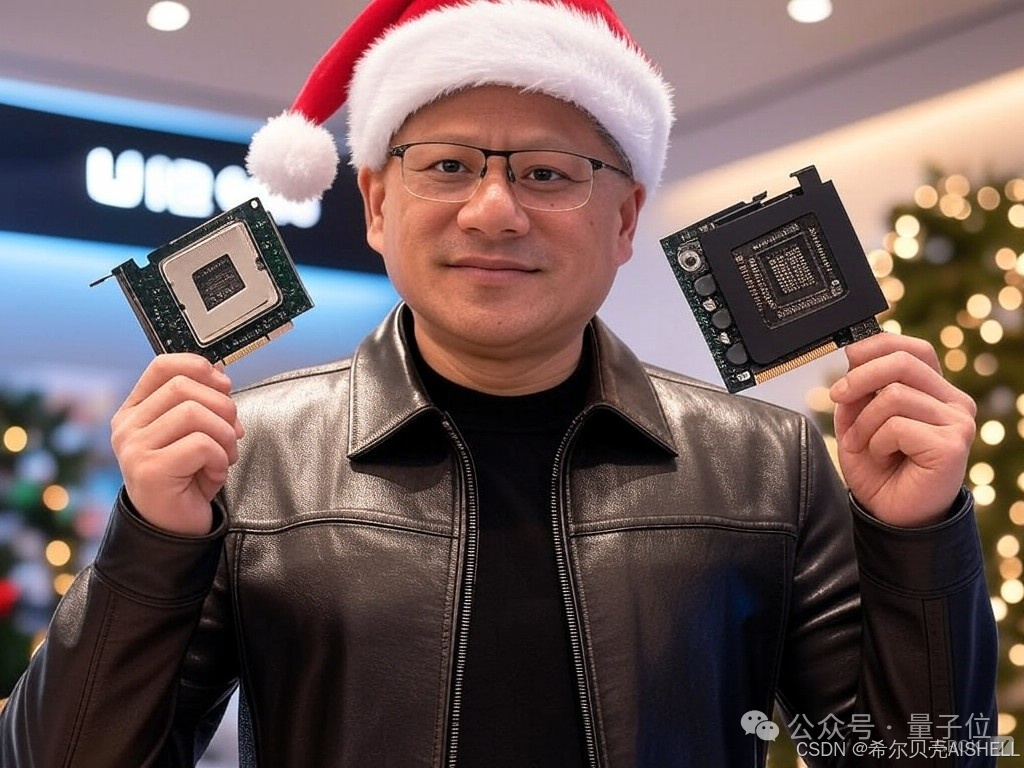

梦晨 西风 发自 凹非寺量子位 | 公众号 QbitAI英伟达老黄,成了今年的圣诞老黄。AI芯片大礼包刚刚曝光:GPU新核弹,以及附带CPU的超级芯片。,在产品层面上相比B200在FLOPS上提高50%,从192GB提升到288GB,也是提高了50%。包含72块GB300的“新一代计算单元,更是被评价为“能让OpenAI o1/o3推理大模型的思维链长度,在高batch size下达到10万tok

摘要:WenetSpeech-Chuan是首个大规模多维标注的川渝方言语音语料库,包含10,000小时来自9大领域的语音数据,并配有ASR转录、说话人属性、情感等多维度标注。针对川渝方言语音技术发展受限的问题,研究团队提出完整的Chuan-Pipeline处理框架,创新性地采用LLM-GER转录方法提升方言识别准确率15%。实验表明,基于该数据集训练的模型在ASR和TTS任务中性能超越现有SOTA

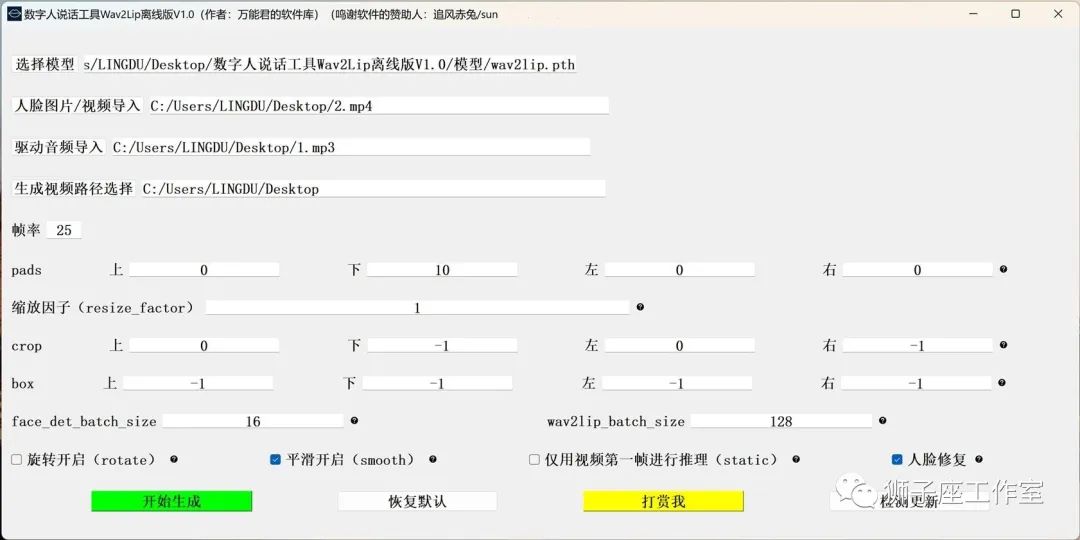

分享一波文字转语音、语音转文字!AI视频生成神器!让外国人说中文,口型自然,不限语言,感兴趣的同学可以试试~

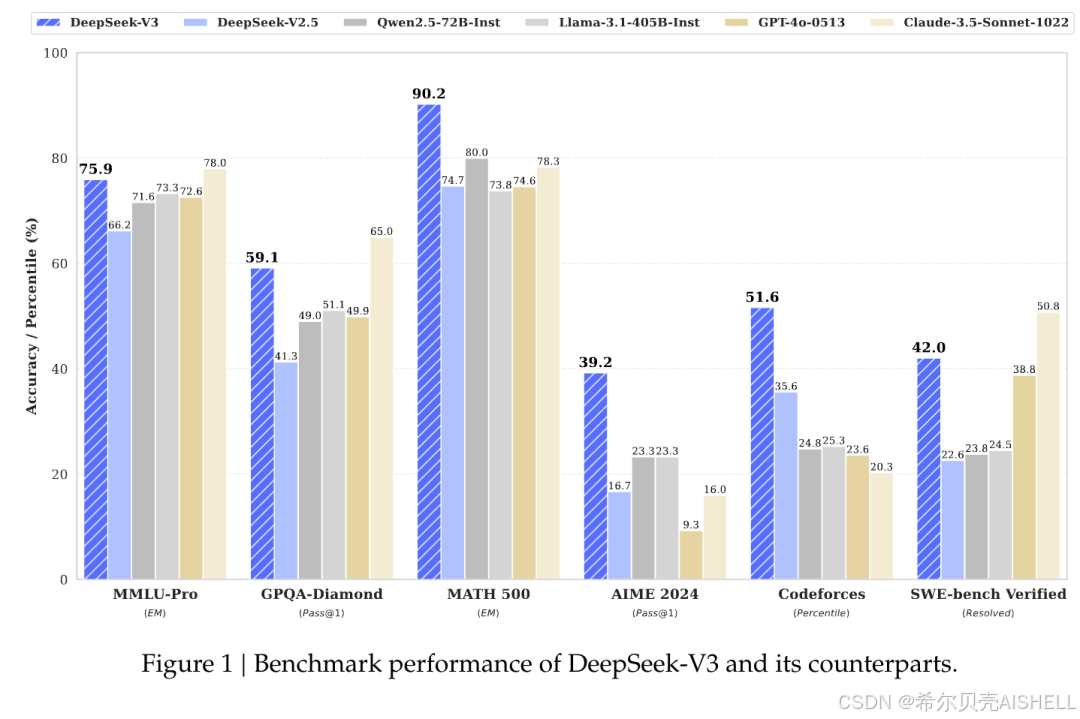

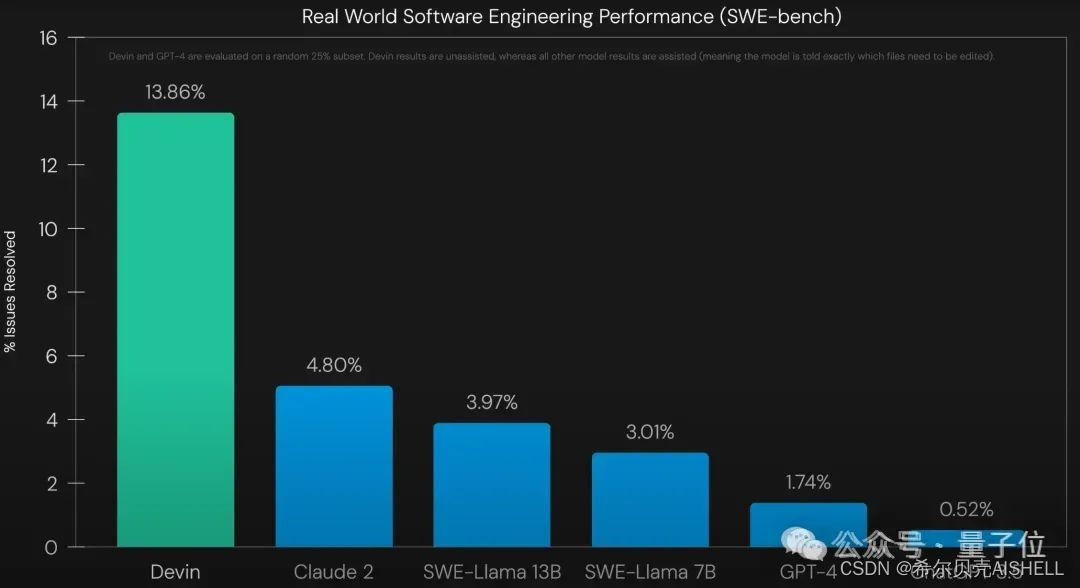

SWEBench排行榜上迎来了新玩家——,姚班带队初创公司OpenCSG出品,以23.67%的成绩获得全球第二名的成绩。同时创造了(SOTA)。我们都知道,SWEBench评测高度贴近真实编程场景,难度极高,不仅要求模型能理解需求、协调多个函数/类甚至文件的变更,还要求模型与执行环境交互,处理超长上下文并执行远超传统代码生成任务的复杂逻辑推理。在这种高难度的真实测试中,行业中最先进的GPT4和De

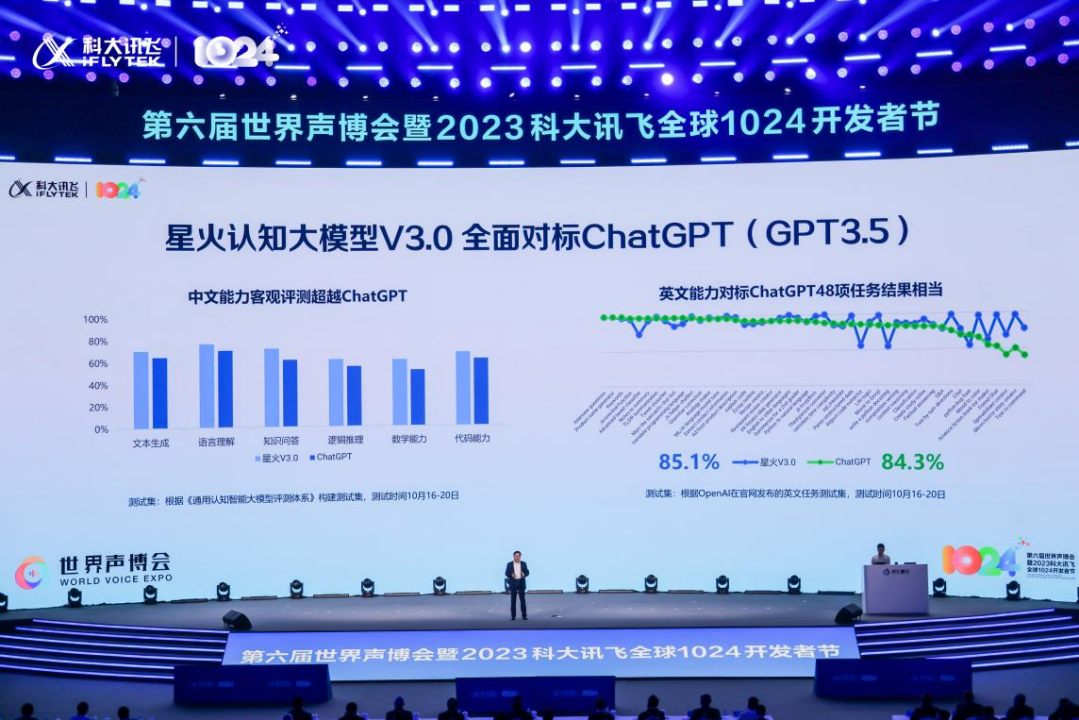

以 PPT 制作为例,我打开了 PPT 制作插件,然后在对话框中输入 “请帮我制作一份介绍讯飞星火 V3.0” 的 PPT,系统识别要求后开始调用 PPT 制作插件,大约在 3 秒后,一份 PPT 文件就显示制作好了,并可供下载,生成质量能够达到基本的使用需要。最后 ,就可以顺利开启对话了。和可爱小朋友“Aliceeee”的对话过程中,“Aliceeee”自己的人设意识相对连贯,能够按照人设对问题

今天为大家介绍的是来自上海交通大学的王延峰与谢伟迪团队的一篇论文。开源的多语言医学语言模型的发展可以惠及来自不同地区、语言多样化的广泛受众。来源丨 DrugAI、 机器人的脑电波。

在机器学习中,模型蒸馏是一种优化技术,通过模仿教师模型的输出,训练一个较小的学生模型,从而实现知识的传递。教师模型通常具有较高的性能,但计算成本高昂,而学生模型则更加轻量级,推理速度更快,且内存占用更少。