简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文从 LLaMA 的核心设计出发,拆解并实现了一个轻量级的 LLaMA-like 模型,覆盖了 RMSNorm、SwiGLU、RoPE、因果自注意力等关键组件。大模型看似复杂,但本质是 “简单组件的有序组合”—— 掌握这些核心设计,就能理解大模型的底层逻辑,为后续的模型训练、优化和部署打下基础。训练模型:用小数据集(如 WikiText)训练模型,观察 Loss 的下降趋势;扩展参数:将调至 4

题目给出的油耗、电耗函数都是 U 型:太慢时,低速拥堵工况不省能太快时,空气阻力和高负荷也不省能真正省能的是某个中间速度区间项目还进一步做了载荷修正。设载重率为 λ,则:也就是说,燃油车满载比空载高 40%,新能源车高 35%。总成本:98378.44综合目标:99184.13总碳排放:10893.51 kg总延误:119.72 min准时率:97.98%使用车辆数:143未使用车辆数:42成本项

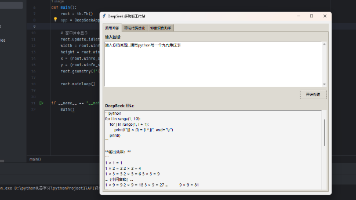

本文通过 Tkinter 搭建了一个轻量级的 DeepSeek 多功能 GUI 工作站,既讲解了 API 的配置与调用,也实现了多场景的 AI 交互。该项目易于扩展,可根据自己的需求添加更多功能,是学习 AI API 调用和 GUI 开发的绝佳实践案例。手把手搭建 DeepSeek 多功能 AI 工作站:基于 Python Tkinter 的 GUI 实现在 AI 工具日益普及的今天,DeepSe

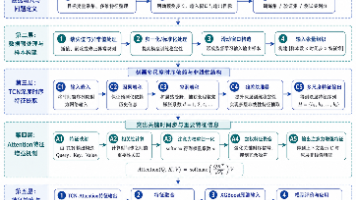

针对高比例新能源直流微电网中多储能单元功率互补、状态均衡与通信时延耦合引起的协同控制问题,本文基于本工程对分布式电-氢混合储能系统控制方法进行复现与改进分析。工程采用 MATLAB/Simulink 平均模型描述 4 母线直流微电网、DG/PV、负荷以及 BSU 蓄电池储能和 HSU 氢储能单元,并以实现离散平均仿真,以串联模型构建、基础复现、通信时延、通信故障、改进控制与时延裕度扫描实验。控制层

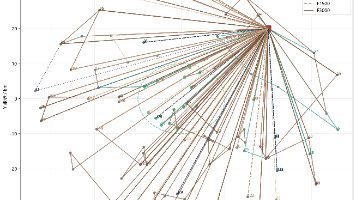

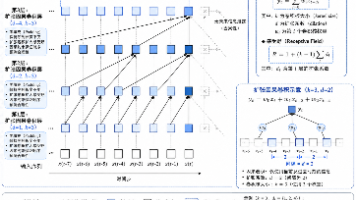

设时间序列观测值为ytt1Tytt1T,其中ttt为时间索引。ytftεtytftεt其中,ftf(t)ft表示趋势、季节项、外生变量和可解释特征共同形成的确定性或弱随机结构,εtεt表示模型未能解释的随机扰动。对于金融类序列,εtεt常具有尖峰厚尾、波动聚集和条件异方差等特征,因此仅采用均值方程建模往往不足。在深度学习和机器学习建模中,不同变量量纲差异可能影响参数优化。xt′xt−μ

本文基于一个真实 ESP-IDF 工程,复盘 ESP32-S3 网页控制 LED 的完整实现过程。项目运行后,ESP32-S3 以 SoftAP 模式创建 WiFi 热点,手机或电脑连接热点后访问,即可打开内置网页控制面板。网页通过 HTTP GET 请求访问/led/on/led/off/led/blink和等接口,ESP32 端由接收请求,再调用 LED 控制模块修改 GPIO1 电平,实现

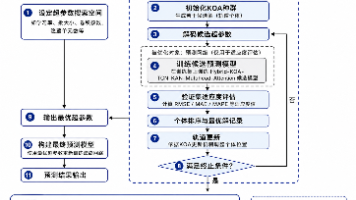

针对新能源出力波动、微电网间功率交互复杂以及传统群智能算法易早熟收敛等问题,构建一种融合双种群金豺优化算法(DGJO)与 TCN-BiGRU 时序预测网络的微电网集群优化调度方法。首先,面向由 3 个微电网组成的集群系统,建立包含光伏、风机、微型燃气轮机、储能电池、负荷、主网交易和微网间交易的综合成本最小化模型,目标函数覆盖运行成本、储能成本、维护成本、交易成本和环境成本。其次,设计 DGJO 算

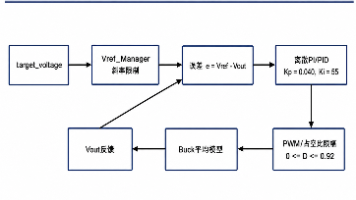

面向移动终端快充电源在多协议、多电压档位和负载扰动条件下的动态交互问题,基于本地工程建立了支持 QC 与 USB PD 简化交互的多模式 Buck 开关电源仿真模型。工程主模型为,根目录为缓存文件。模型由 QC 控制器、PD 控制器、协议管理器、参考电压斜率管理器、离散 PID 控制器、PWM 发生器、平均 Buck 功率级、保护与结果记录模块组成。功率级采用离散平均 Buck 模型,而非 Sim

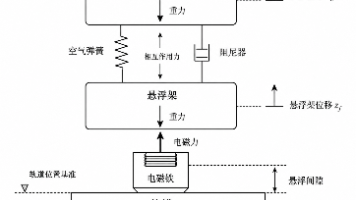

针对 2026 年数维杯 A 题“抱轨式磁浮列车的悬浮电磁铁故障检测问题”,本文将四个小问整合为一条连续的建模链:首先,基于附件1理想实验数据建立单电磁铁理想电磁力模型;其次,建立车体—悬浮架二自由度垂向动力学方程,求解车体与悬浮架在0∼10s0∼10s内的位移响应;再次,在全车 16 台电磁铁功率放大系数完全相同且固定不变的条件下,构造固定参数辨识模型,实现整车级功率放大器异常检测;

LSTM、GRU、Transformer 等深度模型虽然具备序列建模能力,但在金融数据这种“小噪声规律 + 大随机扰动”混合场景下,模型结构和超参数选择会显著影响效果。因此,一个有效的股票预测模型不能只记住近期价格,也不能只捕捉长期趋势,而需要同时具备局部模式提取、长距离依赖建模、非线性拟合和稳定调参能力。原因并不只是“股票市场噪声大”这么简单,而是金融时间序列同时具备多种复杂性质:非线性、非平稳