简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

是热度不断飙升的方向,且自带创新基因!多目标优化的引入,为强化学习提供了新研究方向和应用场景;强化学习则为多目标优化,提供了新的解决思路和方法。具体点说,以往强化学习只关注单一目标的优化,限制了在实际中的运用,而多目标优化的策略也比较有限。当两者结合,便能给我们的论文创新提供诸多机会,比如结合智能交通、医疗健康、金融等领域的数据集,进行微创新,就能发文。此外,这两者结合,在提升模型解决复杂问题时的

不愧是发文香饽饽!近来在各顶会、顶刊上,都看到不少成果。像是Nature上用于算法发现的AlphaDev模型;Neurips上训练效率狂提55.18倍的SOTRM模型……主要在于,强化学习一直都是AI领域的重要方向,但由于信用分配、样本效率低下、模型可解释性不足等问题,限制了其应用!而Transformer在处理长序列数据、捕捉复杂依赖关系、多模态信息融合方面的优势,则有助于解决这些挑战!同时,还

众所周知,多模态是当下的大趋势!而多模态融合则是其中的关键研究!它通过利用多个数据流之间的互补特性,融合不同类型的数据,在提供模型的准确性、鲁棒性、改善生成任务质量方面优势显著。自动驾驶、医疗影像、情感分析和人机交互等领域都离不开它。但也面临设备性能限制、信息缺失和数据噪声等挑战。因而对它的研究成为了迫切需求,CVPR、NeurIPS、ACM等都有多篇成果!像是标注数据减少99.8%,性能依旧飙升

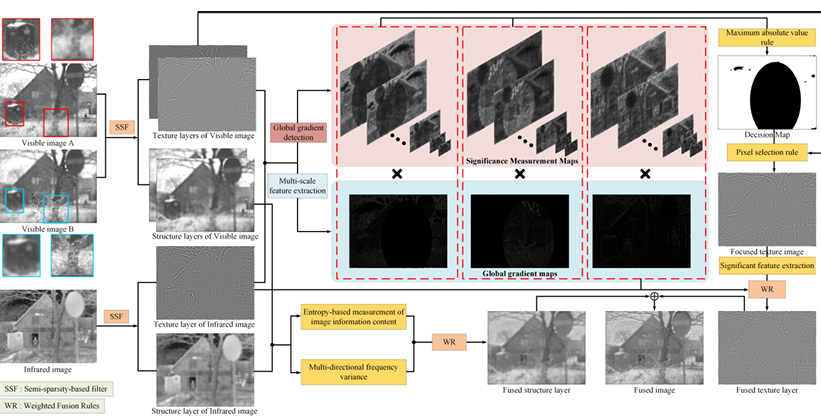

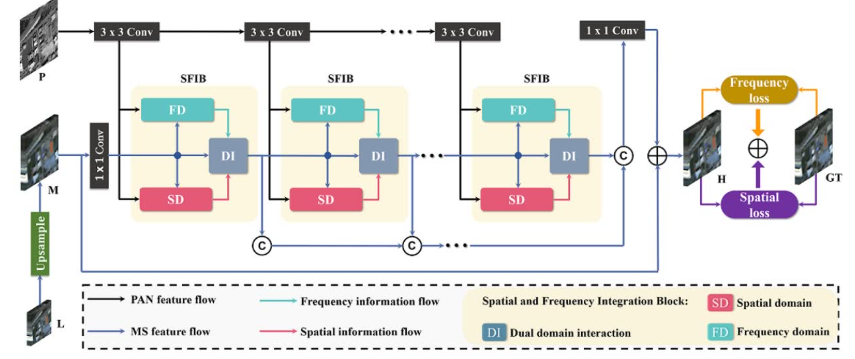

杀疯了!前脚CVPR24刚开拓了融合新范式,提出端到端自监督学习的模型EMMA,刷爆多项SOTA;后脚TPAMI24便又发表首个,能在空间域和频域同时处理融合问题的模型SFINet!不仅如此,在ECCV、WACV、AAAI等顶会,也都有多篇,热度可见一斑!主要在于,它能将多种类型的图像数据或特征相互融合,在提高图像识别、处理任务准确性和效率方面效果拔群,且在自动驾驶、医学影像、人机交互等领域都有着

是当前非常热门,且可挖掘的创新点很丰富的方向。交叉注意力机制动态对齐不同模态信息的特点,能够克服多模态最大的挑战之一。因而,该思路备受审稿人青睐,在各顶会录用量不断飙升。同时,这一特点,也能有效提升模型对复杂数据的理解能力。机器翻译、视觉问答、医疗诊断等领域,都离不开它。结合不同的场景,就能做微创新。比如模型LV-XATTN,便实现了速度提高45.85倍的效果……

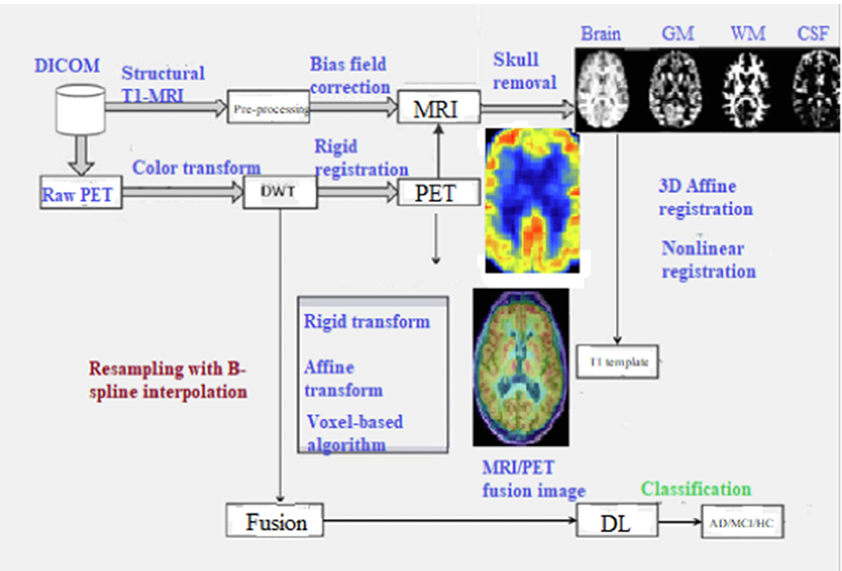

它是一项能将不同成像方式或设备获取的医学图像进行综合处理的技术。在临床诊断、治疗规划、手术导航及疗效评估等领域都有广泛的应用,对提高诊断全面性、准确性等不可替代!比如Nature上的模型ncomms,在准确率、敏感性等方面都远超SOTA;顶会MICCAI上的TFS-Diff模型,则使性能狂飙72.8%……但其也面临数据不均衡、模型过拟合、计算开销等问题,因而对其的研究成为了迫切需求。且还不算卷,创

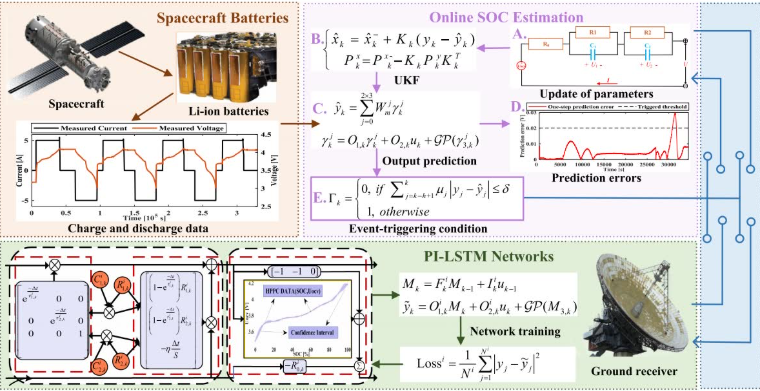

PINN再出神操作!与LSTM结合,拿下多篇一区!模型PI-LSTM更是取得了准确率飙升66.57%的拔群效果!这主要得益于:PINN可以通过引入物理定律,来约束神经网络的训练过程,从而减少过拟合的风险。而LSTM的记忆单元和门控机制,则能够捕捉和保持时序中的关键信息,进一步提高模型的预测能力。两者结合,优势互补,对提高模型精度大有裨益!此外,其还有助于提高模型的泛化能力,增强模型的抗噪性和训练效

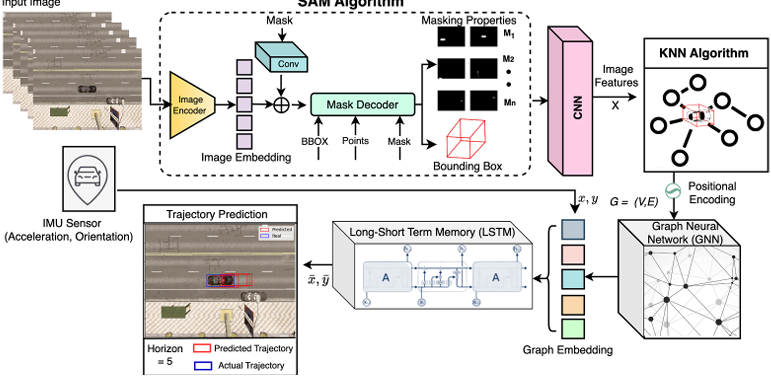

是一个非常有前景,且能发高区的思路!近来其更是取得了新突破,模型DNN-GNN-LSTM在自动驾驶轨迹预测中,误差狂降95%,且参数量减少97.7%;模型hetGNN-LSTM则推理速度飙升了10倍……此外,在ACM MM24、AAAI24等顶会也不乏其身影。其热度可见一斑!主要在于,该结合能同时捕捉数据中的时间相关性和空间相关性,不仅能提升模型性能,也能适应诸多实际场景需要,像是交通预测、社交网

是AI领域的热门方向,不仅创新空间大,而且实用价值高!在各顶会、顶刊都是“红人”,光是中科院1区就有多篇。像是准确率高达99.4%的CIR-DFENet;预测误差直降78%的SCGA……其充分结合了Attention、LSTM、特征融合三者的优势,为处理复杂序列数据和增强模型性能提供了新思路。先由LSTM捕捉长期依赖关系,接着引入Attention突出其中的关键信息。最后,再由特征融合来整合不同的

最近看顶会,发现的热度暴涨!ICML、NeurIPS等都有多篇,效果也都拔群!像是在交通信号控制任务中,违规率直降79%的SAC-GNN、性能狂提60%的CMTA……主要是因为,在强化学习中引入注意力机制,能帮助模型更好地理解和利用环境信息。无论是在状态表示、动作选择还是奖励预测阶段,注意力机制都能发挥重要作用。它能够突出关键信息,抑制无关信息,从而模型在决策时更加准确和迅速。目前这种结合在游戏A