简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

你是否苦于特征管理混乱、模型黑箱难解释、调参效率低下、线上数据漂移难察觉?本篇博客基于3年实战经验,深度测评4个小众却高效的机器学习工具库:Feast(轻量特征存储)、Alibi(快速模型可解释)、TPOT(自动机器学习管道)、Evidently AI(专注数据漂移监控)。每个工具均从核心功能、实操案例、优缺点到适用场景全解析,提供即用代码,助你打破“主流工具陷阱”,提升高阶实战效率。

开发STM32F4,需要使用到Keil5MDK。因此,我们需要下载这个软件。(1)找到软件(2)双击运行软件,点击Next(3)点击下方的I agree to all... (4)选择好安装路径,建议在C盘外新建一个文件夹,且文件夹不要是中文(5)选择好安装路径之后,点击Next安装即可 (6) 设置 (7)点击Next(8)开始下载(9)下载成功后,使用特殊方法激活即可。可以直接点击芯片包所在的

目标:如图所示将两路数据显示在波形图中,1路数据的取值范围是0-5,另外一路数据的取值范围是5-10,每隔200ms采集一个点。

你是否苦于特征管理混乱、模型黑箱难解释、调参效率低下、线上数据漂移难察觉?本篇博客基于3年实战经验,深度测评4个小众却高效的机器学习工具库:Feast(轻量特征存储)、Alibi(快速模型可解释)、TPOT(自动机器学习管道)、Evidently AI(专注数据漂移监控)。每个工具均从核心功能、实操案例、优缺点到适用场景全解析,提供即用代码,助你打破“主流工具陷阱”,提升高阶实战效率。

当单卡GPU遭遇显存不足、训练过慢的瓶颈时,分布式训练是突破限制的关键。本文深入浅出地解析了分布式训练的三大核心策略:数据并行通过复制模型、同步梯度实现高效训练;模型并行通过流水线与张量拆分攻克大模型存储难题;混合并行结合ZeRO等技术进一步优化资源。文中不仅配有PyTorch DDP、Megatron-LM等实战代码,还总结了常见陷阱与解决方案,助你轻松驾驭大规模模型训练。

本文深入浅出地解析了Transformer这一革命性模型如何突破RNN/CNN的局限,为BERT、GPT等大模型奠定基础。文章从自注意力机制(让模型拥有“全局视野”)讲起,生动拆解了多头注意力、编码器-解码器结构等核心原理,并通过完整的Python项目(含自注意力、多头注意力、位置编码及简化Transformer实现)带读者动手实践,直观展示其并行计算和长距离依赖捕捉能力。全文避免复杂公式,用比喻

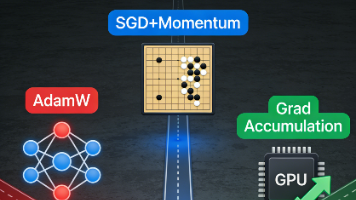

优化器选择没有“银弹”,精准匹配场景才是关键。本文通过三大实战案例,直击算法工程师的调参困境:为何BERT必须用AdamW?因其解决了L2正则与自适应学习率的“耦合冲突”,避免参数过度衰减。为何强化学习偏爱SGD?其动量机制能抵御高方差梯度噪声,而Adam的“过度适应”反成弱点。为何大语言模型依赖梯度累积?它用时间换空间,在小显存下模拟大Batch的稳定性。核心在于理解优化器底层逻辑,根据数据噪声

你是否苦于特征管理混乱、模型黑箱难解释、调参效率低下、线上数据漂移难察觉?本篇博客基于3年实战经验,深度测评4个小众却高效的机器学习工具库:Feast(轻量特征存储)、Alibi(快速模型可解释)、TPOT(自动机器学习管道)、Evidently AI(专注数据漂移监控)。每个工具均从核心功能、实操案例、优缺点到适用场景全解析,提供即用代码,助你打破“主流工具陷阱”,提升高阶实战效率。

本文深度解析生成式AI四大流派:自回归模型(AR)、标准化流(Flow)、生成对抗网络(GAN)与扩散模型(Diffusion)。通过“宇航员骑马”的生成案例,揭示不同模型在理解空间关系、生成质量与训练稳定性上的根本差异。文章以统一视角剖析它们共享的概率逼近目标,并指出各自优势与局限——AR的序列严谨、Flow的数学优雅、GAN的生成质量、Diffusion的稳定平衡。最后展望未来趋势:融合各派优

本文深入浅出地解析了Transformer这一革命性模型如何突破RNN/CNN的局限,为BERT、GPT等大模型奠定基础。文章从自注意力机制(让模型拥有“全局视野”)讲起,生动拆解了多头注意力、编码器-解码器结构等核心原理,并通过完整的Python项目(含自注意力、多头注意力、位置编码及简化Transformer实现)带读者动手实践,直观展示其并行计算和长距离依赖捕捉能力。全文避免复杂公式,用比喻