简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了一款基于ESP32-S3主控和CSNP1GCR01-AOW存储芯片的智能小型夜灯方案。该夜灯采用高效LED光源和智能感应技术,支持远程控制、自动调光等功能。存储方案选用微型化设计的SD NAND芯片,具有1Gbit容量、6*8mm超小封装,内置四大管理算法保障数据安全。实测显示其读取速度超20MB/s,写入速度4.6MB/s,满足灯光模式存储需求。整体方案兼顾性能与体积,实现了稳定可靠、

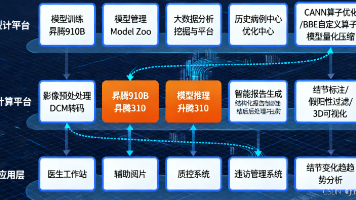

CANN(Compute Architecture for Neural Networks)作为华为面向人工智能场景打造的端云一致异构计算架构,已成为国产化AI基础设施的关键软件支撑。其核心优势在于通过统一编程接口、高效算子库和智能调度系统,实现了从底层硬件到上层应用的全栈协同优化,为开发者提供了简单易用却又性能强大的AI开发环境。

CANN(Compute Architecture for Neural Networks)是华为面向人工智能场景打造的端云一致异构计算架构,其核心价值在于通过统一编程接口、高效算子库和智能调度系统,为AI基础设施提供关键的软件支撑。CANN以极致性能优化为核心,旨在释放硬件潜能、简化AI开发流程。对于一些特殊的计算需求,CANN提供了自定义算子开发能力,允许开发者根据自己的需求开发专用的高性能算

import tbe# 定义3D卷积算子计算逻辑# 1. 获取输入和权重的形状信息# 2. 检查输入参数合法性if groups!= 1:# 3. 计算输出形状# 考虑padding和stride计算输出维度# 4. 实现优化的3D卷积计算# 使用TVM的计算表达式描述3D卷积# 针对昇腾AI处理器的特性进行优化# 4.1 输入数据填充else:# 4.2 执行3D卷积计算# 使用滑动窗口和矩阵乘

本文介绍了基于vLLM-ascend框架在昇腾NPU上快速部署DeepSeek-V2-Lite模型的全流程。vLLM-ascend作为专为昇腾NPU优化的高性能推理框架,支持MoE架构模型的0Day部署,显著降低混合专家模型的部署门槛。文章详细展示了从GitCode Notebook环境配置、vLLM-ascend安装到模型下载和推理部署的核心步骤,并验证了昇腾NPU在7B参数模型上的高效推理能力

本文介绍了基于vLLM-ascend框架在昇腾NPU上快速部署DeepSeek-V2-Lite模型的全流程。vLLM-ascend作为专为昇腾NPU优化的高性能推理框架,支持MoE架构模型的0Day部署,显著降低混合专家模型的部署门槛。文章详细展示了从GitCode Notebook环境配置、vLLM-ascend安装到模型下载和推理部署的核心步骤,并验证了昇腾NPU在7B参数模型上的高效推理能力

结构体类型的声明,结构的自引用,结构体变量的定义和初始化,offsetof宏的使用,结构体内存对齐,结构体传参,结构体实现位段(位段的填充&可移植性)等知识

本文介绍了基于vLLM-ascend框架在昇腾NPU上快速部署DeepSeek-V2-Lite模型的全流程。vLLM-ascend作为专为昇腾NPU优化的高性能推理框架,支持MoE架构模型的0Day部署,显著降低混合专家模型的部署门槛。文章详细展示了从GitCode Notebook环境配置、vLLM-ascend安装到模型下载和推理部署的核心步骤,并验证了昇腾NPU在7B参数模型上的高效推理能力

本文介绍了基于vLLM-ascend框架在昇腾NPU上快速部署DeepSeek-V2-Lite模型的全流程。vLLM-ascend作为专为昇腾NPU优化的高性能推理框架,支持MoE架构模型的0Day部署,显著降低混合专家模型的部署门槛。文章详细展示了从GitCode Notebook环境配置、vLLM-ascend安装到模型下载和推理部署的核心步骤,并验证了昇腾NPU在7B参数模型上的高效推理能力

通过本次全面的性能评测,我们对openEuler在服务器场景下的性能表现有了深入的了解。评测结果表明,openEuler通过自主创新技术,构建了高可靠、高性能的服务器系统底座,能够满足各种企业级应用场景的需求。本次评测全面验证了openEuler在服务器场景下的性能表现,结果表明openEuler通过自主创新技术,构建了高可靠、高性能的技术底座,能够满足各种企业级应用场景的需求。openEuler