CVPR 2023 | 结合Transformer和CNN的多任务多模态图像融合方法

©作者 | 奥本海默本文为大家带来 CVPR 2023 在图像融合领域的最新工作 CDDFuse: Correlation-Driven Dual-Branch Feature Decomposition,作者是西安交通大学的赵子祥博士。本文的整体架构和赵博士先前在 IJCAI 上发表的 DIDFuse 有继承关系,这次的亮点是:结合 CNN 和当前火爆的 Transformer;将特征解耦的思想

©作者 | 奥本海默

本文为大家带来 CVPR 2023 在图像融合领域的最新工作 CDDFuse: Correlation-Driven Dual-Branch Feature Decomposition,作者是西安交通大学的赵子祥博士。本文的整体架构和赵博士先前在 IJCAI 上发表的 DIDFuse 有继承关系,这次的亮点是:

结合 CNN 和当前火爆的 Transformer;

将特征解耦的思想引入了图像融合,将跨模态信息分解为共有信息和特有信息,类似于 DRF 等融合模型;

两阶段训练法,第一阶段采用的输入和输出都是源图像的自监督方式,SD-Net、SFA-Fuse 采用了这类思想;

用高级视觉任务验证了融合效果。

论文标题:

CDDFuse: Correlation-Driven Dual-Branch Feature Decomposition

论文链接:

https://arxiv.org/abs/2211.14461

多模态图像融合目的是结合各个模态图像的特点,如有物理含义的高亮区域和纹理细节。为了能对跨模态进行有效建模,并分解得到期望的各模态共有特征和特有特征,本文提出了 Correlation-Driven feature Decomposition Fusion (CDDFuse) 来进行多模态特征分解和图像融合。

本文模型分为两阶段,第一阶段 CDDFuse 首先使用 Restormer 块来提取跨模态浅层特征,然后引入双分支 Transformer-CNN 特征提取器,其中 Lite Transformer (LT) 块利用长程注意力处理低频全局特征,Invertible Neural Networks (INN) 块则用来提取高频局部特征。基于嵌入的语义信息,低频特征应该是相关的,而高频特征应该是不相关的。因此,提出了相关性驱动损失函数,让网络可以对特征进行更有效的分解。

第二阶段,前述的 LT 和 INN 模块会输出融合图像。实验部分展示了 ir-vis 和医学影像融合两种任务,并且还验证了 CDDFuse 可以提升 ir-vis 对分割、检测等下游任务的效果提升。

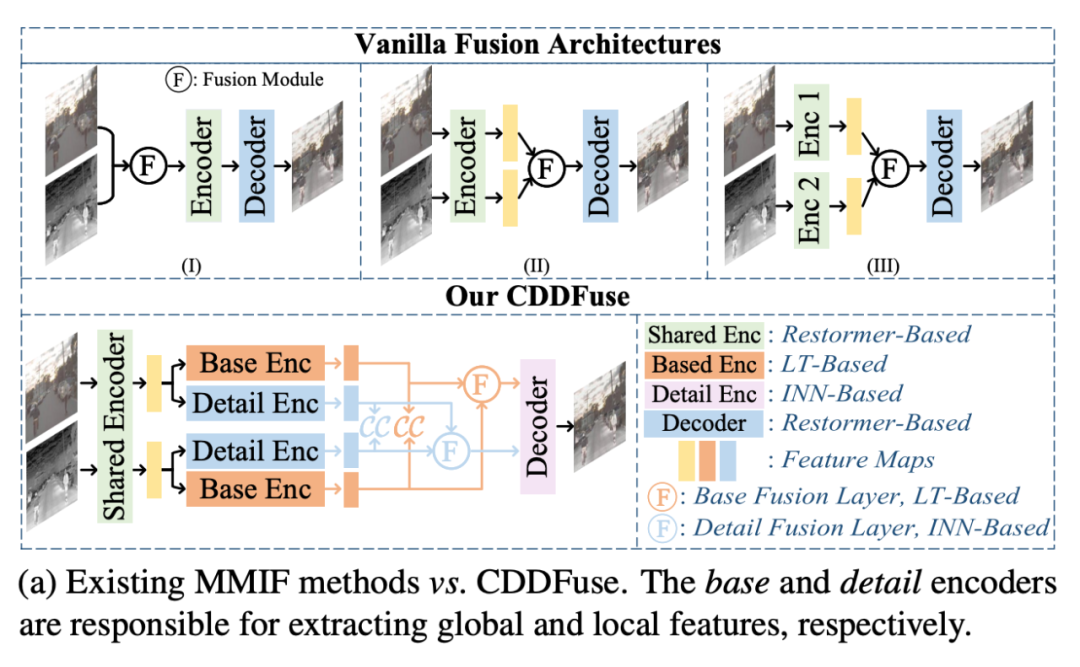

目前已有的多模态图像融合模型很多采用自编码器结构,如下图 a。

但是这种方式有三个缺陷:

1. CNN 的解释性较差,难以控制,对跨模态特征提取不够充分,如上图 a 前两种都是多模态输入共享编码器,因此难以提取到模态特有的特征,而第三种双分支结构则忽略了各个模态共有属性;

2. 上下文独立的 CNN 结构只能在相对小的感受野内提取到局部信息,很难捕获全局信息,因此目前还不清楚 CNN 的归纳偏差能否对所有模态的输入充分提取特征;

3. 网络的前向传播会造成高频信息丢失。

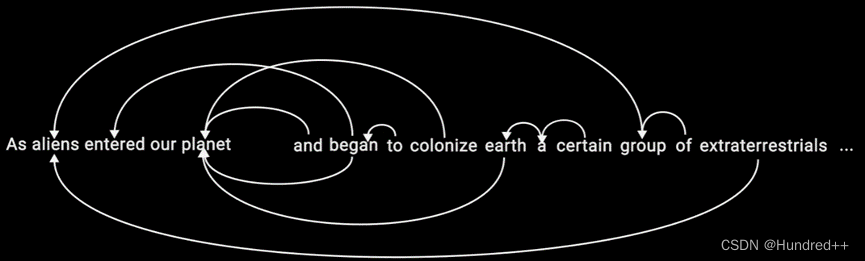

本文探索了一种合理的范式来解决特征提取和融合上的问题。首先给提取到的特征添加相关性约束,提高特征提取的可控制性和可解释性,本文的假设是对于多模态图像融合,两个模态的输入特征在低频上是相关的,表示了所有模态的共有信息,在高频上是不相关的,表示了各个模态独有的信息。

比如 ir-vis 融合,红外与可见光图的场景相同,在低频信息上包含统计上的共有信息,比如背景和大尺度环境特征,而高频部分的信息则是独立的,比如可见光模态纹理细节信息和红外模态的温度信息都是各自模态特有的。

因此需要通过分别提高低频部分特征之间相关性、降低高频特征之间的相关性来促进跨模态特征提取。transformer 目前在视觉任务上很成功,主要得益于它的自注意力机制和全局特征提取能力,但是往往很大的计算资源,因此本文提出让 transformer 结合 CNN 的局部上下文提取和计算高效性的优势。

最后,为了解决丢失期望高频输入信息的问题,引入了 Invertible Neural networks (INN) 块,INN 是通过可逆性设计让输入和输出特征的相互生成来防止信息丢失,符合融合图像中保留高频特征的目标。

模型方法

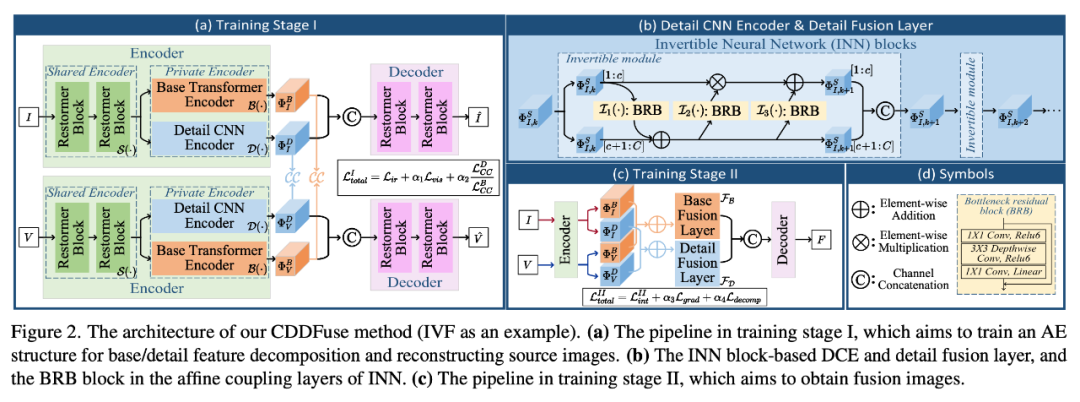

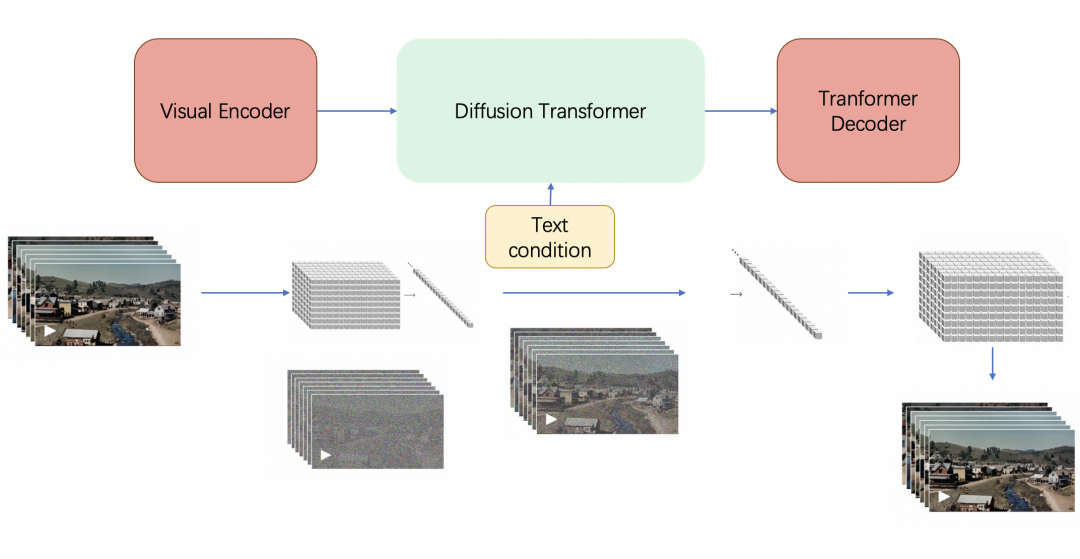

模型整体结构如下图,整体分为四个模块:双分支编码器用于特征提取与分解、解码器用于训练阶段 I 的图像重建或者训练阶段 II 的图像融合、base/detail 融合层用于融合不同频率的特征。

编码器:包含三部分:Restormer block - based share feature encoder (SFE)、Lite Transformer (LT) block - based base transformer encoder (BTE)、 Invertible Neural networks (INN) block - based detail CNN encoder (DCE),其中 BTE 和 DCE 共同组成长短距离编码器。

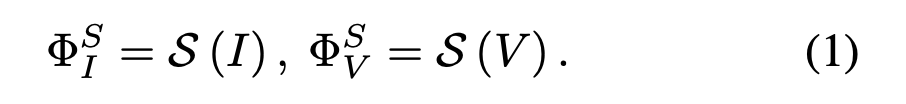

对于输入的三通道可见光图和单通道红外图,用 S、B、D 分别表示 SFE、BTE、DCE 三个模块。首先来看用来提取共有特征的 SFE 模块,它的目标是提取浅层特征,如下式。

在 SFE 中使用 Restormer block 的原因是利用维度间的自注意力机制提取全局特征,因此可以不增加算力的情况下提取跨模态浅层特征,这里采用的 Restormer block 结构来源于 Syed Waqas Zamir, Aditya Arora, Salman H. Khan, Munawar Hayat, Fahad Shahbaz Khan, and Ming-Hsuan Yang. Restormer: Efficient transformer for high-resolution image restoration. CoRR, abs/2111.09881, 2021.

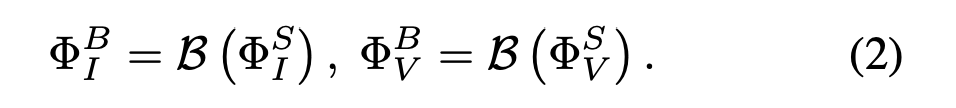

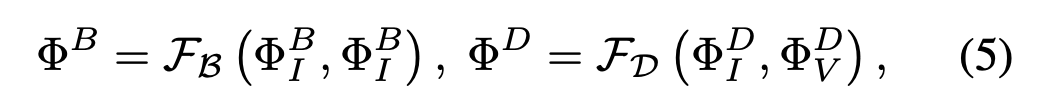

BTE 用来从共有特征中提取低频基特征,如下式。

为了能提取城距离 dependency,使用具有空间自注意力的 transformer,为了能平衡效果和运算效率,这里采用了 LT block 作为 BTE 的基础单元,可以在降低参数量的情况下保证效果。

DCE 和 BTE 相反,用来提取高频细节信息,如下式。

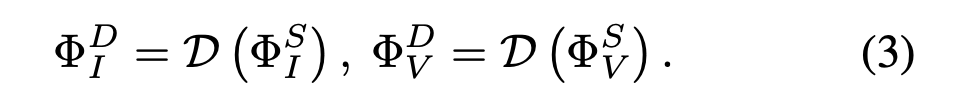

考虑到边缘纹理信息在融合任务中也很重要,这里就希望 DCE 能尽量保留更多的细节。INN 模块通过输入和输出能相互生成来确保输入信息被尽可能保留,因此可以在 DCE 中用于无损特征提取,具体实现时是用 INN 搭配 affine coupling 层,每个可逆层的变换如下。

上式过程和图 2 的 b 中过程是对应的,图中 BRB 的结构如图 2 中的 d(来源于 MobileNetV2),每个可逆层中的 BRB 都可以看做是无损信息映射。

融合层:用于将编码器提取到的特征进行融合。考虑到 base/detail 特征融合的归纳偏置应该和编码器的 base/detail 特征提取相同,使用 LT 和 INN 块来实现 base/detail 融合层,如下式。

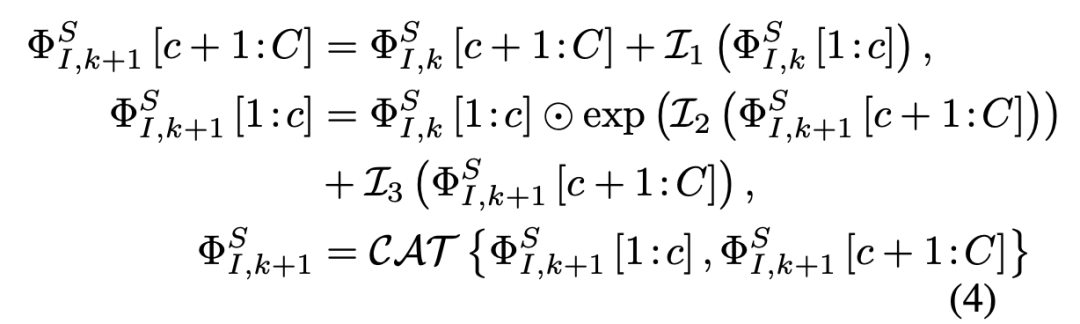

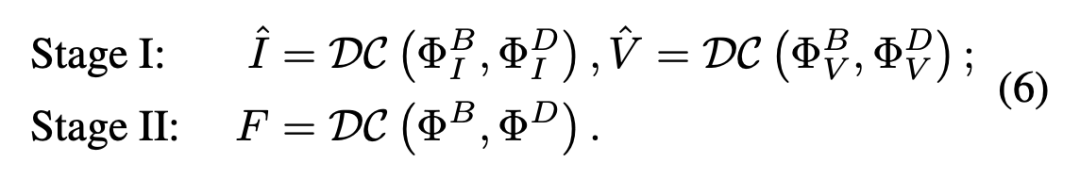

解码器:解码器首先将分解的特征在通道维度拼接作为输入,然后在训练阶段I将源图作为输出,在训练结算 II 将融合图作为输出,如下式。

由于输入的特征是跨模态且多频段特征,因此让解码器结构和 SFE 保持一致,即将 Restormer block 作为基础单元。

两阶段训练:由于没有 GT,采用和 RFN-Nest 相同的两阶段训练法。一阶段将 ir-vis 作为 SFE 的输入来提取浅层特征,然后 BTE 和 DCE 提取高低频特征,然后再把红外的 base 和 detail 特征拼接,可见光的 base 和 detail 特征拼接,送到解码器中,分别用来重建原始输入的红外图和可见光图。

二阶段训练时的编码器部分相同,不同之处为提取到 base 和 detail 特征之后,可以看图 2 的c,需要将红外和可见光的 base 特征相加,detail 特征也分别相加,然后分别送入 base 和 detail 融合层中,输出再在通道维度上拼接,经过解码器后就是融合图像 F 了。

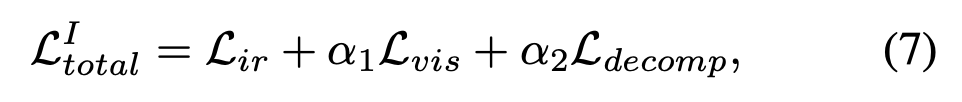

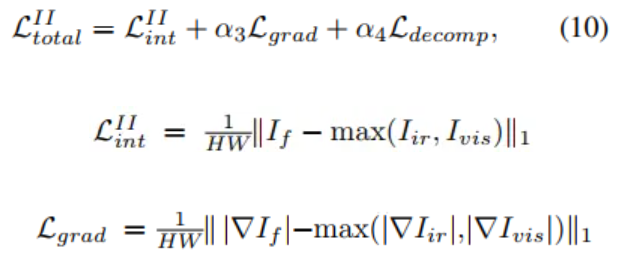

损失函数:一阶段损失函数如下。

前两项是红外和可见光的重建损失,第三项是特征分解损失。一阶段损失整体是为了编码和解码过程中信息不会损失。

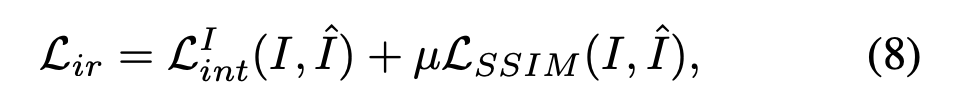

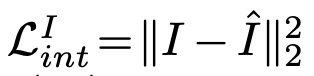

第一项红外重建损失形式如下。

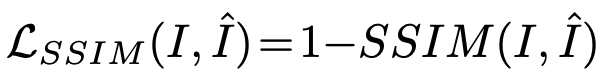

第二项的可见光重建损失和上式形式是一样的,换成可见光图即可。

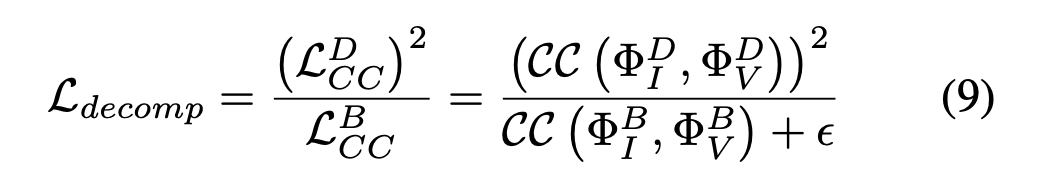

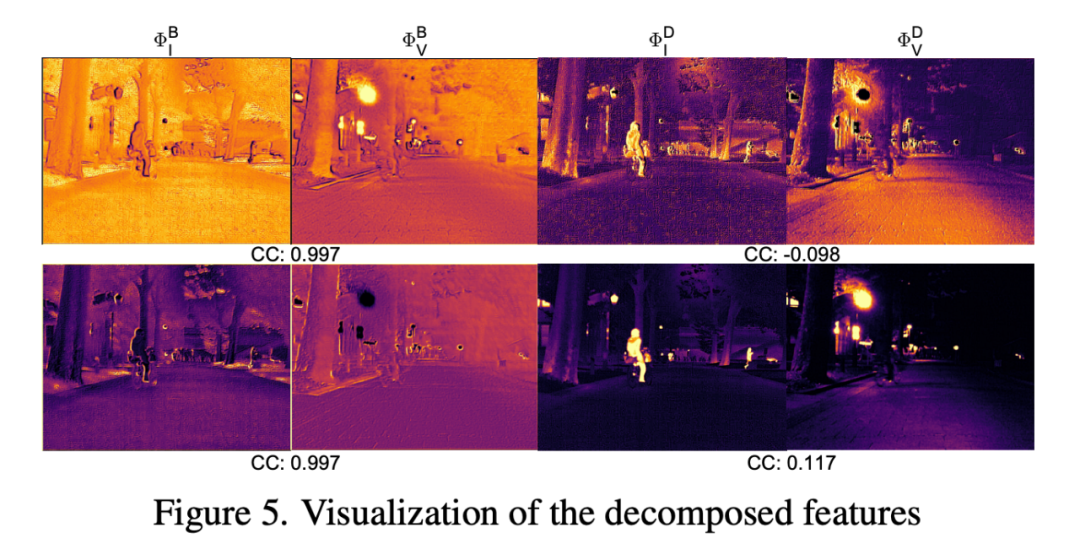

特征分解损失形式如下。

式中的 CC 是融合中常用的指标 correlation coefficient。这一项损失就是前文中描述的让共有特征之间距离尽量近、特有特征之间距离尽量远,搭配相关系数可以测量特征之间距离了,因此将低频 base 特征作为分母,高频 detail 特征作为分子。该部分分解的效果如下图。

二阶段的损失函数形式如下。

实验部分

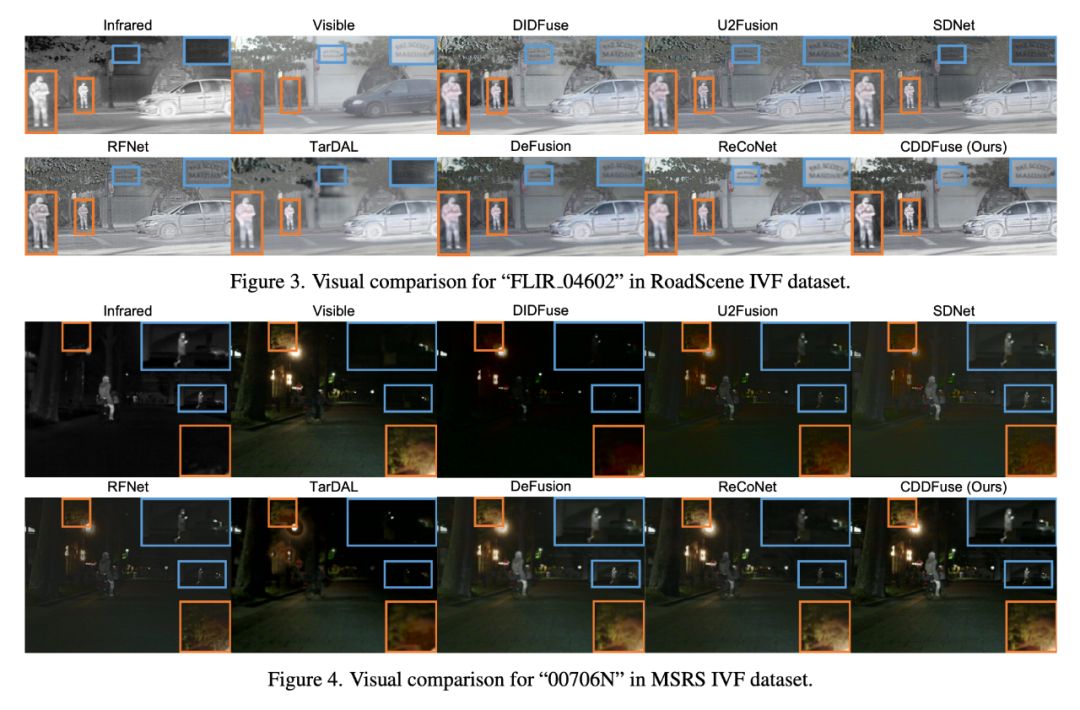

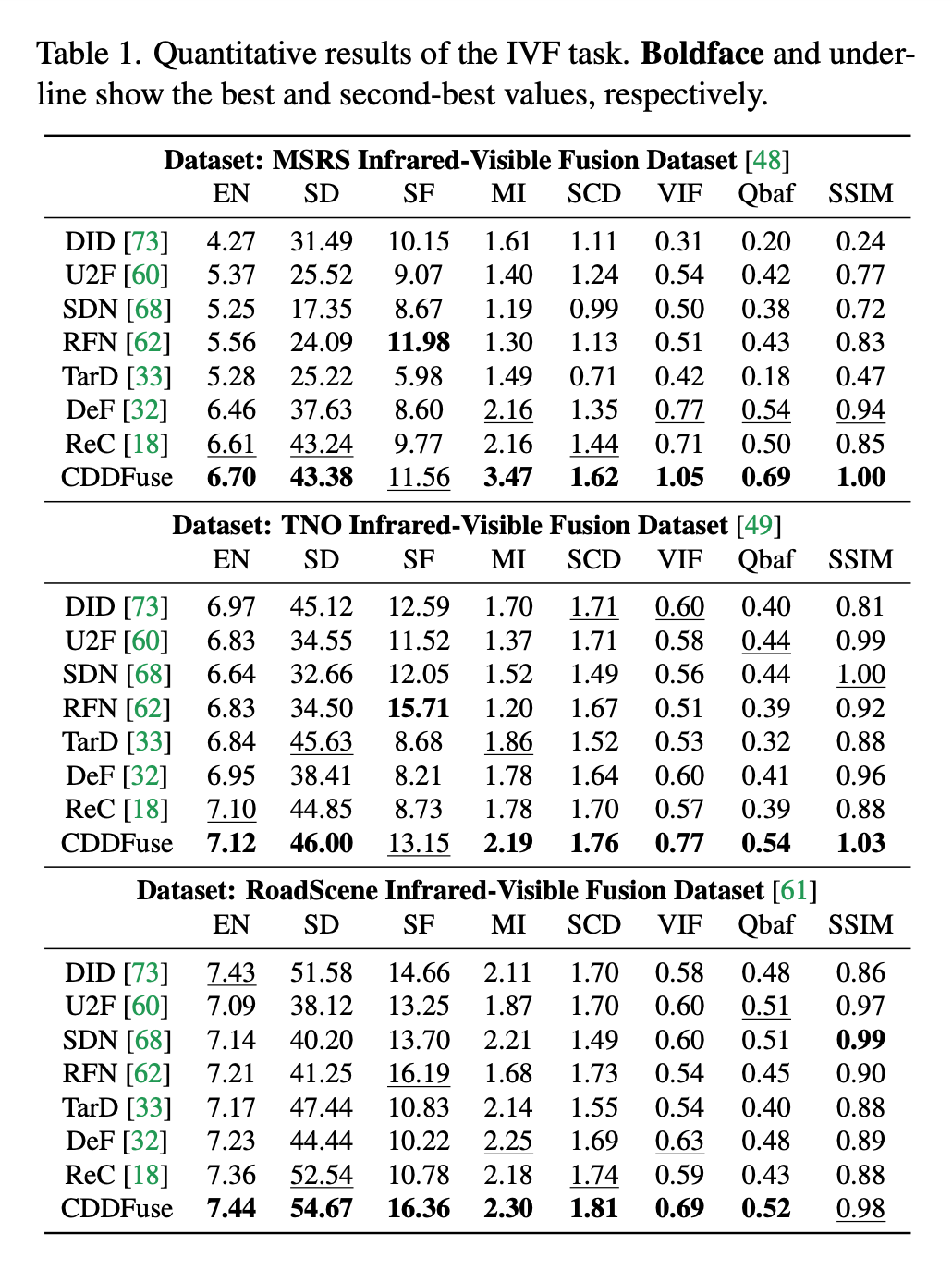

实验使用 ir-vis 融合来演示,选择了 MSRS、Roadscene、TNO 三个经典数据集。训练时将图片裁切为 128×128 的 patch,训练 120 个 epoch,其中第一阶段和第二阶段分别为 40 和 80,batch 设置为 16。其他训练细节可以直接看原文。

方法之间的对比可以看下图。

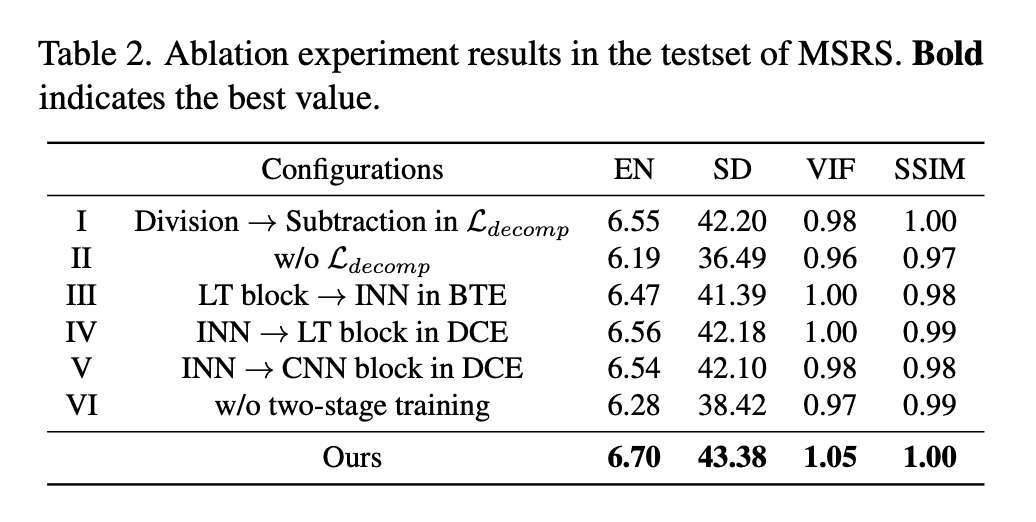

消融实验有三部分。第一部分是分解损失,将 base 和 detail 损失由相除变为相减,另一个是直接去除分解损失。编码器中的 LT 和 INN 块也进行了消融实验,分别是将 BTE 中的 LT 换为 INN、DCE 中的 INN 换为 LT、DCE 中的 INN 换为 CNN。最后一个是两阶段训练的实验,也就是直接采用一阶段训练法,用第二阶段的融合图像作为约束训练网络,可以看到效果差了很多。

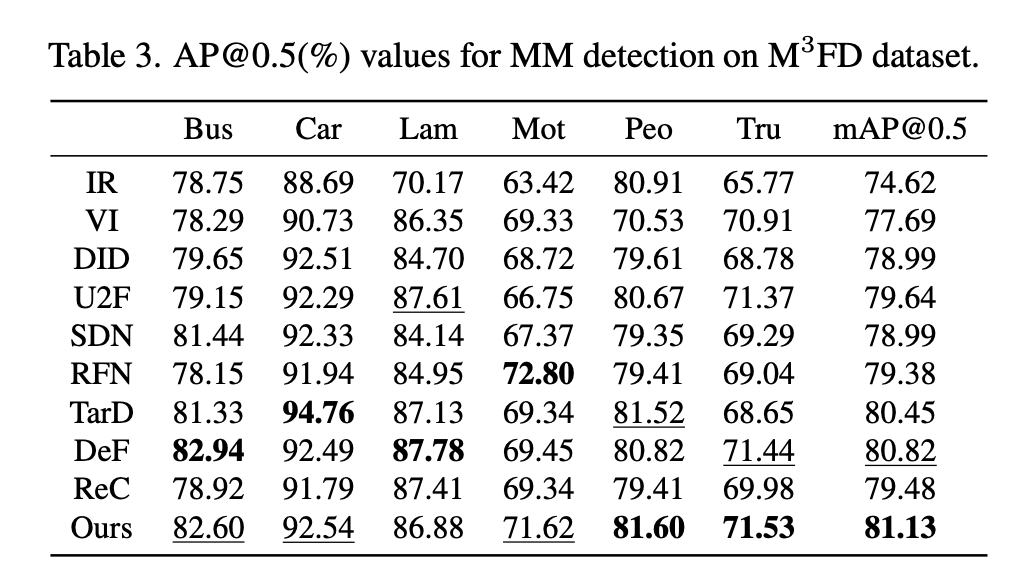

下游高级视觉任务的对比,展示了检测和分割两种任务上的效果。首先是检测,这里采用了 M3FD 数据集,将 YOLOv5 作为检测器,训练 400 个 epoch,指标选为 mAP@0.5,结果如下表。

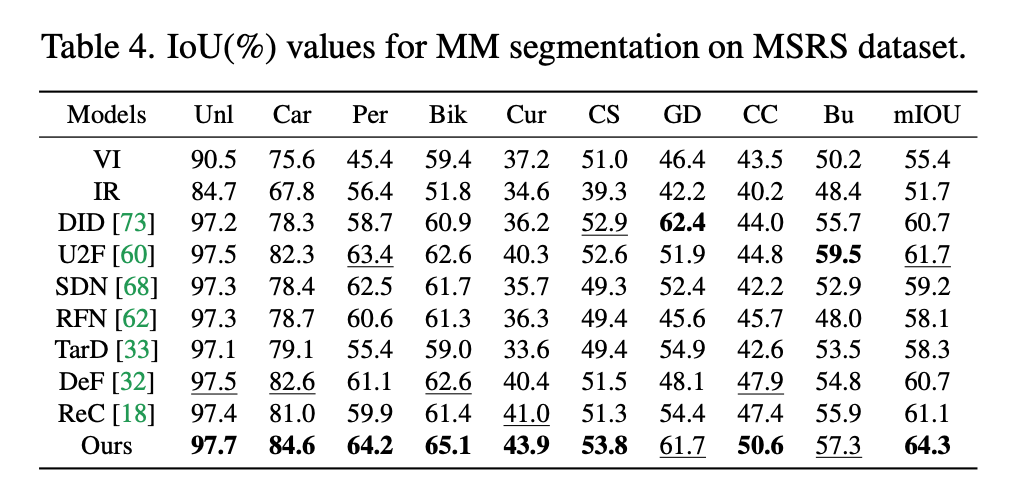

分割任务使用 MSRS 数据集,使用 DeeplabV3+ 作为分割模型,评价指标选择 IoU,结果如下表。

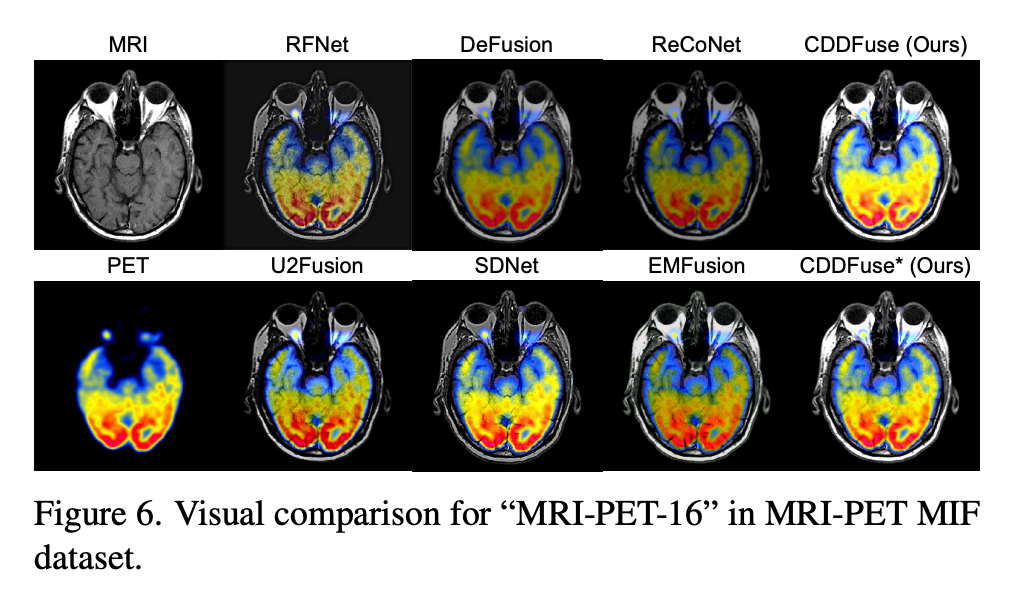

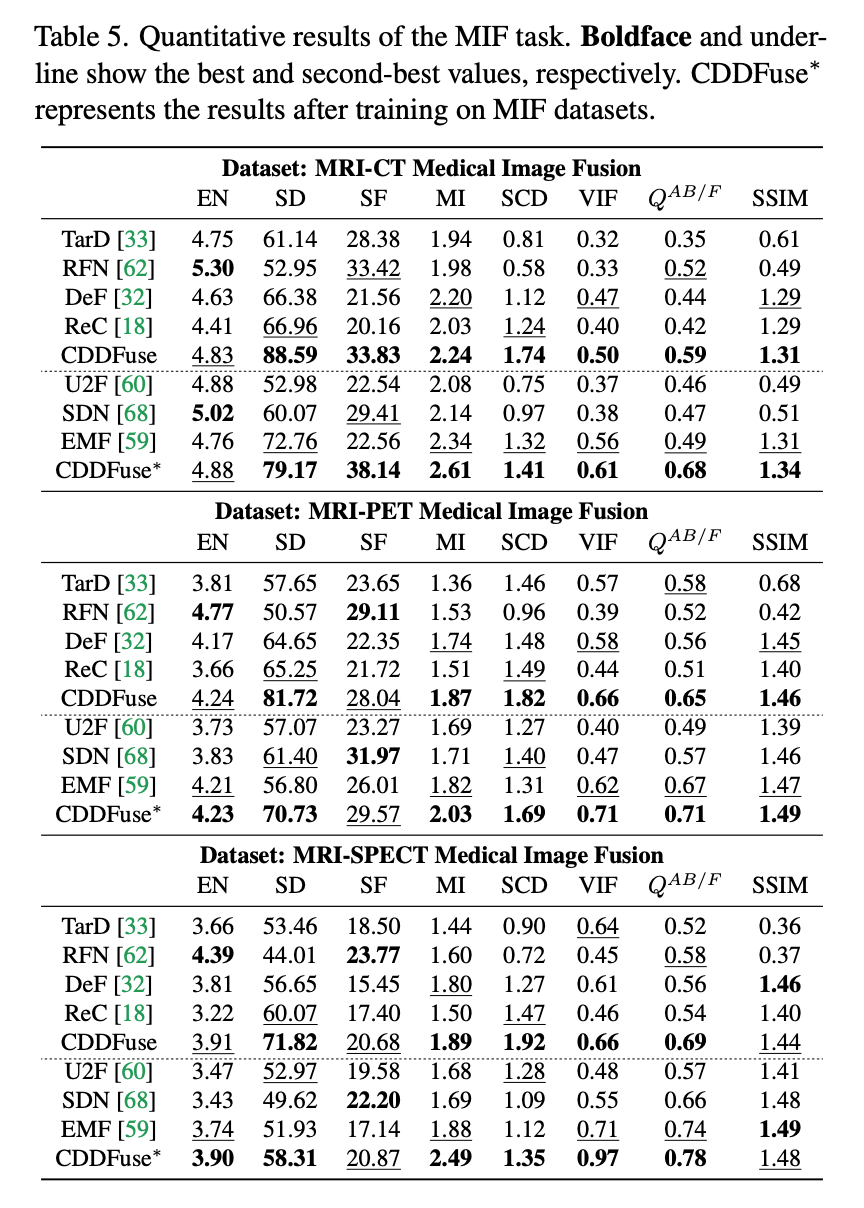

另一组多模态图像融合实验是针对医学影像进行的,选取了 Harvard Medical website 中 286 个图像对,包含 MRI-CT、MRI-PET、MRI-SPECT 三种图像对数据,对比结果如下图。

更多阅读

#投 稿 通 道#

让你的文字被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学术热点剖析、科研心得或竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。

📝 稿件基本要求:

• 文章确系个人原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注

• 稿件建议以 markdown 格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题

• PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算

📬 投稿通道:

• 投稿邮箱:hr@paperweekly.site

• 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者

• 您也可以直接添加小编微信(pwbot02)快速投稿,备注:姓名-投稿

△长按添加PaperWeekly小编

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

·

·

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)